Các mô hình ngôn ngữ lớn (LLM) được cải tiến thường xuyên xuất hiện và trong khi những giải pháp dựa trên đám mây mang lại sự tiện lợi thì việc chạy LLM cục bộ mang lại một số lợi thế, bao gồm quyền riêng tư được cải thiện, khả năng truy cập ngoại tuyến và khả năng kiểm soát tốt hơn đối với dữ liệu và tùy chỉnh mô hình.

Việc chạy các mô hình LLM cục bộ mang lại một số lợi ích hấp dẫn:

- Bảo mật: Duy trì quyền kiểm soát hoàn toàn đối với dữ liệu của bạn, đảm bảo rằng thông tin nhạy cảm vẫn nằm trong môi trường cục bộ của bạn và không được truyền đến các máy chủ bên ngoài.

- Khả năng truy cập ngoại tuyến: Sử dụng các mô hình LLM ngay cả khi không có kết nối Internet, lý tưởng cho những tình huống kết nối bị hạn chế hoặc không ổn định.

- Khả năng tùy chỉnh: Tinh chỉnh các mô hình để phù hợp với những nhiệm vụ và sở thích cụ thể, tối ưu hóa hiệu suất cho các trường hợp sử dụng riêng của bạn.

- Hiệu quả về chi phí: Tránh các khoản phí đăng ký định kỳ liên quan đến những giải pháp dựa trên đám mây, có khả năng tiết kiệm chi phí về lâu dài.

Phần này sẽ xem xét một số công cụ cho phép chạy các mô hình LLM cục bộ, kiểm tra những tính năng, điểm mạnh và điểm yếu của chúng để giúp bạn đưa ra quyết định sáng suốt dựa trên nhu cầu cụ thể của mình.

1. AnythingLLM

AnythingLLM là một ứng dụng AI nguồn mở, đưa sức mạnh của LLM cục bộ tới ngay trên máy tính của bạn. Nền tảng miễn phí này mang đến cho người dùng một cách đơn giản để trò chuyện với tài liệu, chạy các AI agent và xử lý nhiều tác vụ AI khác nhau, đồng thời đảm bảo an toàn cho dữ liệu trên máy tính của họ.

Điểm mạnh của hệ thống đến từ kiến trúc linh hoạt. Ba thành phần hoạt động cùng nhau: Giao diện dựa trên React cho tương tác mượt mà, máy chủ NodeJS Express quản lý các tác vụ nặng nề của cơ sở dữ liệu vector và giao tiếp LLM, cùng máy chủ chuyên dụng để xử lý tài liệu. Người dùng có thể chọn các mô hình AI ưa thích, cho dù họ đang chạy những tùy chọn nguồn mở cục bộ hay kết nối với các dịch vụ từ OpenAI, Azure, AWS hoặc những nhà cung cấp khác. Nền tảng này hoạt động với nhiều loại tài liệu - từ PDF và file Word đến toàn bộ cơ sở dữ liệu code - giúp nó có thể thích ứng với nhiều nhu cầu đa dạng.

Điều làm cho AnythingLLM trở nên đặc biệt hấp dẫn là sự tập trung vào quyền kiểm soát của người dùng và quyền riêng tư. Không giống như các giải pháp dựa trên đám mây gửi dữ liệu đến máy chủ bên ngoài, AnythingLLM xử lý mọi thứ cục bộ theo mặc định. Đối với các nhóm cần giải pháp mạnh mẽ hơn, phiên bản Docker hỗ trợ nhiều người dùng với quyền tùy chỉnh, đồng thời vẫn duy trì bảo mật chặt chẽ. Các tổ chức sử dụng AnythingLLM có thể bỏ qua chi phí API thường gắn liền với những dịch vụ đám mây bằng cách sử dụng các mô hình mã nguồn mở miễn phí.

Các tính năng chính của Anything LLM:

- Hệ thống xử lý cục bộ lưu trữ toàn bộ dữ liệu trên máy tính của bạn

- Framework hỗ trợ đa mô hình kết nối với nhiều nhà cung cấp AI khác nhau

- Công cụ phân tích tài liệu xử lý các file PDF, Word và mã nguồn

- Các AI agent tích hợp sẵn để tự động hóa tác vụ và tương tác web

- API dành cho nhà phát triển cho phép tích hợp và mở rộng tùy chỉnh

2. GPT4All

GPT4All cũng chạy các mô hình ngôn ngữ lớn trực tiếp trên thiết bị của bạn. Nền tảng này đặt xử lý AI trên phần cứng của riêng bạn, không để lại dữ liệu trên hệ thống. Phiên bản miễn phí cho phép người dùng truy cập hơn 1.000 mô hình mã nguồn mở, bao gồm LLaMa và Mistral.

Hệ thống hoạt động trên phần cứng tiêu chuẩn của người dùng – Mac M Series, AMD và NVIDIA. Không cần kết nối Internet để hoạt động, lý tưởng cho việc sử dụng ngoại tuyến. Thông qua tính năng LocalDocs, người dùng có thể phân tích các file cá nhân và xây dựng cơ sở kiến thức hoàn toàn trên máy tính của họ. Nền tảng này hỗ trợ cả xử lý CPU và GPU, thích ứng với các tài nguyên phần cứng hiện có.

Phiên bản doanh nghiệp có giá 25 USD/thiết bị/tháng và bổ sung các tính năng triển khai cho doanh nghiệp. Các tổ chức nhận được tự động hóa quy trình làm việc thông qua những agent tùy chỉnh, tích hợp cơ sở hạ tầng CNTT và hỗ trợ trực tiếp từ Nomic AI, công ty đứng sau sản phẩm này. Việc tập trung vào xử lý cục bộ có nghĩa là dữ liệu của công ty vẫn nằm trong phạm vi tổ chức, đáp ứng các yêu cầu bảo mật trong khi vẫn duy trì khả năng AI.

Các tính năng chính của GPT4All:

- Chạy hoàn toàn trên phần cứng cục bộ mà không cần kết nối đám mây

- Truy cập hơn 1.000 mô hình ngôn ngữ mã nguồn mở

- Phân tích tài liệu tích hợp thông qua LocalDocs

- Hoạt động hoàn toàn ngoại tuyến

- Công cụ triển khai và hỗ trợ doanh nghiệp

3. Ollama

Ollama tải xuống, quản lý và chạy LLM trực tiếp trên máy tính của bạn. Công cụ nguồn mở này tạo ra một môi trường biệt lập chứa tất cả các thành phần mô hình – trọng số, cấu hình và những dependency – cho phép bạn chạy AI mà không cần dịch vụ đám mây.

Hệ thống hoạt động thông qua cả giao diện dòng lệnh và giao diện đồ họa, hỗ trợ macOS, Linux và Windows. Người dùng lấy các mô hình từ thư viện của Ollama, bao gồm Llama 3.2 cho những tác vụ văn bản, Mistral để tạo code, Code Llama để lập trình, LLaVA để xử lý hình ảnh và Phi-3 cho công việc khoa học. Mỗi mô hình chạy trong môi trường riêng, giúp dễ dàng chuyển đổi giữa các công cụ AI khác nhau cho những tác vụ cụ thể.

Các tổ chức sử dụng Ollama đã cắt giảm chi phí đám mây đồng thời cải thiện khả năng kiểm soát dữ liệu. Công cụ này hỗ trợ chatbot cục bộ, các dự án nghiên cứu và những ứng dụng AI xử lý dữ liệu nhạy cảm. Các nhà phát triển tích hợp nó với những hệ thống CMS và CRM hiện có, bổ sung khả năng AI trong khi vẫn giữ dữ liệu tại chỗ. Bằng cách loại bỏ sự phụ thuộc vào đám mây, các nhóm làm việc ngoại tuyến và đáp ứng những yêu cầu về quyền riêng tư như GDPR mà không ảnh hưởng đến chức năng AI.

Các tính năng chính của Ollama:

- Hệ thống quản lý mô hình hoàn chỉnh để tải xuống và kiểm soát phiên bản

- Giao diện dòng lệnh và giao diện trực quan cho các phong cách làm việc khác nhau

- Hỗ trợ nhiều nền tảng và hệ điều hành

- Môi trường biệt lập cho mỗi mô hình AI

- Tích hợp trực tiếp với các hệ thống kinh doanh

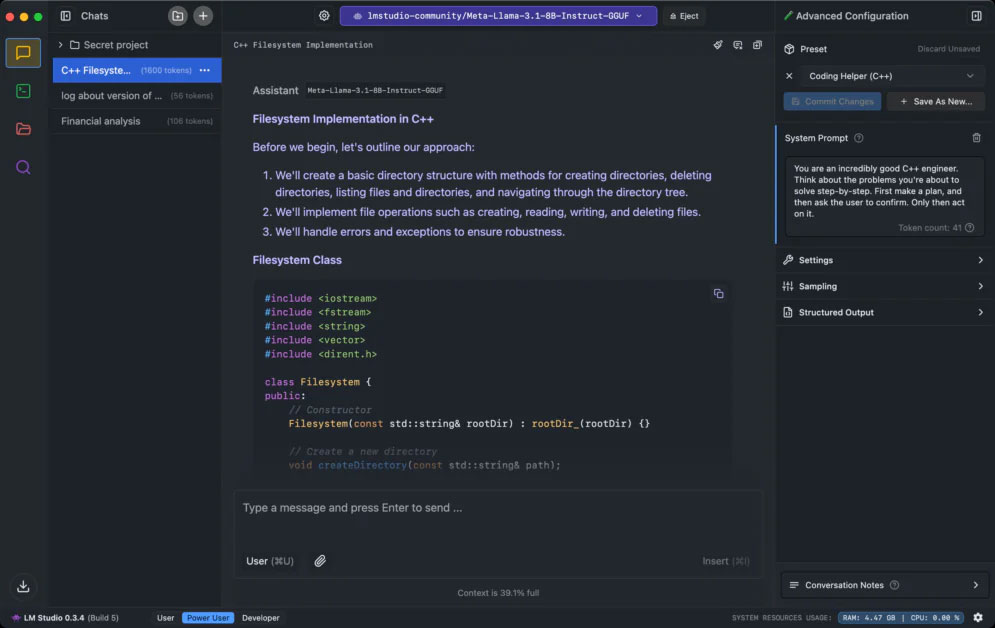

4. LM Studio

LM Studio là một ứng dụng desktop cho phép bạn chạy các mô hình ngôn ngữ AI trực tiếp trên máy tính. Thông qua giao diện, người dùng tìm, tải xuống và chạy các mô hình từ Hugging Face trong khi vẫn giữ nguyên toàn bộ dữ liệu và quy trình xử lý.

Hệ thống hoạt động như một không gian làm việc AI hoàn chỉnh. Máy chủ tích hợp của nó mô phỏng API của OpenAI, cho phép bạn kết nối AI cục bộ với bất kỳ công cụ nào hoạt động với OpenAI. Nền tảng này hỗ trợ các loại mô hình chính như Llama 3.2, Mistral, Phi, Gemma, DeepSeek và Qwen 2.5. Người dùng kéo và thả tài liệu để trò chuyện với họ thông qua RAG (Retrieval Augmented Generation), với tất cả quy trình xử lý tài liệu được lưu trữ trên máy của họ. Giao diện cho phép bạn tinh chỉnh cách các mô hình chạy, bao gồm cả việc sử dụng GPU và lời nhắc hệ thống.

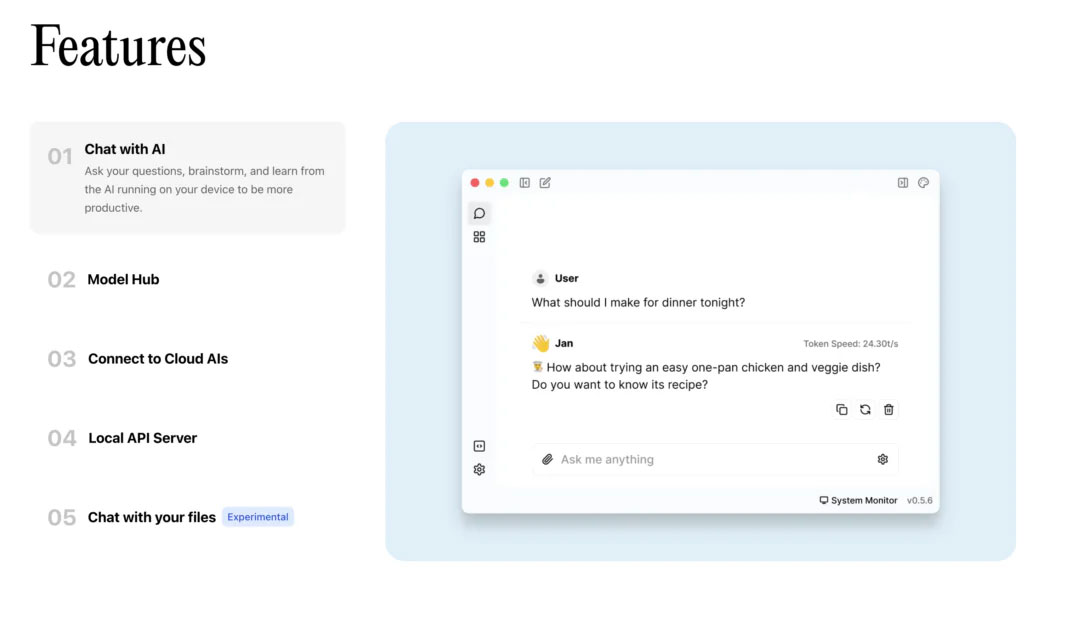

5. Jan

Jan cung cấp cho bạn một giải pháp thay thế mã nguồn mở miễn phí cho ChatGPT, chạy hoàn toàn ngoại tuyến. Nền tảng desktop này cho phép bạn tải xuống các mô hình AI phổ biến như Llama 3, Gemma và Mistral để chạy trên máy tính hoặc kết nối với các dịch vụ đám mây như OpenAI và Anthropic khi cần.

Hệ thống tập trung vào việc trao quyền kiểm soát cho người dùng. Máy chủ Cortex cục bộ của nó khớp với API của OpenAI, cho phép nó hoạt động với các công cụ như Continue.dev và Open Interpreter. Người dùng lưu trữ tất cả dữ liệu của họ trong "Jan Data Folder" cục bộ, không có thông tin nào rời khỏi thiết bị của họ trừ khi họ chọn sử dụng dịch vụ đám mây. Nền tảng này hoạt động tương tự như VSCode hoặc Obsidian – bạn có thể mở rộng bằng các bổ sung tùy chỉnh để phù hợp với nhu cầu. Nó chạy trên Mac, Windows và Linux, hỗ trợ GPU NVIDIA (CUDA), AMD (Vulkan) và Intel Arc.

6. Llamafile

Llamafile chuyển đổi các mô hình AI thành những file thực thi duy nhất. Dự án Mozilla Builders này kết hợp llama.cpp với Cosmopolitan Libc để tạo ra các chương trình độc lập chạy AI mà không cần cài đặt hoặc thiết lập.

Hệ thống căn chỉnh trọng số mô hình dưới dạng file ZIP không nén để truy cập trực tiếp vào GPU. Hệ thống phát hiện các tính năng CPU của bạn khi chạy để đạt hiệu suất tối ưu, hoạt động trên những bộ xử lý Intel và AMD. Code sẽ biên dịch các phần dành riêng cho GPU theo yêu cầu bằng trình biên dịch của hệ thống. Thiết kế này chạy trên macOS, Windows, Linux và BSD, hỗ trợ bộ xử lý AMD64 và ARM64.

7. NextChat

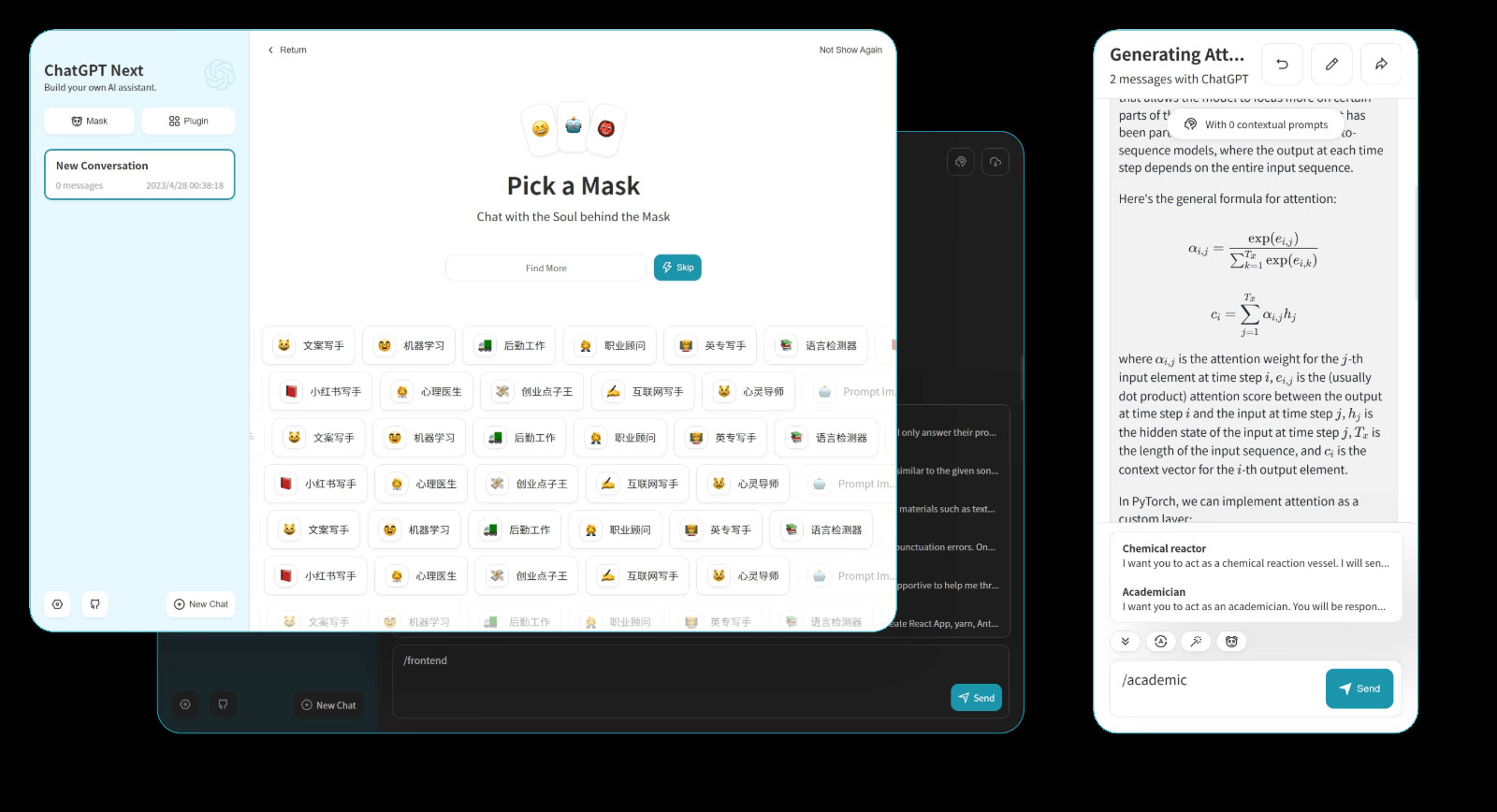

NextChat tích hợp các tính năng của ChatGPT vào một gói mã nguồn mở do bạn kiểm soát. Ứng dụng web và desktop này kết nối với nhiều dịch vụ AI – OpenAI, Google AI và Claude – đồng thời lưu trữ tất cả dữ liệu cục bộ trong trình duyệt của bạn.

Hệ thống bổ sung các tính năng chính còn thiếu trong ChatGPT tiêu chuẩn. Người dùng tạo "Masks" (tương tự như GPT) để xây dựng các công cụ AI tùy chỉnh với những ngữ cảnh và cài đặt cụ thể. Nền tảng này tự động nén lịch sử trò chuyện cho những cuộc trò chuyện dài hơn, hỗ trợ định dạng markdown và truyền phát phản hồi theo thời gian thực. Nó hoạt động với nhiều ngôn ngữ bao gồm tiếng Anh, tiếng Trung, tiếng Nhật, tiếng Pháp, tiếng Tây Ban Nha và tiếng Ý.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học