ChatGPT có lẽ là ứng dụng quan trọng nhất được phát hành trong thập kỷ qua. Mặc dù ban đầu nó chỉ là một chatbot/bản demo công nghệ cho các mô hình ngôn ngữ lớn (LLM) của OpenAI, nhưng giờ đây nó đã trở thành nhiều hơn thế. Các mô hình AI nền tảng của nó có thể tìm kiếm trên web, tạo và đánh giá hình ảnh, và thậm chí viết những bài thơ ngớ ngẩn. Và nó cũng có thể nhanh chóng tóm tắt các tài liệu khổng lồ, tạo code máy tính và vượt qua những bài kiểm tra mà ít người có thể làm được. Giờ đây nó là công cụ đa năng tối ưu.

Khi OpenAI bổ sung tất cả các tính năng này, ra mắt những mô hình mới và nói chung là liên tục thúc đẩy ChatGPT tiến lên, việc trả lời một câu hỏi tưởng chừng đơn giản: ChatGPT hoạt động như thế nào? ngày càng trở nên khó khăn hơn.

ChatGPT là gì?

ChatGPT là một chatbot được hỗ trợ bởi mạng nơ-ron nhân tạo transformer, được huấn luyện trên lượng lớn văn bản để học các mẫu ngôn ngữ. Sau quá trình huấn luyện sơ bộ này, các mô hình được tinh chỉnh bằng những phương pháp như học tăng cường từ phản hồi của con người (RLHF) để phản hồi của chúng an toàn và hữu ích hơn. Khi bạn nhập một prompt, ChatGPT sẽ chia nó thành các token (những đoạn văn bản nhỏ), sử dụng kiến thức đã học để tìm ra điều quan trọng nhất, sau đó dự đoán các token tiếp theo để tạo ra một câu trả lời mạch lạc.

Tốt nhất nên coi ChatGPT như một wrapper dễ sử dụng xung quanh một số mô hình AI tiên tiến nhất hiện có. Giao diện chatbot của nó cho phép trả lời câu hỏi của bạn, viết nội dung, tạo hình ảnh, soạn thảo email, trò chuyện, động não ý tưởng, giải thích code bằng các ngôn ngữ lập trình khác nhau, dịch ngôn ngữ tự nhiên sang code, giải quyết những vấn đề phức tạp, v.v... - tất cả dựa trên các prompt bằng ngôn ngữ tự nhiên mà bạn cung cấp cho nó. Bạn không cần phải chuyển đổi giữa các ứng dụng để truy cập những tính năng khác nhau của nó - chỉ cần bắt đầu một cuộc trò chuyện mới trong ChatGPT.

Tất nhiên, bản thân ChatGPT dựa vào AI để xác định mô hình hoặc sự kết hợp các mô hình nào có thể xử lý yêu cầu của bạn tốt nhất. Trừ khi bạn chỉ định một mô hình AI cụ thể, nó sẽ tự động chuyển prompt của bạn đến mô hình mà nó cho là phù hợp nhất. Tại thời điểm viết bài này, ChatGPT chủ yếu dựa vào:

- GPT-4o mini và GPT-4o để tạo văn bản, xử lý và hiểu hình ảnh, và trả lời nhanh chóng.

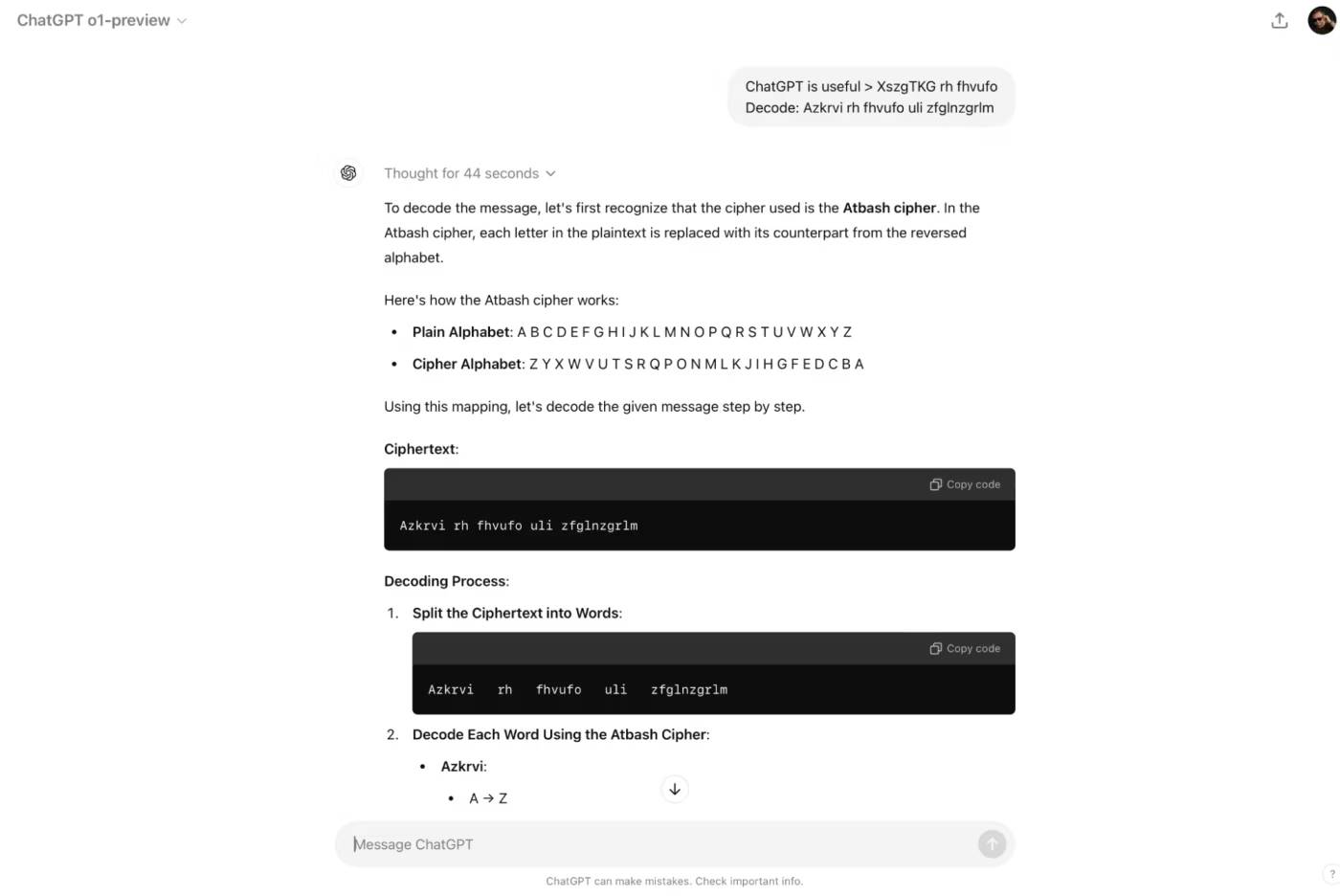

- o1-mini và o1-preview được sử dụng để phản hồi các prompt hoặc câu hỏi yêu cầu khả năng suy luận nâng cao.

- DALL·E 3 được sử dụng để tạo hình ảnh.

Ngoài các mô hình chính này, ChatGPT còn có:

- Một mô hình giọng nói sử dụng GPT-4o để phản hồi các truy vấn âm thanh theo thời gian thực.

- Một mô hình tìm kiếm có thể tìm kiếm trên web, sau đó tóm tắt và trích dẫn thông tin quan trọng nhất.

Thật khó để nói quá về tính linh hoạt của sự kết hợp các mô hình AI này. Từ cùng một giao diện, ChatGPT có thể viết email cho sếp của bạn, dịch một cuộc hội thoại theo thời gian thực khi bạn đang đi du lịch hoặc giúp bạn nhận diện một món ăn trong nhà hàng từ một bức ảnh.

Vậy bây giờ bạn đã hiểu ChatGPT làm gì (và nó ẩn chứa bao nhiêu sự phức tạp), hãy cùng tìm hiểu sâu hơn về các mô hình AI cơ bản này.

ChatGPT hoạt động như thế nào?

GPT trong ChatGPT là viết tắt của Generative Pre-trained Transformer. Cho đến khi OpenAI phát hành dòng mô hình o1, tất cả các mô hình LLM và mô hình đa phương thức lớn (LMM) của OpenAI đều sử dụng sơ đồ đặt tên GPT-X, ví dụ như GPT-4o. Nhưng mặc dù tên gọi đang thay đổi, phần lớn những gì diễn ra bên trong vẫn tương tự.

Danh sách các khái niệm sắp trình bày đều quan trọng để hiểu rõ hơn cách thức hoạt động của LLM, LMM và các mô hình AI khác được ChatGPT sử dụng.

Học có giám sát và học không giám sát

Một phần quan trọng trong việc phát triển các mô hình AI được gọi là "huấn luyện", vì vậy hãy cùng tìm hiểu về nó. Chữ P trong GPT viết tắt của "pre-trained" (được huấn luyện trước), và đó là một phần cực kỳ quan trọng giúp các mô hình GPT có thể làm được những gì chúng đang làm. Họ mô hình o1 cũng được huấn luyện trước, cũng như hầu hết các mô hình AI hiện đại khác, vì vậy việc OpenAI bỏ chữ P khỏi tên gọi là điều dễ hiểu. Nó không còn là một đặc điểm phân biệt nữa.

Trước GPT-1, các mô hình AI hoạt động tốt nhất đã sử dụng "học có giám sát" để phát triển những thuật toán cơ bản của chúng. Chúng được huấn luyện bằng dữ liệu được gắn nhãn thủ công, chẳng hạn như cơ sở dữ liệu với ảnh của các loài động vật khác nhau được ghép nối với mô tả bằng văn bản của mỗi loài động vật do con người viết. Loại dữ liệu huấn luyện này, mặc dù hiệu quả trong một số trường hợp, nhưng lại cực kỳ tốn kém để sản xuất. Ngay cả bây giờ, vẫn không có nhiều dữ liệu được gắn nhãn và phân loại phù hợp để sử dụng cho việc huấn luyện các LLM.

Thay vào đó, GPT-1 sử dụng phương pháp huấn luyện trước tạo sinh, trong đó nó được cung cấp một vài quy tắc cơ bản và sau đó được cung cấp một lượng lớn dữ liệu không được gắn nhãn - gần như toàn bộ Internet mở. Sau đó, nó được để "không giám sát" để xử lý tất cả dữ liệu này và phát triển sự hiểu biết riêng của nó về các quy tắc và mối quan hệ chi phối văn bản.

Kiến trúc Transformer

Tất cả quá trình huấn luyện này nhằm mục đích tạo ra một mạng nơ-ron nhân tạo Deep Learning - một thuật toán phức tạp, nhiều lớp, có trọng số được mô phỏng theo bộ não con người - cho phép ChatGPT học các mẫu và mối quan hệ trong dữ liệu văn bản và khai thác khả năng tạo ra những phản hồi giống con người bằng cách dự đoán văn bản nào nên xuất hiện tiếp theo trong bất kỳ câu nào.

Mạng này sử dụng cái gọi là kiến trúc Transformer (chữ T trong GPT) và đã được đề xuất trong một bài báo nghiên cứu vào năm 2017. Nó hoàn toàn cần thiết cho sự bùng nổ hiện tại của các mô hình AI.

Mặc dù nghe có vẻ - và thực tế là - phức tạp khi giải thích, mô hình Transformer về cơ bản đã đơn giản hóa cách thiết kế các thuật toán AI. Nó cho phép các phép tính được song song hóa (hoặc thực hiện cùng một lúc), nghĩa là thời gian huấn luyện giảm đáng kể. Nó không chỉ làm cho các mô hình AI tốt hơn mà còn làm cho chúng nhanh và rẻ hơn để sản xuất.

Cốt lõi của Transformer là một quá trình gọi là "tự chú ý". Các RNN (Recurrent Neural Network) cũ hơn đọc văn bản từ trái sang phải. Điều này ổn khi các từ và khái niệm liên quan nằm cạnh nhau, nhưng nó làm cho mọi thứ trở nên phức tạp khi chúng nằm ở hai đầu đối lập của câu. (Đây cũng là một cách tính toán chậm vì nó phải được thực hiện tuần tự).

Token

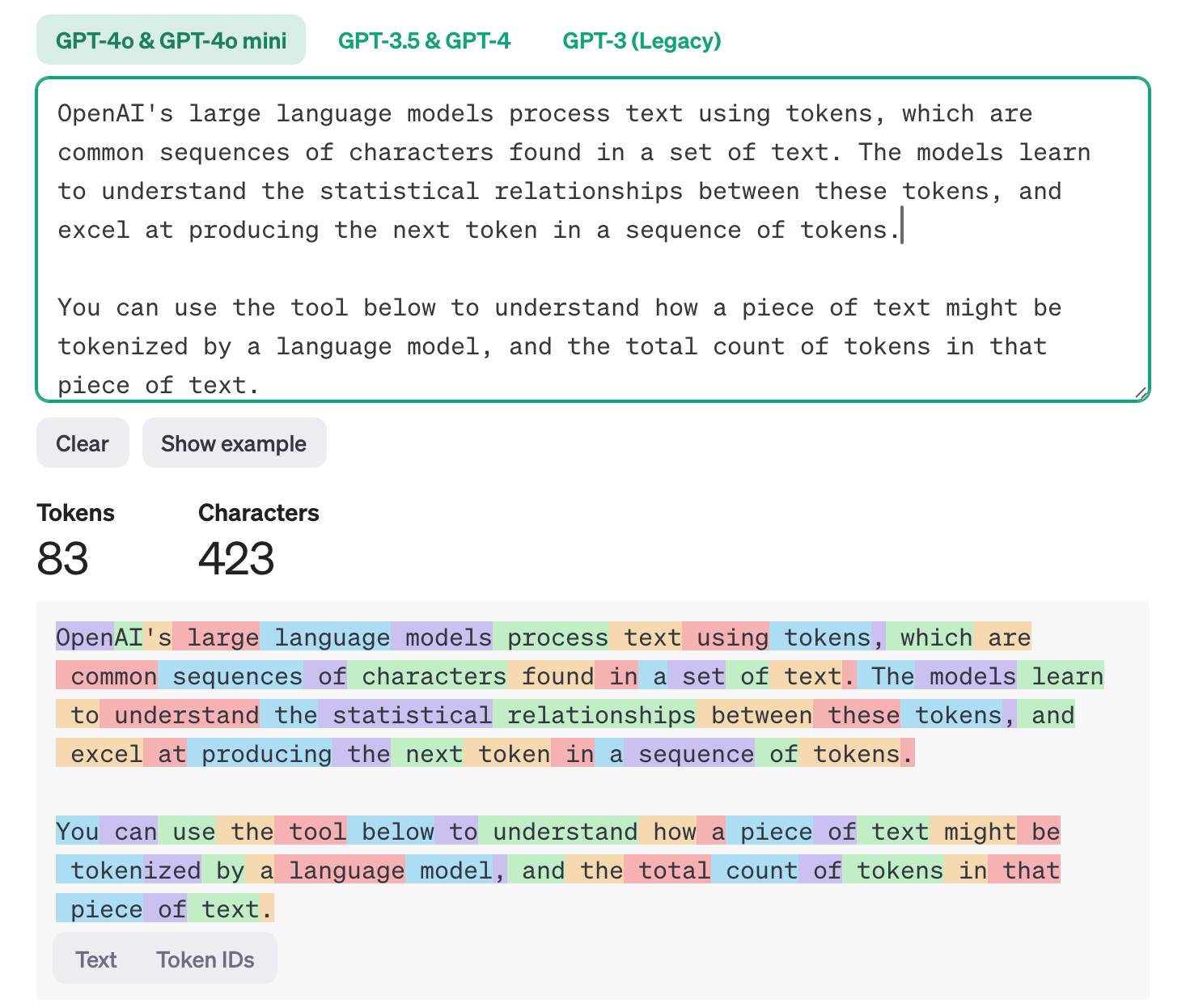

Cách các mô hình AI hiểu văn bản cũng rất quan trọng, vì vậy hãy cùng tìm hiểu sâu hơn về token. Mặc dù tất cả dữ liệu, bao gồm cả hình ảnh và âm thanh, cũng được chia nhỏ thành token, nhưng khái niệm này dễ hiểu nhất với văn bản. GPT-3, mô hình gốc đứng sau ChatGPT, được huấn luyện trên khoảng 500 tỷ token, cho phép các mô hình ngôn ngữ của nó dễ dàng gán ý nghĩa và dự đoán văn bản tiếp theo hợp lý bằng cách ánh xạ chúng trong không gian vector.

Nhiều từ được ánh xạ thành một token duy nhất, mặc dù các từ dài hoặc phức tạp hơn thường được chia thành nhiều token. Trung bình, mỗi token dài khoảng 4 ký tự. OpenAI vẫn giữ kín về hoạt động bên trong của GPT-4o và o1, nhưng chúng ta có thể chắc chắn rằng nó được huấn luyện trên ít nhất cùng một tập dữ liệu cộng với càng nhiều dữ liệu bổ sung mà OpenAI có thể truy cập được vì nó thậm chí còn mạnh mẽ hơn.

Tất cả các token văn bản đều đến từ một kho dữ liệu khổng lồ do con người viết ra, ít nhất là đối với GPT-3. Điều đó bao gồm sách, bài báo và các tài liệu khác nhau về tất cả mọi chủ đề, phong cách và thể loại - và một lượng nội dung đáng kinh ngạc được thu thập từ Internet mở. Về cơ bản, nó được phép xử lý toàn bộ kiến thức của con người để phát triển mạng lưới mà nó sử dụng để tạo ra văn bản.

Hiện nay, các nhà nghiên cứu đang cạn kiệt dữ liệu huấn luyện do con người tạo ra, vì vậy những mô hình sau này, bao gồm cả o1, cũng được huấn luyện trên dữ liệu huấn luyện tổng hợp - hay do AI tạo ra. Và đó là chưa kể đến tất cả dữ liệu huấn luyện hình ảnh và âm thanh cũng phải được phân tích thành các token riêng biệt.

Học tăng cường từ phản hồi của con người (RLHF)

Nếu không được huấn luyện thêm, bất kỳ mạng nơ-ron nhân tạo của LLM nào cũng hoàn toàn không phù hợp để phát hành rộng rãi. Xét cho cùng, GPT được huấn luyện trên Internet mở mà hầu như không có hướng dẫn nào - bạn có thể tưởng tượng được sự kinh khủng của nó không?

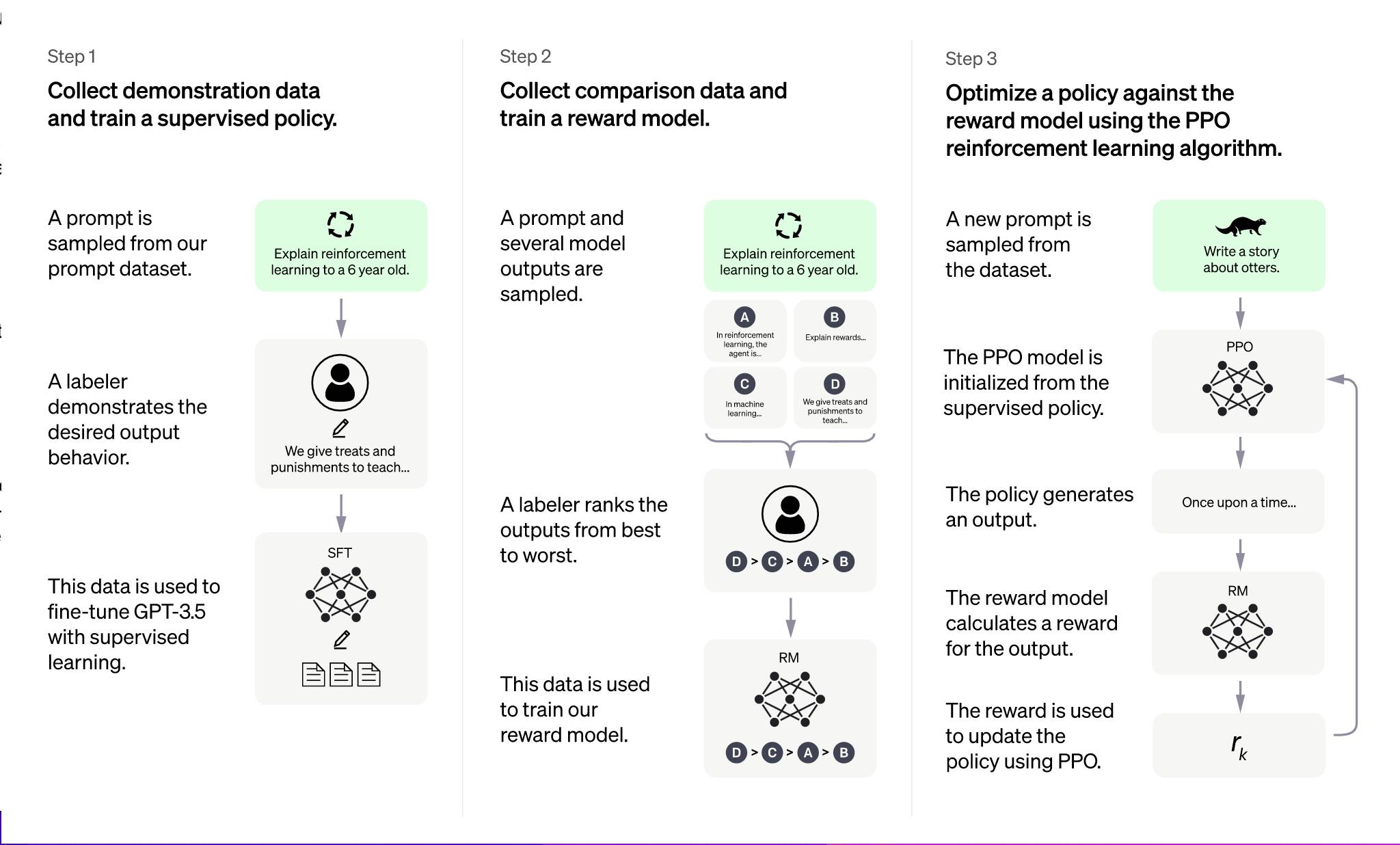

Vì vậy, để tinh chỉnh hơn nữa khả năng phản hồi của mô hình đối với nhiều loại tín hiệu khác nhau một cách an toàn, hợp lý, hiệu quả và mạch lạc, chúng đã được tối ưu hóa bằng một kỹ thuật gọi là học tăng cường với phản hồi của con người (RLHF).

Về cơ bản, OpenAI đã tạo ra một số dữ liệu minh họa cho thấy mạng nơ-ron nhân tạo nên phản hồi như thế nào trong các tình huống điển hình. Từ đó, họ đã tạo ra một mô hình phần thưởng với dữ liệu so sánh (trong đó hai hoặc nhiều phản hồi của mô hình được xếp hạng bởi trình huấn luyện AI) để AI có thể học được phản hồi nào là tốt nhất trong bất kỳ tình huống nào. Mặc dù không phải là học có giám sát thuần túy, RLHF cho phép các mạng như GPT được tinh chỉnh một cách hiệu quả.

Suy luận Chain-of-thought (CoT)

Các mô hình LLM như GPT-4o gặp khó khăn với những vấn đề phức tạp, nhiều bước. Quá trình huấn luyện hướng chúng phản hồi hầu hết các thách thức bằng câu trả lời đơn giản và rõ ràng, chứ không phải một giả định hoang đường nào đó. Khi bạn yêu cầu ChatGPT viết email cho mình, bạn không muốn nó làm điều đó bằng mã Morse một cách tùy tiện.

Nhưng bằng cách mặc định phản hồi rõ ràng, các mô hình LLM không giỏi trong những câu đố logic nâng cao, toán học khó và các loại vấn đề khác đòi hỏi nhiều bước. Đây là lúc phương pháp suy luận Chain-of-thought (CoT) - chuỗi suy nghĩ phát huy tác dụng.

Xử lý ngôn ngữ tự nhiên (NLP)

Tất cả nỗ lực này nhằm mục đích làm cho các mô hình của OpenAI hiệu quả nhất có thể trong xử lý ngôn ngữ tự nhiên (NLP). NLP là một phạm trù rộng lớn bao gồm nhiều khía cạnh của trí tuệ nhân tạo, bao gồm nhận dạng giọng nói, dịch máy và chatbot, nhưng nó có thể được hiểu là quá trình mà AI được dạy để hiểu các quy tắc và cú pháp của ngôn ngữ, được lập trình để phát triển những thuật toán phức tạp để biểu diễn các quy tắc đó, và sau đó được sử dụng những thuật toán đó để thực hiện các nhiệm vụ cụ thể.

Tóm lại, cách đơn giản nhất để hình dung nó là giống như một trong những trò chơi "hoàn thành câu" mà bạn từng chơi khi còn nhỏ.

ChatGPT bắt đầu bằng cách nhận prompt của bạn, chia nhỏ nó thành các token, và sau đó sử dụng mạng nơ-ron nhân tạo dựa trên Transformer để cố gắng hiểu những phần nổi bật nhất của nó là gì, và bạn thực sự muốn nó làm gì. Từ đó, mạng nơ-ron nhân tạo lại hoạt động và tạo ra một chuỗi token đầu ra phù hợp, dựa trên những gì nó đã học được từ dữ liệu huấn luyện và tinh chỉnh.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học