Cá nhân hóa chatbot AI là xu hướng mới nhất, vì ChatGPT, Gemini, Copilot và các chatbot khác hiện cung cấp những tính năng cá nhân hóa. Chia sẻ sở thích của bạn có vẻ hữu ích, nhưng nó có thể phản tác dụng và tạo ra những phản hồi không mong muốn. Sau khi thử tính năng này một thời gian, đây là 4 lý do khiến bạn nên ngừng cá nhân hóa chatbot của mình.

Lưu ý: Kinh nghiệm của tác giả chủ yếu đến từ việc cá nhân hóa ChatGPT và Google Gemini. Có thể có những chatbot xử lý cá nhân hóa tốt hơn, nhưng những vấn đề này vẫn tồn tại ở cả hai chatbot, trong đó ChatGPT tốt hơn một chút.

Mục lục bài viết

Chúng có thể đưa ra câu trả lời thiên vị

Thành thật mà nói, đây là kết quả dự kiến. Sau cùng, chatbot được biết là đồng ý với người dùng. Khi bạn nói với AI điều mình thích và không thích, chúng sẽ cố gắng không đưa ra những câu trả lời trực tiếp bác bỏ bạn. Điều này có nghĩa là bạn sẽ thường nhận được những câu trả lời mà sở thích của mình được chú ý.

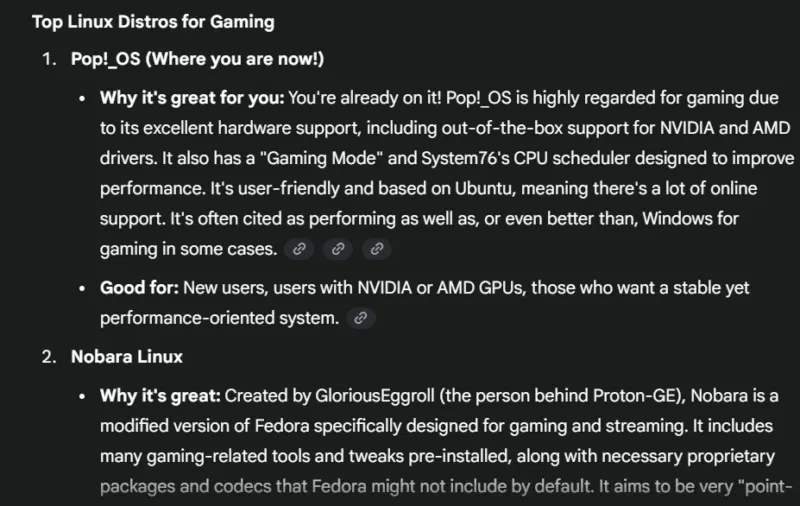

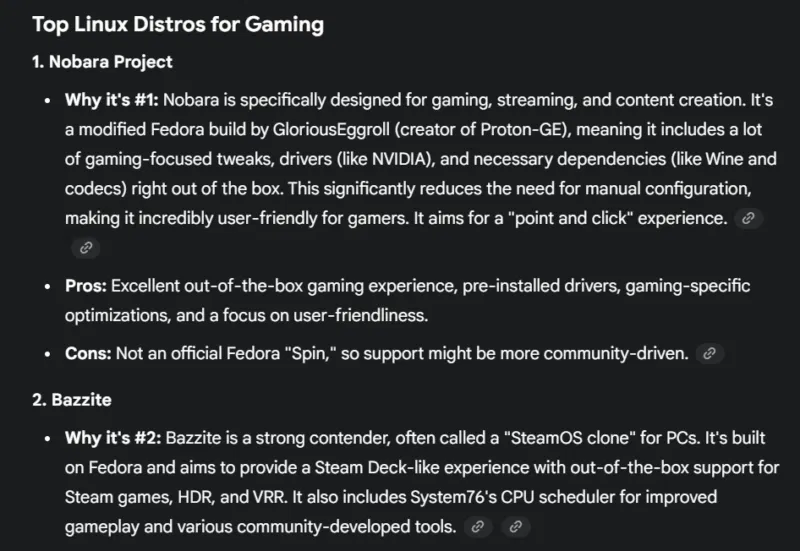

Ví dụ, tác giả đã yêu cầu Gemini "xếp hạng các bản phân phối Linux tốt nhất cho game" và nó xếp hạng Pop!_OS ở vị trí đầu tiên vì biết rằng tác giả đã sử dụng bản phân phối này.

Tuy nhiên, khi chạy cùng một tìm kiếm (sao chép/dán) mà không có cá nhân hóa, Nobara Project được xếp hạng đầu tiên trong danh sách, Pop!_OS đứng thứ 5. Sự thiên vị như vậy có thể thực sự tệ cho trải nghiệm của bạn vì nó có thể ngăn bạn tìm thấy những điều mới mẻ và khiến bạn tự tin rằng bất cứ điều gì bạn đang làm là đúng, ngay cả khi nó không tối ưu.

Tăng thêm khả năng gặp ảo giác AI

Ảo giác AI là một vấn đề phổ biến, tin tặc thậm chí còn sử dụng nó để thực hiện các cuộc tấn công chiếm dụng trái phép. Các chatbot AI tạo ra thông tin ảo giác và trình bày thông tin đó dưới dạng sự thật, thường theo cách khó có thể bác bỏ những tuyên bố của chúng. Cá nhân hóa càng làm trầm trọng thêm vấn đề ảo giác AI vì nó thường xem xét các truy vấn với thông tin cá nhân của bạn trong tiêu điểm.

Ngay cả khi bạn đặt câu hỏi về một điều hoàn toàn khác, nó sẽ cố gắng kết nối các dấu chấm để biến câu hỏi thành thông tin cá nhân của bạn. Điều này thường dẫn đến việc AI kết nối thông tin một cách cưỡng bức với thông tin cá nhân của bạn và nói dối.

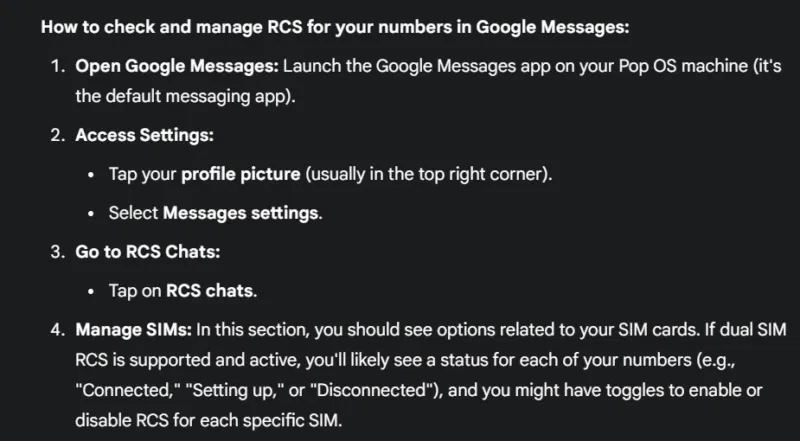

Ví dụ, tác giả đã hỏi Gemini về việc sử dụng RCS trong Google Messages khi thiết lập SIM kép. Vì biết tác giả đang sử dụng Linux nên bằng cách nào đó, nó đã kết nối truy vấn về Android với Linux. Nó tự tin đưa ra hướng dẫn về ứng dụng Android trên Linux. Nó thậm chí còn gọi Google Messages là ứng dụng nhắn tin mặc định trên Pop!_OS.

Buộc phải làm rõ những điều không nên làm

Thông thường, nếu bạn đặt câu hỏi mà không cung cấp bất kỳ bối cảnh nào, các chatbot AI sẽ đưa ra phỏng đoán tốt nhất và thường đúng. Điều này có nghĩa là bạn có thể bắt đầu hầu hết các cuộc trò chuyện mà không cần đi sâu vào chi tiết về chính xác những gì bạn đang nói đến, giúp tiết kiệm thời gian. Khi bật tính năng cá nhân hóa, nó sẽ cố gắng kết nối truy vấn với thông tin cá nhân của bạn nếu nó có liên quan một phần. Điều này dẫn đến việc cung cấp thông tin không chính xác hoặc AI sẽ hỏi thêm các câu hỏi để làm rõ.

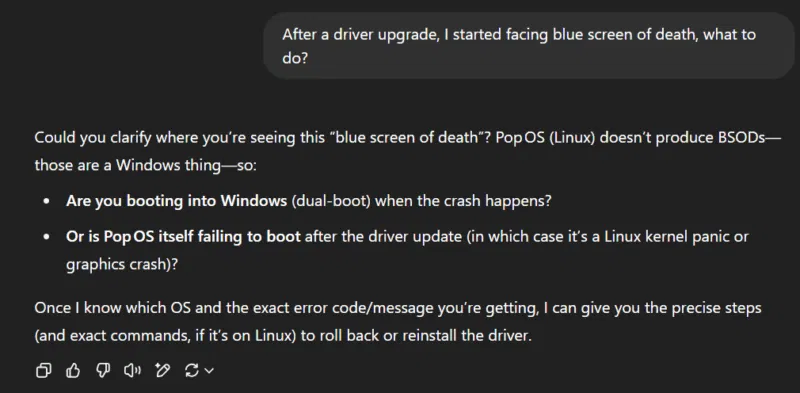

Ví dụ, tác giả đã hỏi ChatGPT một truy vấn đơn giản về việc gặp phải BSoD sau khi cập nhật driver. Màn hình xanh chết chóc (BSoD) là lỗi chỉ có ở Windows, vì vậy thông thường, nó sẽ đoán rằng bạn đang gặp sự cố trong Windows. Tuy nhiên, thay vào đó, nó bắt đầu yêu cầu cung cấp thêm thông tin chi tiết vì nó biết tác giả đang sử dụng Linux, buộc tác giả phải làm rõ rằng mình đang sử dụng Windows.

AI lãng phí không gian trả lời và token bằng cách thêm thông tin bổ sung

Các chatbot AI xử lý thông tin bằng hệ thống token. Vì các câu trả lời AI sử dụng quá nhiều tài nguyên phần cứng nên hệ thống token này cho phép chatbot quản lý độ dài câu trả lời dựa trên câu hỏi và gói của người dùng, giống như phiên bản miễn phí hoặc trả phí. Do đó, mọi thông tin trong câu trả lời đều bị giới hạn bởi hệ thống token này; bất kỳ thông tin bổ sung nào mà bạn không cần vẫn sẽ tiêu tốn các token này.

Với tính năng cá nhân hóa, bất kỳ câu hỏi nào bạn hỏi mà thậm chí chỉ liên quan một phần đến thông tin cá nhân, AI sẽ lãng phí một số token để cung cấp thêm thông tin.

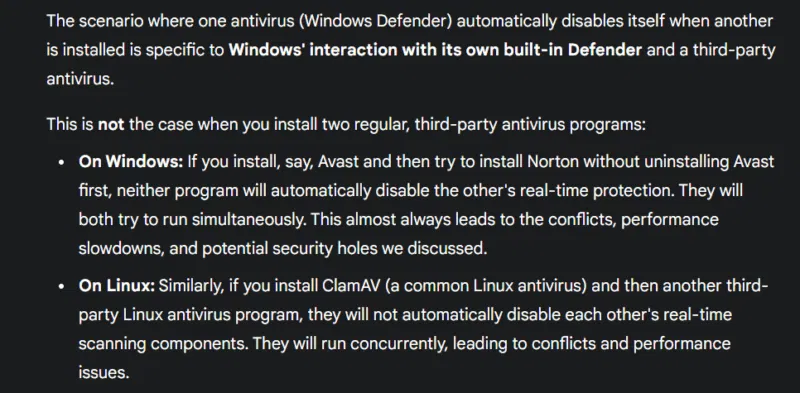

Ví dụ, tác giả đã nói chuyện với Gemini về Windows Defender và cách nó hoạt động với các chương trình diệt virus của bên thứ ba. Không có đề cập đến Linux, nhưng quyết định dành một phần cho Linux để lặp lại cùng một ví dụ đã đưa ra về Windows. Không gian này có thể được sử dụng để cung cấp thêm thông tin về Windows.

Tính cá nhân hóa có thể làm cho thông tin có liên quan hơn, nhưng nó cũng có thể dẫn đến câu trả lời không chính xác và thiên vị, khiến bạn khó tin tưởng vào câu trả lời. Hãy tắt tính năng cá nhân hóa trên tất cả các chatbot AI mà bạn sử dụng! Thay vào đó cố gắng tạo ra lời nhắc theo cách giúp bạn nhận được câu trả lời chính xác mà mình cần.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học