Gần đây, nhiều người thực sự thích thú với việc chạy các LLM cục bộ, và sau khi thấy tất cả những điều tuyệt vời mà các công cụ MCP mang lại, đã đến lúc nâng cấp hệ thống của bạn một chút.

LM Studio là ứng dụng LLM cục bộ tốt nhất (cho đến nay)

Ollama cũng tốt, nhưng nhiều người thích LM Studio hơn

Năm ngoái, nhiều người bắt đầu thử nghiệm các mô hình LLM cục bộ với Ollama. Nó hoạt động khá tốt, nhưng chiếc MacBook Air với chỉ 8GB bộ nhớ hợp nhất chắc chắn không đủ mạnh để xử lý khối lượng công việc đó. Mọi người vẫn muốn thử một cái gì đó khác, một phần vì tò mò và một phần để xem liệu có thể tối ưu hóa hiệu năng hơn nữa hay không.

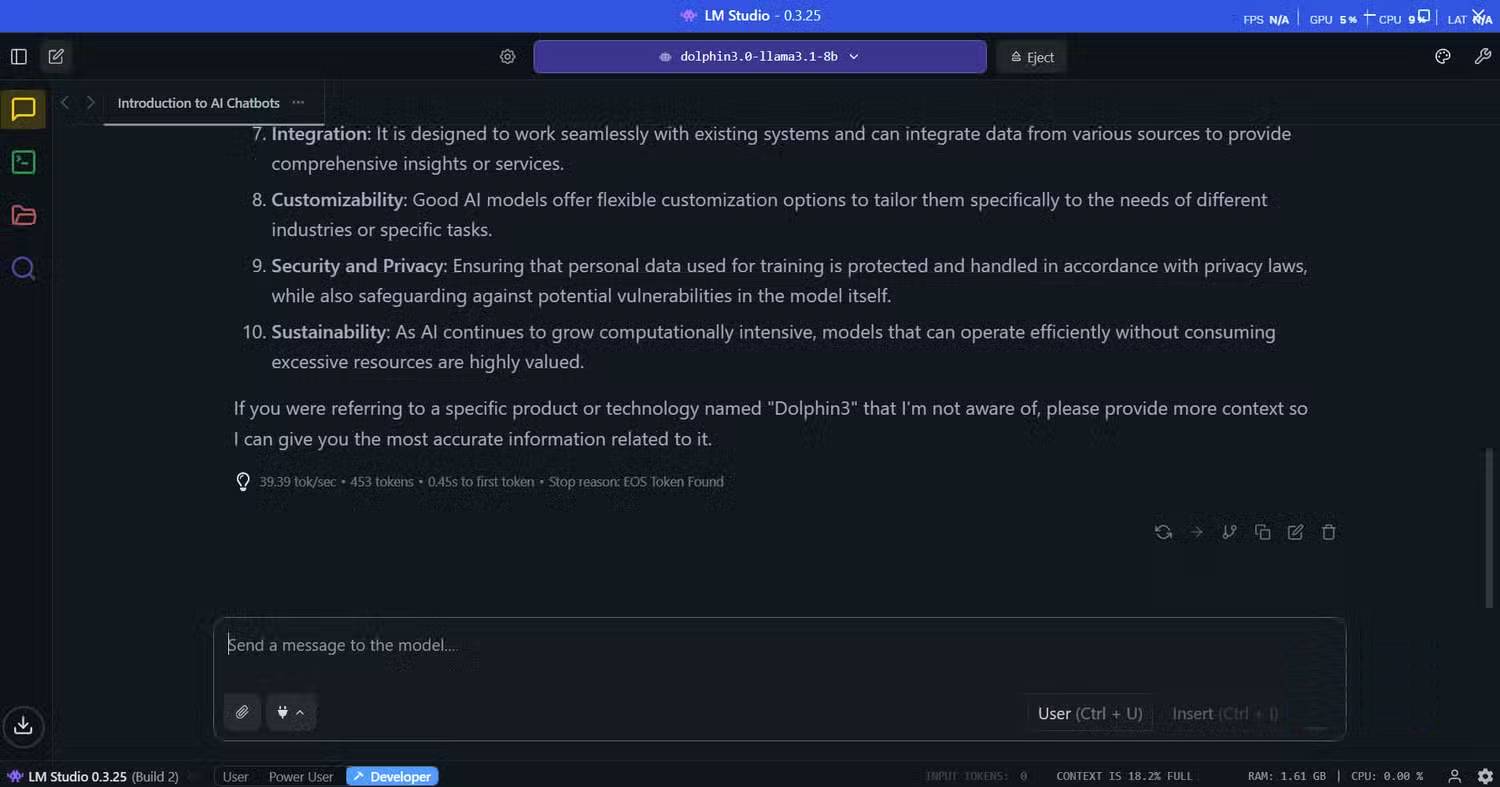

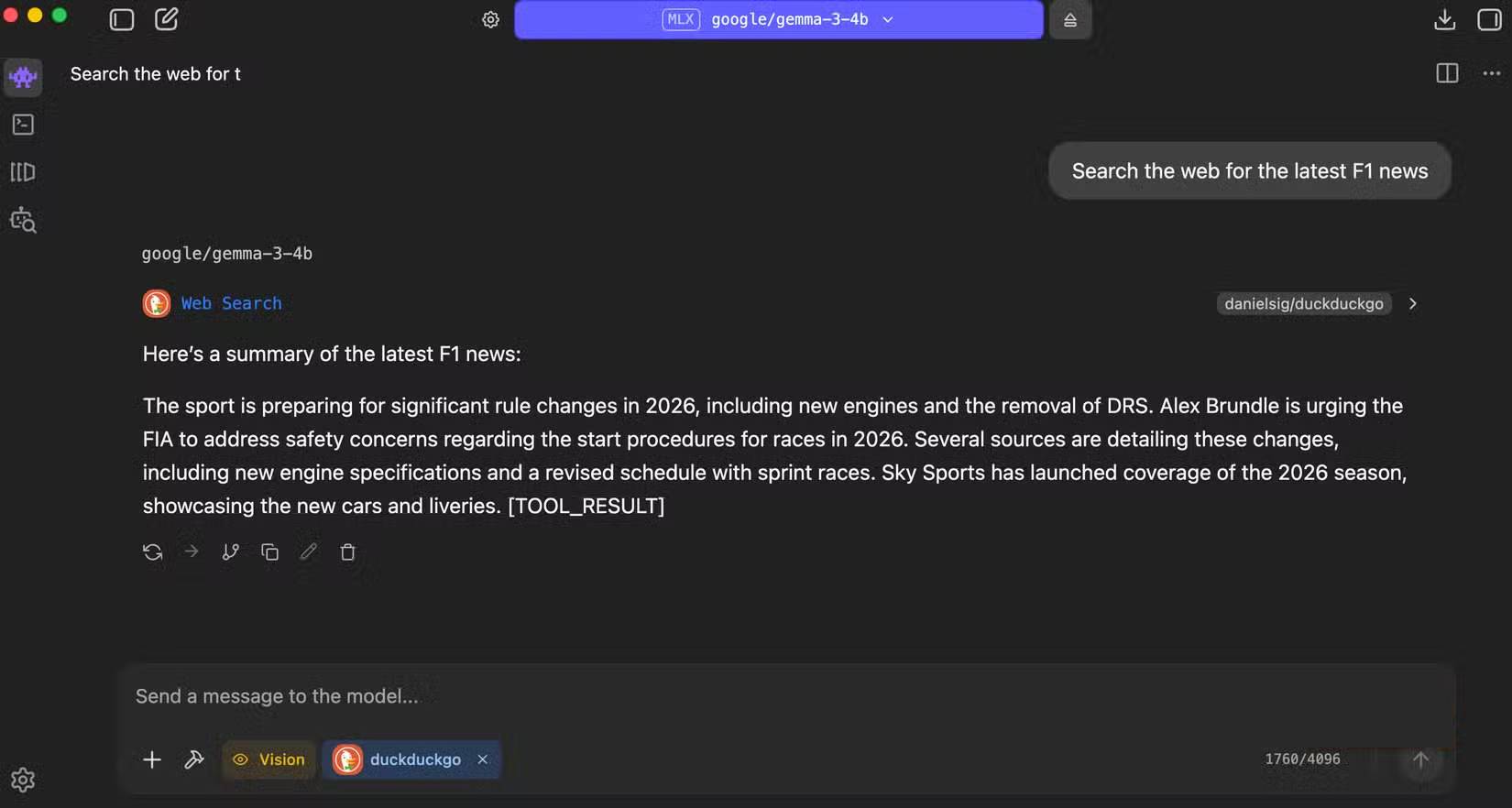

Đó là lý do tại sao họ quyết định thử LM Studio. Đây là một ứng dụng cho phép bạn tải xuống và chạy các mô hình LLM cục bộ trên máy tính của mình, và cũng có giao diện người dùng gọn gàng. Nếu bạn đang dùng máy Mac, hỗ trợ MLX sẽ rất quan trọng. Nếu bạn chưa biết, MLX là framework Machine Learning của Apple được thiết kế đặc biệt cho Apple Silicon.

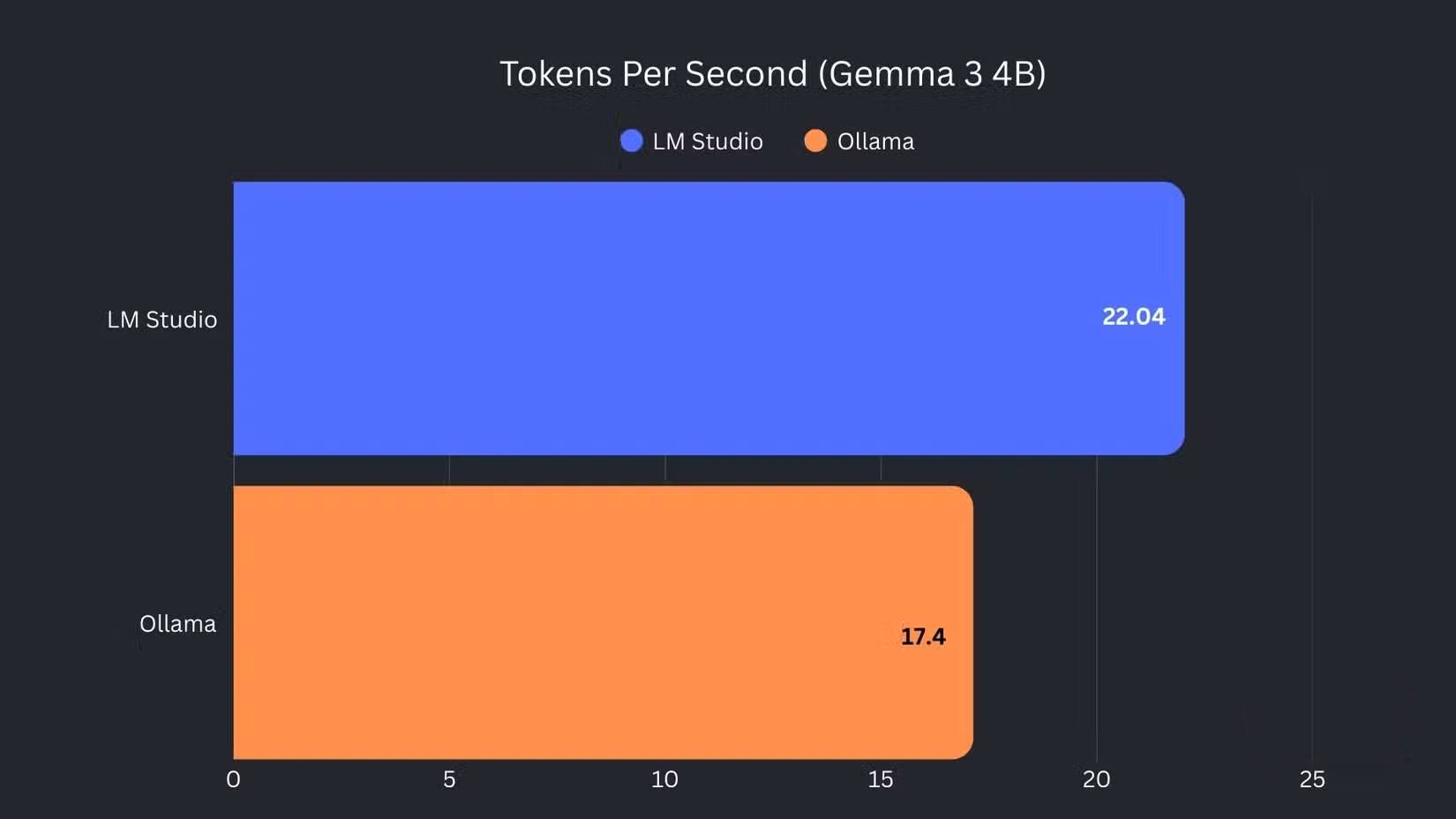

Về cơ bản, nó cho phép các mô hình chạy hiệu quả hơn bằng cách sử dụng GPU. Nhưng dù sao, vẫn nên so sánh Ollama và LMStudio trực tiếp với cùng một mô hình để có số liệu cụ thể.

Ollama có số token mỗi giây cao hơn với LM Studio, nhưng sự khác biệt không đáng kể nên không thực sự thay đổi trải nghiệm tổng thể. Tuy nhiên, bất kỳ cải thiện hiệu năng nào cũng đáng lưu ý.

Việc chọn Ollama hay LM Studio tạo ra sự khác biệt lớn, đặc biệt là vì cả hai đều dựa trên các framework nền tảng tương tự để chạy mô hình cục bộ.

Khi mới bắt đầu, nhiều người chỉ phàn nàn về việc thiếu hỗ trợ đa phương thức. Nhưng giờ đây điều đó không còn là vấn đề nữa. Cả Ollama và LM Studio hiện đều hỗ trợ các mô hình đa phương thức. Có một vài lựa chọn tốt có thể xử lý văn bản và hình ảnh khá hiệu quả trên phần cứng cục bộ.

Chọn đúng mô hình có thể hơi khó khăn

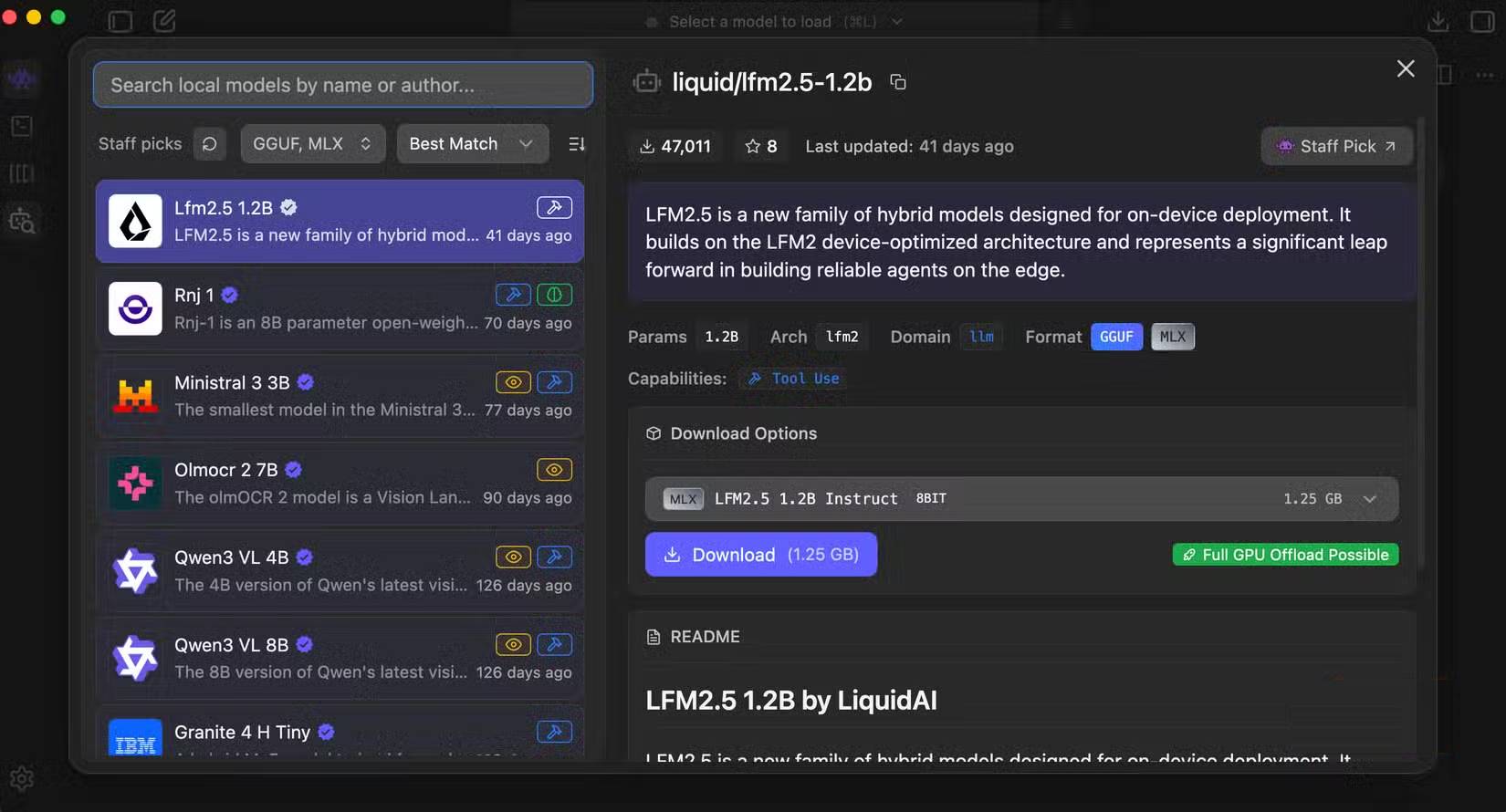

Sau khi cài đặt LM Studio lần đầu tiên, điều đầu tiên bạn cần làm là chọn một mô hình. Điều đó có thể hơi khó khăn nếu bạn mới bắt đầu, vì không có câu trả lời rõ ràng kiểu "chỉ cần dùng cái này". Lựa chọn đúng thực sự phụ thuộc vào phần cứng của bạn.

Nếu mở menu Model Search trong LM Studio, bạn sẽ thấy danh sách các mô hình phổ biến nhất. Một cách đơn giản để hiểu mức độ yêu cầu của một mô hình là nhìn vào con số ngay trước chữ "B" trong tên của nó.

Chữ "B" đó đại diện cho hàng tỷ tham số. Nói chung, con số đó càng cao, mô hình càng có khả năng. Điều này cũng có nghĩa là nó sẽ yêu cầu nhiều tài nguyên hơn. Trên máy Mac với 8GB bộ nhớ hợp nhất, khoảng từ 3 đến 4 tỷ tham số là mức lý tưởng. Mọi thứ có thể trở nên phức tạp hơn một chút trên PC. Thay vì RAM hệ thống thông thường, dung lượng VRAM bạn có mới là yếu tố quan trọng hơn.

Nếu có 8GB VRAM, bạn có thể thoải mái thử nghiệm với các mô hình tham số 7B, đặc biệt là với những lượng tử hóa nhẹ hơn. Theo kinh nghiệm, cách tiếp cận tốt nhất là bắt đầu với một mô hình nhỏ hơn và dần dần tăng lên cho đến khi bạn tìm thấy điểm tối ưu.

Nhiều người thiên về mô hình Gemma 3 4B hơn, được xây dựng trên cùng nền tảng với các mô hình Gemini của Google. Tuy nhiên, bạn vẫn nên thử các mô hình Qwen. Tùy thuộc vào những gì bạn đang làm, chúng có thể phù hợp hơn nhiều.

Bạn thậm chí có thể thêm chức năng tìm kiếm web vào LLM cục bộ của mình

DuckDuckGo sẽ giúp bạn giải quyết vấn đề này

Một trong những lời phàn nàn lớn nhất về các LLM cục bộ là chúng có cảm giác hạn chế so với những LLM đám mây như ChatGPT khi nói đến tìm kiếm web. Sẽ chẳng giúp ích gì nếu bạn hỏi về iPhone mới nhất, mà LLM lại bắt đầu nói về iPhone 14. Đó là một lĩnh vực mà các mô hình đám mây thường chiếm ưu thế hơn.

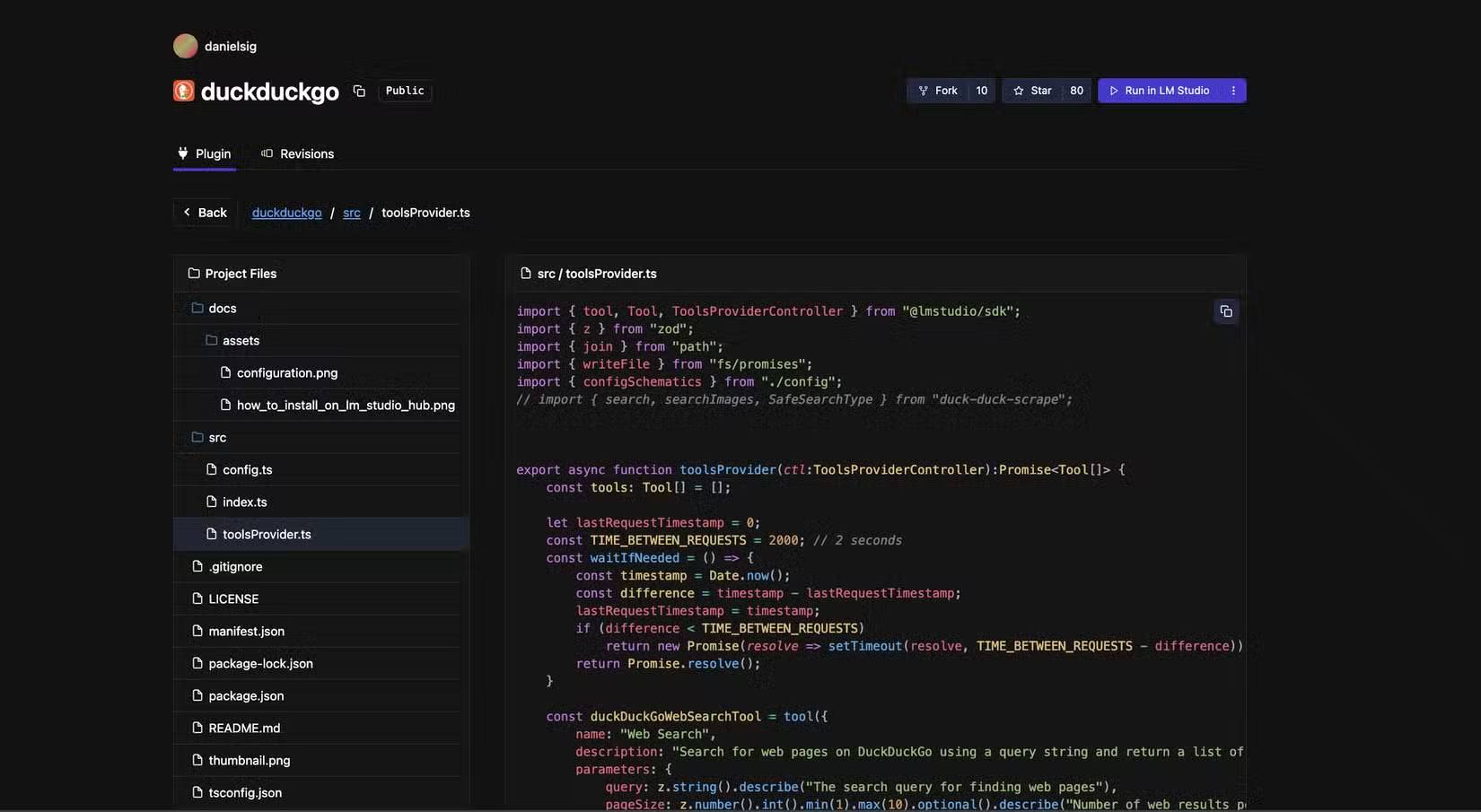

LM Studio có hệ thống plugin tích hợp sẵn, và việc thêm tìm kiếm trên web khá đơn giản. Chỉ cần truy cập trang plugin DuckDuckGo và chọn Run trong LM Studio.

Sau khi được kích hoạt, mỗi khi chạy một mô hình, bạn sẽ thấy một tùy chọn bên dưới hộp trò chuyện hỏi bạn có muốn sử dụng DuckDuckGo cho truy vấn của mình hay không. Nếu bạn bật nó lên, LM Studio sẽ lấy kết quả tìm kiếm trực tiếp và đưa chúng vào mô hình trước khi tạo ra phản hồi.

Tuy nhiên, đó không phải là tất cả những gì bạn có thể làm với các plugin. Nhóm LM Studio đã xây dựng một vài plugin cũng rất hữu ích. Ví dụ, họ có một plugin Wikipedia cho phép LLM của bạn đọc và tìm kiếm các bài viết từ Wikipedia.

Ngoài ra còn có một plugin JavaScript Sandbox, rất hữu ích nếu bạn thích lập trình theo cảm hứng và muốn nhanh chóng xây dựng một ý tưởng sơ bộ. Nhưng nó không đủ đáng giá để tạo ra thứ gì đó sẵn sàng cho sản xuất.

Bạn có thể thiết lập LM Studio để truy cập LLM từ điện thoại của mình, nhưng nếu muốn chuyển toàn bộ quá trình suy luận trực tiếp lên điện thoại, điều đó cũng hoàn toàn khả thi. Bạn có thể chạy các mô hình LLM nhỏ hơn trên điện thoại Android, mặc dù chúng sẽ không mạnh mẽ bằng những gì mình nhận được trên máy Mac.

Tuy nhiên, các mô hình nhẹ này đang được cải thiện với tốc độ chóng mặt. Và với dự đoán chi phí phần cứng sẽ tăng lên, chẳng có gì ngạc nhiên nếu các công ty như OpenAI hoặc Google tăng giá thuê bao của mình. Thật yên tâm khi có một thiết lập không bị ảnh hưởng bởi bất kỳ điều gì trong số đó.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hệ thống

Hệ thống

Windows 11

Windows 11

Windows 10

Windows 10

Windows 7

Windows 7

Windows 8

Windows 8

Cấu hình Router/Switch

Cấu hình Router/Switch

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học