Chỉ vài ngày sau khi ra mắt tính năng Deep Research dựa trên nền tảng Gemini 2.5 Pro Experimental, Google tiếp tục giới thiệu mô hình AI mới thú vị mang tên DolphinGemma. Đây về cơ bản là một mô hình ngôn ngữ lớn (LLM) được thiết kế để giúp các nhà khoa học "nghiên cứu cách cá heo giao tiếp" và "hy vọng tìm ra chúng đang nói gì".

(Gemma là họ mô hình ngôn ngữ lớn nhẹ do Google phát triển. Phiên bản mới nhất, Gemma 3, có bốn kích thước: 1 tỷ, 4 tỷ, 12 tỷ và 27 tỷ tham số).

Dự án này là sự hợp tác giữa Google, các nhà nghiên cứu tại Học viện Công nghệ Georgia (Mỹ) và Dự án Cá heo Hoang dã (Wild Dolphin Project - WDP) do Tiến sĩ Denise Herzing sáng lập. WDP tập trung vào việc quan sát, ghi chép và phân tích hành vi tự nhiên, cấu trúc xã hội, mô hình giao tiếp cũng như môi trường sống của loài cá heo đốm Đại Tây Dương (Stenella frontalis) thông qua "nghiên cứu thực địa dài hạn, không xâm lấn".

Trong nhiều năm, WDP đã thu thập dữ liệu liên kết các âm thanh cụ thể của cá heo với hành vi tương ứng. Ví dụ:

- Tiếng huýt đặc trưng (tên riêng) được cá heo mẹ và con dùng để nhận diện nhau.

- Tiếng rít dạng xung (burst-pulse "squawks") thường xuất hiện trong các cuộc xung đột.

- Tiếng lách cách nhanh (click "buzzes") dùng khi tán tỉnh hoặc đuổi cá mập.

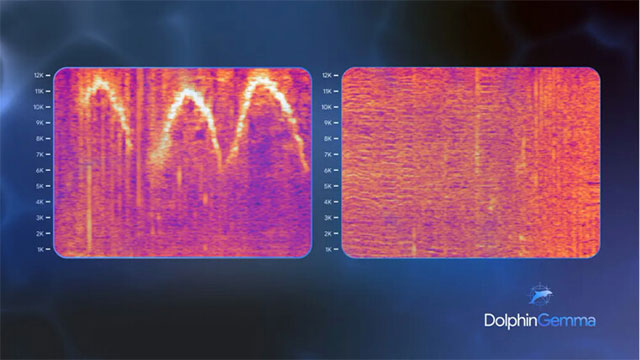

Theo Google, "việc phân tích giao tiếp phức tạp của cá heo là nhiệm vụ khổng lồ, và bộ dữ liệu được gắn nhãn của WDP tạo cơ hội độc nhất để ứng dụng AI tiên tiến". DolphinGemma ra đời từ ý tưởng đó. Mô hình AI này do Google phát triển dựa trên dữ liệu của WDP, sử dụng bộ mã hóa SoundStream của chính hãng để chia nhỏ âm thanh cá heo thành các đơn vị âm thanh dễ xử lý. Dữ liệu thu được sau đó được đưa qua kiến trúc mô hình chuyên biệt nhằm giải mã các chuỗi phức tạp. Toàn bộ hệ thống có khoảng 400 triệu tham số, đủ nhẹ để chạy trực tiếp trên điện thoại Pixel mà các nhà nghiên cứu WDP mang theo ra hiện trường.

Khác với mô hình học máy truyền thống, DolphinGemma không xử lý văn bản hay hình ảnh mà hoạt động hoàn toàn dựa trên âm thanh: đầu vào và đầu ra đều là âm thanh. Thuật toán tiếp nhận chuỗi âm thanh tự nhiên của cá heo, xử lý bằng phương pháp lấy cảm hứng từ cách LLM hiểu lời nói con người, sau đó dự đoán âm thanh có khả năng xuất hiện tiếp theo trong chuỗi.

Tiến sĩ Denise Herzing so sánh DolphinGemma với tính năng tự động hoàn thành (autocomplete) nhưng dành cho tiếng huýt, xung rít và chuỗi lách cách của cá heo. Mô hình được huấn luyện để nhận diện mẫu hình, cấu trúc và trình tự của các âm thanh này, tương tự cách mô hình văn bản dự đoán từ tiếp theo dựa trên ngữ cảnh.

Trước khi có DolphinGemma, nhóm WDP từng sử dụng hệ thống CHAT (Cetacean Hearing Augmentation Telemetry) để khám phá khả năng giao tiếp hai chiều với cá heo. Mục tiêu của CHAT không phải giải mã toàn bộ ngôn ngữ phức tạp, mà xây dựng từ vựng chung đơn giản để tương tác.

CHAT hoạt động bằng cách liên kết các tiếng huýt tổng hợp (do hệ thống tạo) với những vật thể cá heo thích, như tảo bẹ, cỏ biển hoặc khăn choàng mà các nhà nghiên cứu sử dụng. Hy vọng là bằng cách lặp lại sự liên kết này, cá heo sẽ bắt chước âm thanh để "yêu cầu" các vật thể đó.

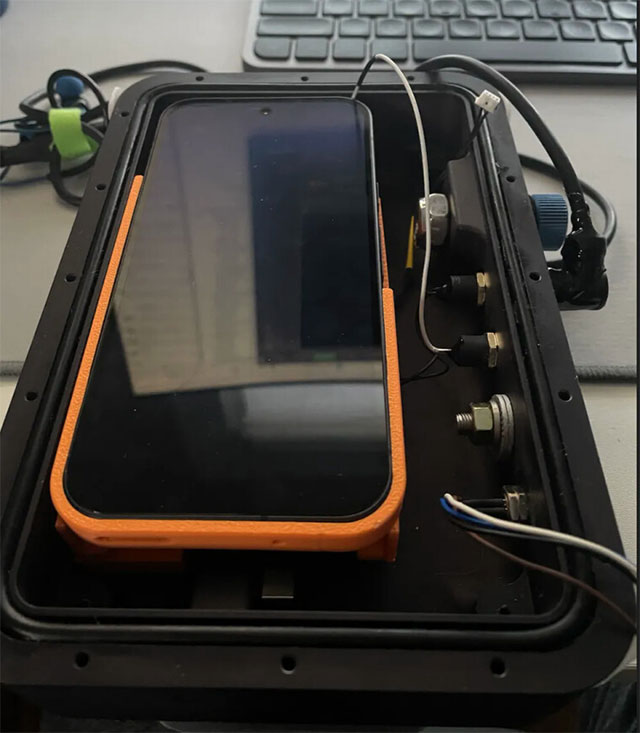

CHAT chạy trên Pixel 6 - thiết bị xử lý phân tích âm thanh chất lượng cao theo thời gian thực. Việc dùng điện thoại thông thường giúp nhóm nghiên cứu không cần trang bị tùy chỉnh, giảm chi phí, kích thước và dễ bảo trì khi làm việc ngoài biển.

Trong giai đoạn nghiên cứu tới, nhóm sẽ nâng cấp lên Pixel 9 với loa và micrô tốt hơn, đủ sức chạy song song mô hình học sâu và nhận diện mẫu hình.

Tương tự các mô hình Gemma khác, Google cho biết sẽ công bố DolphinGemma dưới dạng mô hình mở vào mùa hè này, nhằm "trao công cụ cho giới nghiên cứu toàn cầu khai thác dữ liệu âm học riêng, đẩy nhanh việc tìm kiếm mẫu hình và cùng nhau hiểu sâu hơn về loài thú biển thông minh này".

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

Làng Công nghệ

Làng Công nghệ  Bảo mật mạng

Bảo mật mạng  Chuyện công nghệ

Chuyện công nghệ  Công nghệ mới

Công nghệ mới  Trí tuệ Thiên tài

Trí tuệ Thiên tài

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống