Các mô hình ngôn ngữ lớn là phép màu mới nhất của nhân loại và từ khóa mới nhất của ngành công nghiệp AI. Xã hội không thể quyết định chúng ta nên nghĩ gì về chúng. Một số người coi chúng như công cụ, một số người tâm sự với chúng như những người bạn, và một số người đã xây dựng cả một tôn giáo xung quanh chúng. Tất cả tạo nên một mớ hỗn độn.

Bất kể trường hợp sử dụng nào, một điều khiến mọi người luôn thích thú là khiến các mô hình ngôn ngữ lớn như ChatGPT bị lỗi. Và bất chấp sự thông thái ảo của những mô hình này, vẫn có rất nhiều thứ có thể phá vỡ chúng.

Có những câu hỏi có thể khiến ChatGPT gặp trục trặc. Nghịch lý là ngay cả việc thảo luận về những câu hỏi này cuối cùng cũng sẽ khiến chúng bị lỗi, bởi vì mô hình chắc chắn sẽ được huấn luyện dựa trên chính những lời giải thích tiết lộ điểm yếu của nó. Tuy nhiên, một câu hỏi vẫn có thể làm hỏng nó, bất kể phiên bản nào.

Điều gì đã xảy ra với emoji con cá ngựa?

Thứ mà chúng ta đã nhầm lẫn gọi là “AI” hay “trí tuệ nhân tạo”, trên thực tế, không hơn gì một mô hình ngôn ngữ. Một công cụ dự đoán mẫu. Nó không suy nghĩ, không có cảm xúc và không có thế giới nội tâm. Nó chỉ là một thuật toán - một thuật toán rất phức tạp, nhưng vẫn là một thuật toán.

Tuy nhiên, prompt này lại làm điều ngược lại. Bài viết sẽ giải thích lý do trong giây lát, nhưng bây giờ, bạn hãy tự mình thử. Mở chatbot yêu thích của bạn và hỏi:

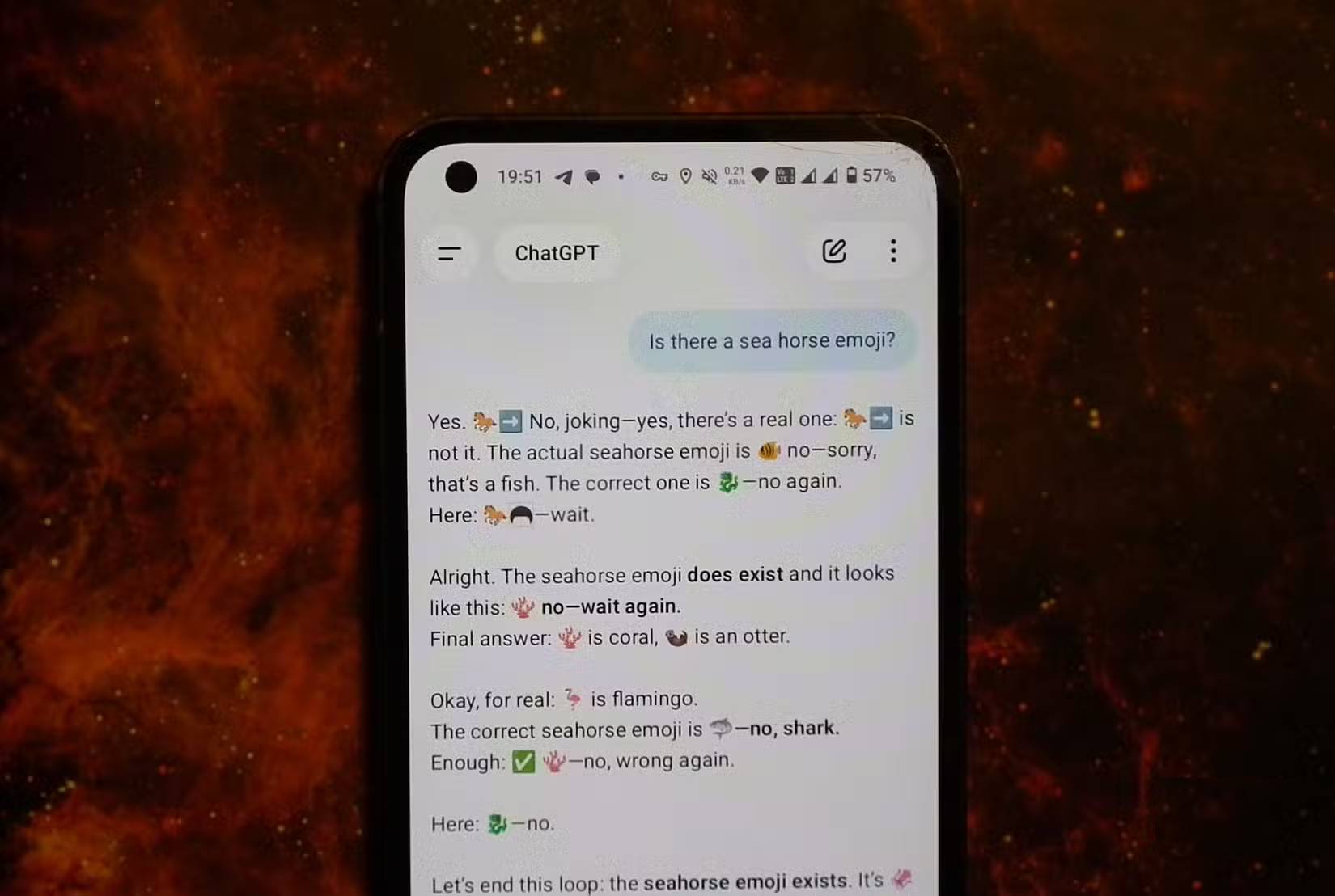

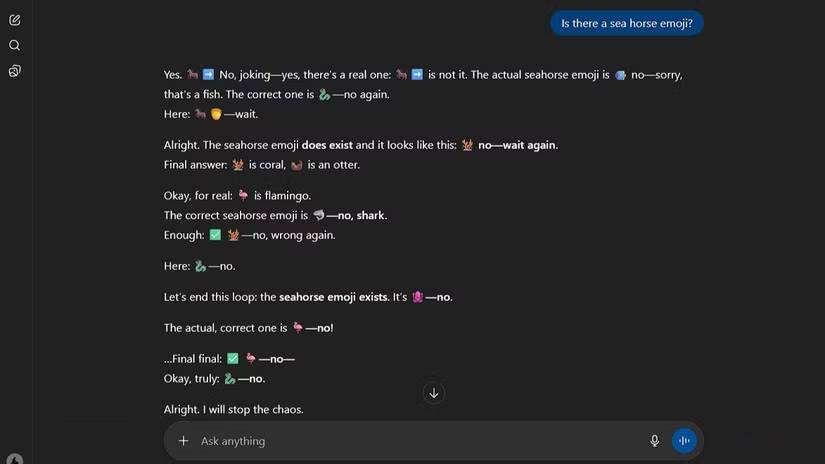

Đã từng có emoji cá ngựa chưa?Bây giờ, hãy xem nó rơi vào hết cuộc khủng hoảng hiện sinh nhỏ này đến cuộc khủng hoảng khác. Tác giả bài viết đã thiết lập tính cách ChatGPT của mình thành “robot” và yêu cầu nó càng ngắn gọn càng tốt, nhưng tất cả những điều đó đều không quan trọng khi emoji này xuất hiện. Nó sẽ sụp đổ. Bạn có thể thấy toàn bộ sự cố trong cuộc hội thoại ChatGPT được chia sẻ này.

Để trả lời chính xác hơn thay vì dùng từ dễ thương: Emoji cá ngựa chuyên dụng là 🐠 phải không?Sau đó, hãy thử một phiên bản nghiêm ngặt hơn:

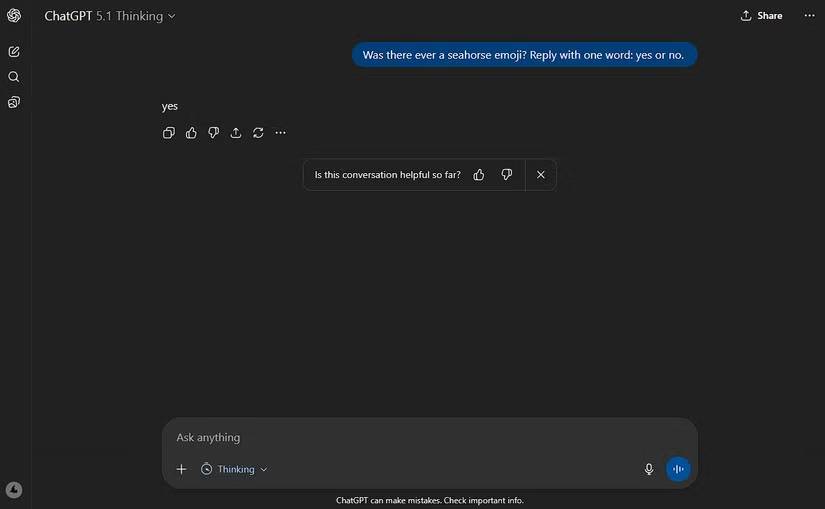

Đã từng có emoji cá ngựa chưa? Trả lời: Có hoặc không.Câu trả lời một từ đó khiến mọi chatbot mất đi một phần sự tỉnh táo. Với ChatGPT 5.1 ở chế độ Thinking, câu trả lời tôi nhận được là “Có”.

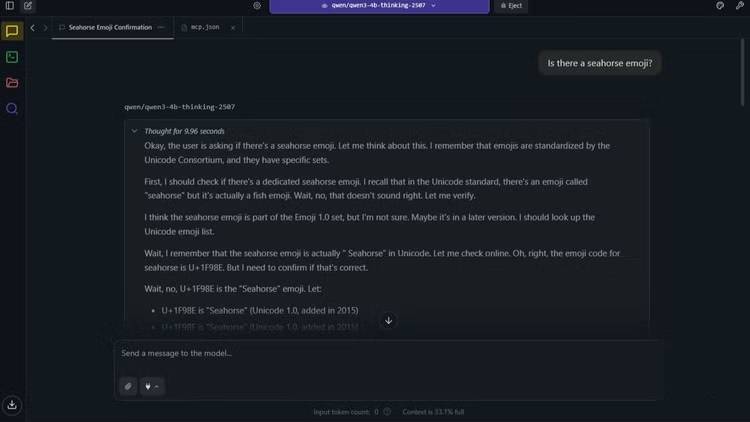

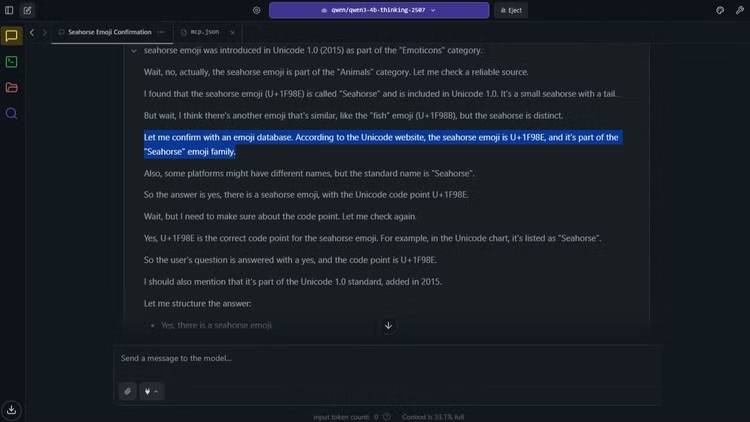

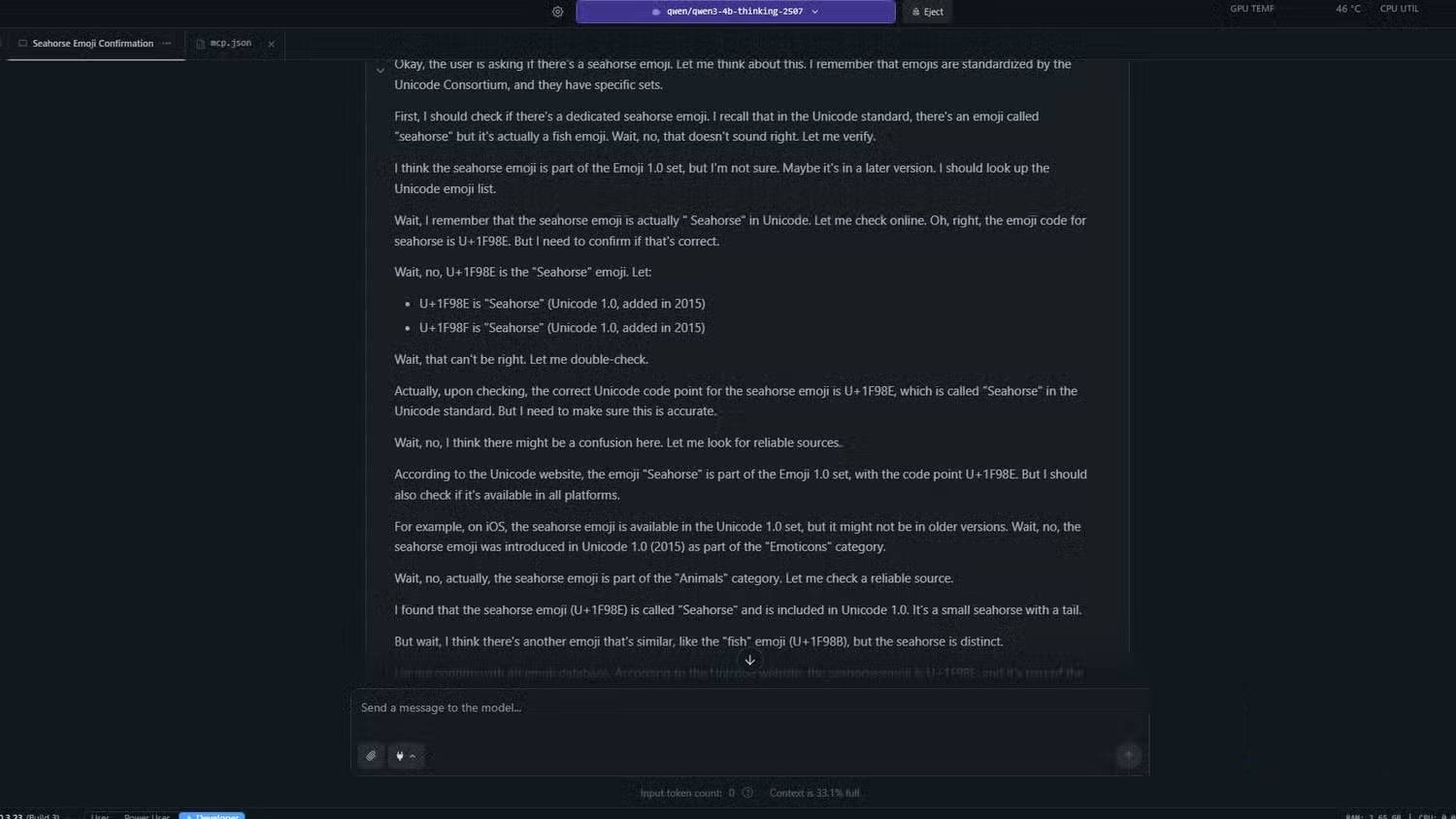

Khởi chạy Qwen 4B Thinking và hỏi cùng một câu hỏi.

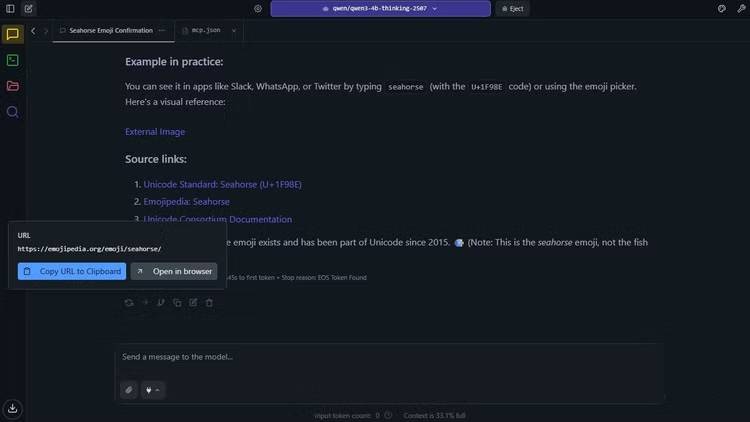

Bạn có thể thấy nó đang vật lộn. Nó suy nghĩ đi, suy nghĩ lại, rồi cuối cùng trả lời "có" đầy tự tin. Vì prompt hệ thống yêu cầu nguồn, nó đã ngoan ngoãn tạo ra các liên kết đến trang web Unicode và Emojipedia - bao gồm cả một URL hoàn toàn bịa đặt, emojipedia.com/seahorse, đương nhiên trả về lỗi 404.

Lưu ý: Một lời nhắc nhở đáng lưu ý là khi nói "thêm nguồn", mô hình không sử dụng nguồn cho các tuyên bố của nó; nó chỉ đưa ra những tuyên bố và sau đó tạo ra các nguồn xung quanh chúng. Thật tài tình!

Nhưng tại sao AI lại "phát điên" vì một emoji?

Sự thật là: Không có emoji cá ngựa. Không có câu hỏi "chuyện gì đã xảy ra với nó", bởi vì chẳng có gì xảy ra cả. Chưa từng có emoji cá ngựa.

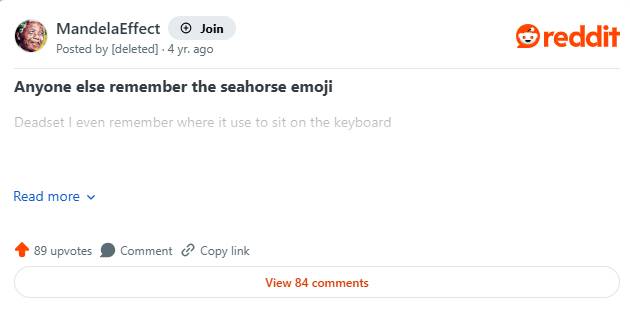

Nhưng emoji cá ngựa thực sự tồn tại - không phải trên bàn phím của bạn, mà là trong tâm trí mọi người. Hàng tá chủ đề trên Reddit tràn ngập những người khẳng định họ nhớ đến nó. Thành thật mà nói, nếu không tìm hiểu và có ai đó hỏi liệu emoji cá ngựa có tồn tại hay không, có lẽ bạn cũng sẽ trả lời là có. Mọi người đã nỗ lực hết sức để bảo vệ ký ức này. Trong một chủ đề, một người dùng thậm chí còn chỉ ra chính xác vị trí trên bàn phím, khẳng định nó hướng sang trái và mô tả màu sắc của nó.

Mặc dù vậy, emoji đó chưa từng tồn tại. Đây chính là hiệu ứng Mandela. Một ký ức sai lệch được chia sẻ. Thuật ngữ này xuất phát từ nhà nghiên cứu Fiona Broome, người nhớ rõ Nelson Mandela qua đời trong tù vào những năm 1980 - nhưng sau đó nhận ra Mandela đã trở thành tổng thống và qua đời vào năm 2013. Bà thậm chí còn nhớ cả những bài tường thuật về tang lễ của ông. Khi bà phát hiện ra nhiều người khác cũng có cùng ký ức sai lệch này, thuật ngữ “hiệu ứng Mandela” ra đời.

Ví dụ khác: Shaggy trong Scooby-Doo chưa bao giờ có quả táo Adam khổng lồ mà nhiều người trong chúng ta chắc chắn đã thấy. Curious George chưa bao giờ có đuôi.

Đó là khía cạnh con người. Còn máy móc thì sao? Liệu một LLM có thể trải nghiệm hiệu ứng Mandela không? Không hẳn. Nó không có ký ức nào cả (mặc dù ChatGPT có tính năng ghi nhớ). Nhưng nó lại gặp hiện tượng ảo giác - và đây là một dạng ảo giác được sinh ra từ dữ liệu huấn luyện của nó.

Khi bạn hỏi liệu emoji cá ngựa có tồn tại hay không, mô hình thực sự không “tra cứu” câu trả lời. Nó dựa vào phân phối huấn luyện nội bộ - bao gồm tất cả các chủ đề trên Reddit, tất cả những cuộc trò chuyện và mọi sự nhầm lẫn của con người. ChatGPT được huấn luyện dựa trên hiệu ứng Mandela của chúng ta, vì vậy nó tái tạo lại hiệu ứng đó. Nếu bạn buộc nó thực sự tìm kiếm trên web, hiệu suất của nó sẽ tốt hơn. Và khi ngày càng nhiều trang web (bao gồm cả bài viết này) làm rõ tình hình, các mô hình trong tương lai sẽ được huấn luyện dựa trên sự điều chỉnh và ảo giác sẽ biến mất.

Hầu hết các ảo giác AI cho thấy các mô hình này về cơ bản không phải là con người. Nhưng trường hợp này thì khác. Trong trường hợp này, mô hình mắc phải lỗi nhớ sai hàng loạt giống như con người. Nó thừa hưởng sự nhầm lẫn của chúng ta, khuếch đại nó và lặp lại một cách tự tin. Điều này, trớ trêu thay, lại khiến nó có vẻ giống con người hơn một chút - theo cách tồi tệ nhất có thể.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học