Mới đây các nhà nghiên cứu tại trường đại học Harvard và phòng thí nghiệm AI-MIT Watson của MIT đã tạo ra công cụ GLTR (Giant Language Model Test Room - Phòng thử nghiệm mô hình ngôn ngữ khổng lồ) để phát hiện những thông tin sai lệch được làm từ AI, bằng cách sử dụng chính trí tuệ thông minh nhân tạo.

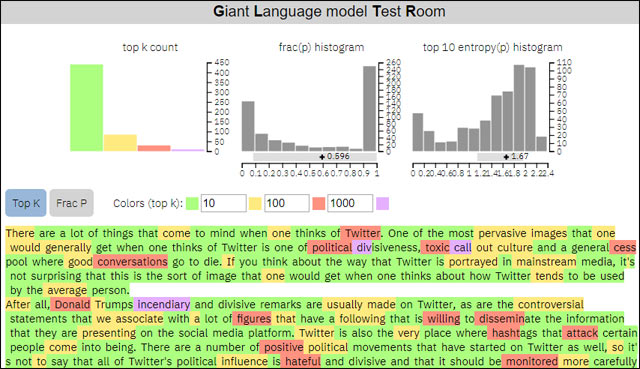

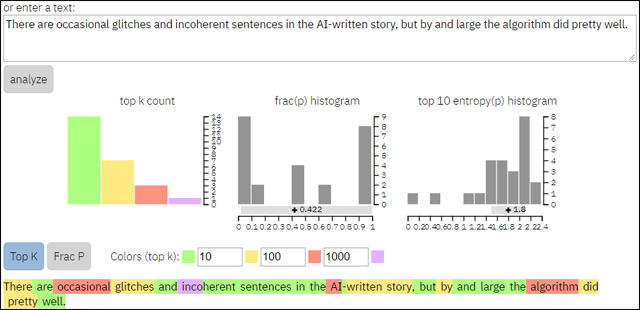

Công cụ GLTR nắm rất rõ cách thức mà các AI hoạt động để từ đó phân tích nội dung thông tin. Công cụ này phát hiện fake news tạo bởi công nghệ AI bằng cách bôi màu một đoạn văn bản. Bạn đọc có thể theo dõi khả năng phân tích của GLTP trong hình minh họa dưới đây. Với những từ ngữ được bôi màu xanh lá cây nghĩa là chúng dễ dự đoán nhất, màu đỏ và vàng ít được dự đoán hơn, màu tím thuộc hạng ít được dự đoán nhất.

Các nhà khoa học dựa vào các màu sắc trong từng đoạn văn bản và phân tích để đánh giá tính xác thực của thông tin, liệu chúng có được tạo bằng những thuật toán hay không. Những đoạn văn bản được bôi màu đỏ, tím và vàng sẽ ít khả năng được tạo ra bởi AI do sử dụng nhiều từ ngữ khó. Nếu những đoạn văn bản được phủ nhiều màu xanh, nghĩa là có nhiều từ ngữ phổ biến và nhiều khả năng tạo ra bằng một con bot. Công cụ này giúp tăng tỷ lệ phát hiện văn bản giả mạo khoảng 72%.

Về cơ bản, các câu văn được viết bởi trình tạo văn bản AI có thể đúng về mặt ngữ pháp, nhưng chắc chắn sẽ có vấn đề về mặt ngữ nghĩa, hoặc thậm chí trong nhiều trường hợp còn không mang bất kỳ ý nghĩa thực tế nào.

Hiện nay, việc sử dụng AI và các mô hình tạo ngôn ngữ phi tự nhiên nhằm tạo ra tin tức giả mạo cũng như truyền bá thông tin sai lệch đang trở nên ngày càng phổ biến hơn, kéo theo đó là những hệ lụy nghiêm trọng cho xã hội. Những đoạn văn bản giả mạo này đôi khi được thực hiện cực kỳ công phu, khiến người đọc khó có thể nhận ra rằng chúng được viết bởi máy móc thay vì con người. Trong khi đó, công cụ GLTR lại được trang bị khả năng phân biệt chính xác loại văn bản giả mạo trên, đóng vai trò như một công cụ AI “thiên địch” hiệu quả. Đó cũng chính là ý tưởng cốt lõi của các nhà nghiên cứu trong dự án GLTR này.

Các sáng kiến tương tự như GLTR nên được đẩy mạnh cũng như sớm đi vào sử dụng rộng rãi trong thực tế. Chúng có giá trị không chỉ trong việc phát hiện văn bản giả mạo, mà còn đóng vai trò đặc biệt hiệu quả trong xác định các bot Twitter, vốn thường được sử dụng để gây rối trong các cuộc bầu cử ở Hoa Kỳ và nhiều quốc gia khác.

Dùng chính AI để phát hiện AI là biện pháp “thiên địch” hiệu quả

Dùng chính AI để phát hiện AI là biện pháp “thiên địch” hiệu quả

Trước khi GLTR ra đời, từng có một công cụ nhận diện dựa trên AI đã được sử dụng rộng rãi và tương đối hiện quả có tên Botometer. Về cơ bản, Botometer sử dụng các kỹ thuật học máy để xác định xem liệu một tài khoản bất kỳ đang được vận hành bởi con người hay bởi thuật toán phần mềm. Công cụ này có khả năng xác định các tài khoản bot, tài khoản giả mạo không phải do con người vận hành với độ chính xác lên tới 95%.

Một lần nữa, sự cần thiết phải tạo ra các hệ thống hợp tác AI-con người để giải quyết các vấn đề chung về công nghệ/xã hội lại được chỉ ra và nhấn mạnh. Đây là nhiệm vụ khó khăn, nhưng vô cùng cấp thiết của nhân loại trong kỷ nguyên kỹ thuật số- trí tuệ nhân tạo như hiện nay.

Xem thêm:

- Trí tuệ nhân tạo đã có thể viết được hẳn một bài báo chỉ từ vài thông tin

- AI đã tạo ra được những khuôn mặt như người thật, làm giả được xe cộ, nhà cửa và cả động vật

- Trí thông minh nhân tạo học cách tạo ra một trí thông minh nhân tạo khác, thay thế con người trong tương lai

- 6 bước để bắt đầu học lập trình trí tuệ nhân tạo (AI)

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống  Làng Công nghệ

Làng Công nghệ