Các công cụ AI trực tuyến đang trở nên cực kỳ tốt, nhưng ngay khi bắt đầu sử dụng chúng, bạn sẽ nhận ra rằng chi phí đăng ký của chúng nhanh chóng tăng lên. Các phiên bản miễn phí bị giới hạn quyền truy cập và thường chỉ cho phép bạn truy cập vào những mô hình kém hơn.

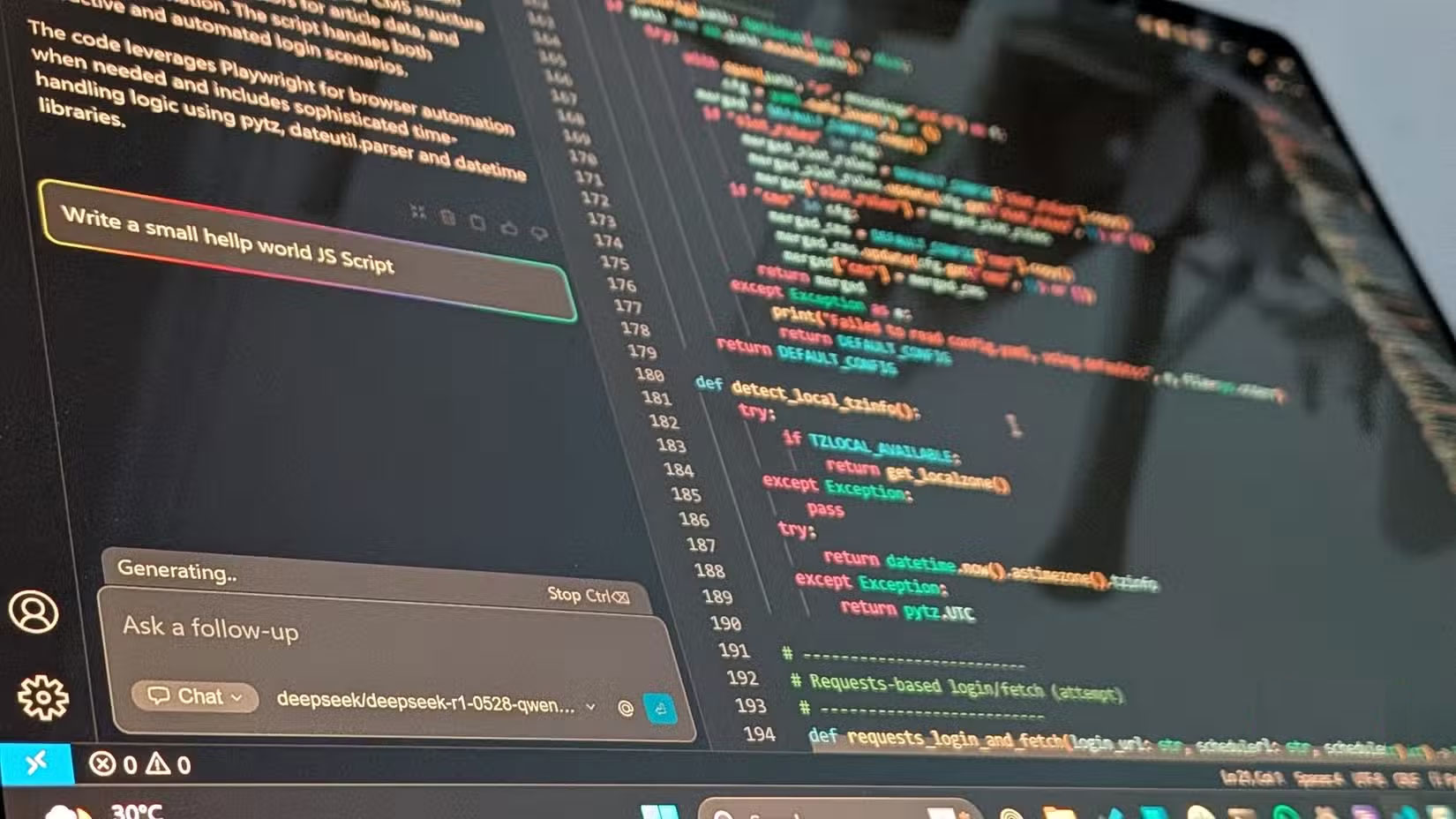

Khi xây dựng AI mã hóa cục bộ cho VS Code, nhiều người nghĩ mình đã xong việc trả tiền cho GitHub Copilot. Tuy nhiên, giữa những lo ngại về quyền riêng tư và chi phí đăng ký cao ngất ngưởng, họ nhận ra rằng mình không cần phải trả tiền cho AI nữa nếu có thể chạy các mô hình cục bộ.

Các mô hình AI cục bộ đang trở nên khá tốt

Các công cụ miễn phí cạnh tranh với những dịch vụ AI tên tuổi

Bối cảnh AI nguồn mở đã bùng nổ với một số mô hình thực sự ấn tượng. Mặc dù không có giải pháp nào phù hợp cho tất cả như GPT-5, nhưng có những mô hình như Llama, Mistral, Gemma và DeepSeek cực kỳ hiệu quả trong các tác vụ cụ thể. Và vì bạn đang chạy các mô hình này cục bộ, bạn có thể chọn mô hình mình muốn cho một tác vụ cụ thể mà không gặp rắc rối.

Các mô hình này cũng khá tốt so với những mô hình trả phí tương tự. Trong nhiều trường hợp, một mô hình mã nguồn mở được lựa chọn kỹ lưỡng chạy cục bộ có thể sánh ngang với hiệu suất của một AI nền tảng web như ChatGPT hoặc GitHub Copilot cho các tác vụ cụ thể.

Sự đa dạng của các mô hình AI rất đáng kinh ngạc, nghĩa là bạn sẽ có hàng trăm, nếu không muốn nói là nhiều hơn, những mô hình AI để thử nghiệm. Chỉ cần lưu ý rằng số lượng tham số càng lớn, yêu cầu phần cứng của mô hình AI càng cao.

Theo nguyên tắc chung, bạn cần ít nhất 8GB RAM để chạy các mô hình 7 tỷ tham số, 16GB cho mô hình 13 tỷ tham số và 32GB cho mô hình 33 tỷ tham số. Dung lượng ổ cứng lớn cũng rất hữu ích, vì một số mô hình AI này có thể khá lớn.

Bạn có thể chạy các mô hình AI cục bộ trên hầu hết mọi máy tính hiện đại. Các mô hình có số lượng tham số thấp hơn sẽ không thể xử lý những tác vụ phức tạp hơn, nhưng sẽ nhanh hơn khi sử dụng. Điều quan trọng là chọn mô hình phù hợp với yêu cầu của bạn.

Chạy AI cục bộ với LM Studio

Một ứng dụng đơn giản giúp AI cục bộ trở nên dễ dàng

Việc chạy các mô hình này cũng dễ dàng đến bất ngờ. Bạn có thể tận hưởng những lợi ích của một LLM cục bộ với rất nhiều ứng dụng, bao gồm LM Studio và Ollama.

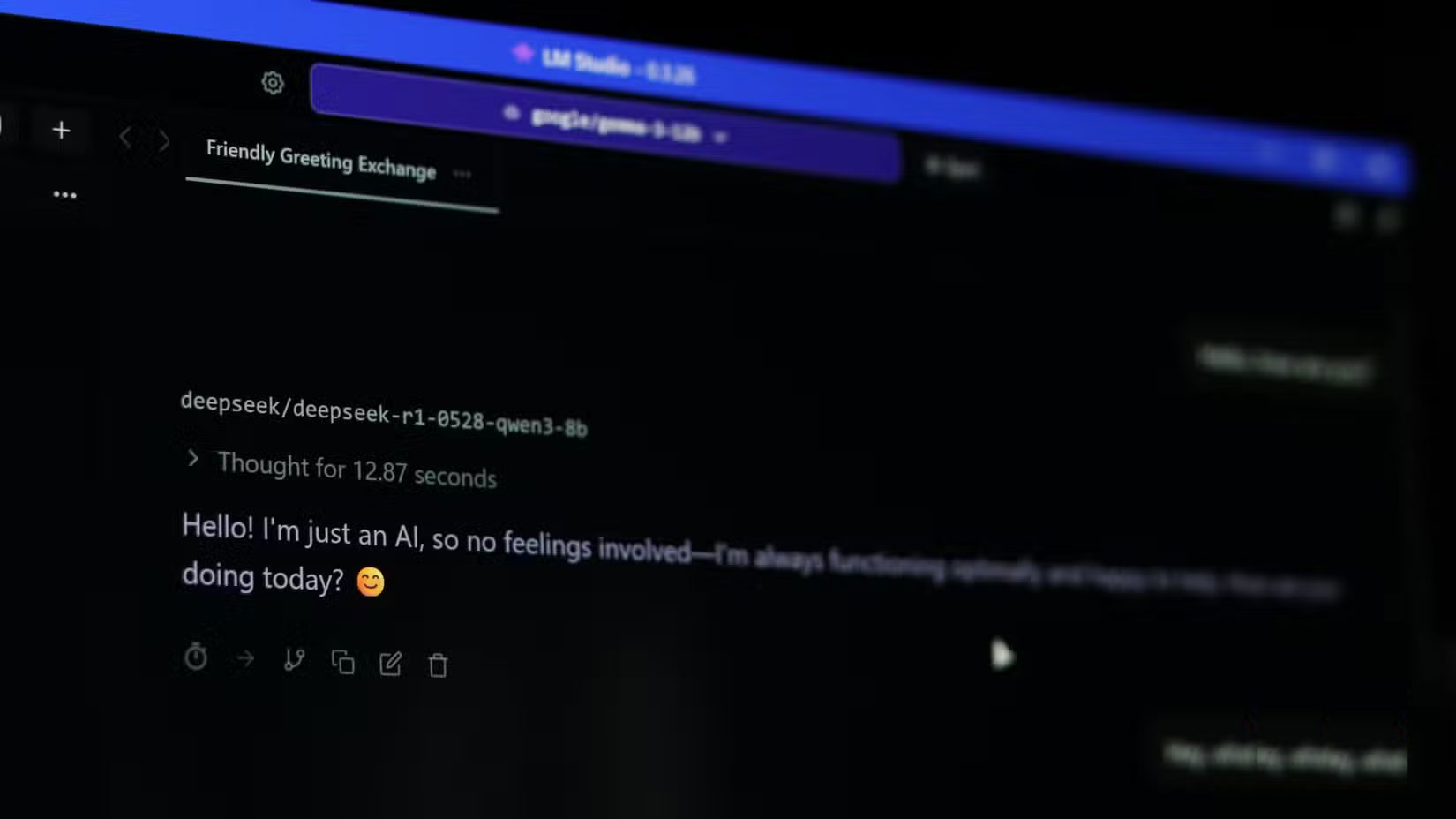

Những công cụ này cho phép bạn truy cập vào một loạt các mô hình AI nguồn mở mà bạn có thể tải xuống và chạy theo yêu cầu của mình. Mọi người thích LM Studio vì nó đi kèm với giao diện GUI khá dễ sử dụng, nhưng bạn có thể thoải mái thử các tùy chọn khác để tìm ra lựa chọn phù hợp nhất với mình.

Việc cài đặt và thiết lập LM Studio với mô hình AI khá dễ dàng. Tải xuống LM Studio từ trang web chính thức và chạy trình cài đặt. Làm theo các bước sau khi chạy LM Studio lần đầu tiên:

- Bạn có thể được nhắc thực hiện theo trình hướng dẫn thiết lập. Bạn có thể bỏ qua bước này bằng cách nhấp vào nút Skip màu xám ở góc trên bên phải.

- Sau khi giao diện chính load xong, LM Studio sẽ tự động bắt đầu tải xuống bất kỳ driver hoặc bản cập nhật nào cần thiết. Hãy đợi các bước này hoàn tất trước khi tiếp tục.

- Nhấp vào biểu tượng kính lúp để mở tab Discover và tìm kiếm mô hình bạn muốn tải xuống. Nhấp vào nút Download màu xanh lá cây ở góc dưới bên trái để tiếp tục.

- Sau khi mô hình tải xuống xong, hãy chuyển đến phần Chat và nhấp vào menu drop-down ở đầu màn hình để load mô hình đã tải xuống.

Đến bước này, bạn có thể bắt đầu trò chuyện với mô hình AI đã tải xuống. Tùy thuộc vào mô hình đang sử dụng, bạn có thể yêu cầu nó đọc và phân tích các file. LM Studio đánh dấu rõ ràng mô hình nào có khả năng gì, vì vậy bạn có thể tìm thấy các mô hình có khả năng đọc hoặc tạo hình ảnh.

Cuối cùng cũng có thể sử dụng AI cho công việc nhạy cảm

Bảo mật dữ liệu của bạn

Một số người đã sử dụng nhiều chatbot miễn phí nên không bao giờ phải trả một xu nào cho AI, nhưng đây vẫn là các công cụ web được đào tạo dựa trên dữ liệu của họ. Điều đó có nghĩa là việc sử dụng AI cho công việc nhạy cảm như lập trình là điều không thể. Bên cạnh đó, hầu hết các chatbot AI đều có chính sách sử dụng cấm bạn dùng đầu ra AI cho mục đích thương mại cho đến khi bạn đăng ký gói phù hợp.

Chạy AI cục bộ sẽ thoát khỏi những hạn chế này. Các cuộc trò chuyện với chatbot AI của bạn không bao giờ rời khỏi máy tính, điều đó có nghĩa là bạn có thể thoải mái tích hợp AI vào những dự án mà trước đây chưa bao giờ làm. Không cần thu thập dữ liệu, không cần đào tạo về thông tin đầu vào, và không có sự giám sát của công ty đối với quy trình sáng tạo. Có một chatbot AI bảo vệ quyền riêng tư của bạn, nhưng nó không hoàn toàn giống với việc chạy AI cục bộ.

Đây không chỉ là vấn đề về bảo mật dữ liệu. Việc chạy các mô hình AI cục bộ mang lại cho bạn sự tự do sáng tạo mà không cần lo lắng về chính sách lưu giữ dữ liệu hay khả năng bị lạm dụng. Bạn có thể sử dụng AI cho các dự án công việc nhạy cảm, viết lách cá nhân và bất kỳ ý tưởng thử nghiệm nào mà không cần lo lắng. Đối với các chuyên gia xử lý thông tin mật, chỉ riêng khía cạnh bảo mật đã đủ để biện minh cho việc chuyển đổi này.

Thoát khỏi đăng ký AI

Sở hữu thiết lập AI của riêng bạn

Nếu bạn đã chán việc trả phí đăng ký hàng tháng cho các công cụ AI, hãy thử tải xuống LM Studio hoặc bất kỳ lựa chọn thay thế nào và dành một buổi chiều để thử nghiệm các mô hình AI. Mistral 7B Instruct và Gemma 3 là những mô hình tốt để bắt đầu.

Bạn không cần phải ngừng đăng ký tất cả các gói đăng ký ngay lập tức. Hãy giữ lại những gói quan trọng khi bạn thử nghiệm, sau đó giảm dần khi bạn tìm thấy các mô hình cục bộ đáp ứng nhu cầu của mình. Bạn có thể hủy gần như tất cả các gói đăng ký của mình trong tháng đầu tiên.

AI cục bộ có những lợi ích mà các công cụ trực tuyến không có, và điều đó hoàn toàn xứng đáng với việc mất đi một số hiệu suất hoặc trí tuệ. Đừng trả tiền cho các gói đăng ký AI vì bạn không cần phải làm vậy!

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học