GPT-4o của OpenAI tích hợp các khả năng âm thanh, hình ảnh và văn bản vào một mô hình ngôn ngữ mạnh mẽ duy nhất. Sự phát triển này đánh dấu một bước tiến đáng kể hướng tới tương tác giữa người và máy tính tự nhiên, trực quan hơn. Bài viết này sẽ cung cấp hướng dẫn từng bước về cách sử dụng GPT-4o thông qua API OpenAI.

Mặc dù OpenAI gần đây đã phát hành mô hình O1 - mô hình lý luận có khả năng nhất của mình - GPT-4o và GPT-4o mini vẫn là những lựa chọn tốt nhất cho các ứng dụng yêu cầu phản hồi nhanh, xử lý hình ảnh hoặc gọi hàm.

Mục lục bài viết

- GPT-4o là gì?

- Các trường hợp sử dụng GPT-4o

- API GPT-4o: Cách kết nối với API của OpenAI

- API GPT-4o: Các trường hợp sử dụng âm thanh

- GPT-4o API: Các trường hợp sử dụng thị giác

- Giá API GPT-4o

- Những cân nhắc chính với API GPT-4o

- Câu hỏi thường gặp

- GPT-4o là gì và nó khác với các mô hình trước như thế nào?

- Các nhà phát triển có thể truy cập GPT-4o thông qua API OpenAI như thế nào?

- Chi phí sử dụng API GPT-4o là bao nhiêu và nó khác với các mô hình khác như thế nào?

- GPT-4o có thể được tinh chỉnh cho các trường hợp sử dụng hoặc ngành cụ thể không?

- Có những tài nguyên nào để tìm hiểu thêm và triển khai API GPT-4o?

- Khi nào nên sử dụng GPT-4o thay vì GPT-4o-mini?

- API GPT-4o khác với API o1 như thế nào đối với các trường hợp sử dụng cụ thể?

GPT-4o là gì?

GPT-4o, viết tắt của "omni", đại diện cho một bước tiến đáng kể trong AI. Không giống như GPT-4, chỉ xử lý văn bản, GPT-4o là một mô hình đa phương thức xử lý và tạo dữ liệu văn bản, âm thanh và hình ảnh.

Bằng cách kết hợp dữ liệu âm thanh và hình ảnh cùng với văn bản, GPT-4o thoát khỏi những hạn chế của các mô hình chỉ có văn bản truyền thống, tạo ra những tương tác tự nhiên và trực quan hơn.

GPT-4o có thời gian phản hồi nhanh hơn, rẻ hơn 50% so với GPT-4 Turbo, hiểu âm thanh và hình ảnh tốt hơn các mô hình hiện có.

Các trường hợp sử dụng GPT-4o

Ngoài việc tương tác với GPT-4o thông qua giao diện ChatGPT, các nhà phát triển có thể tương tác với GPT-4o thông qua API OpenAI, cho phép họ tích hợp những khả năng của GPT-4o vào các ứng dụng và hệ thống của họ.

API GPT-4o mở ra một loạt các trường hợp sử dụng tiềm năng bằng cách sử dụng những khả năng đa phương thức của nó:

|

Phương thức |

Các trường hợp sử dụng |

Mô tả |

|

Văn bản |

Tạo văn bản, Tóm tắt văn bản, Phân tích dữ liệu và Viết code |

Tạo nội dung, tóm tắt ngắn gọn, giải thích code và hỗ trợ viết code. |

|

Âm thanh |

Phiên âm âm thanh, Biên dịch thời gian thực, Tạo âm thanh |

Chuyển đổi âm thanh thành văn bản, dịch theo thời gian thực, tạo trợ lý ảo hoặc học ngôn ngữ. |

|

Thị giác |

Chú thích hình ảnh, Phân tích hình ảnh & logic, Khả năng tiếp cận cho người khiếm thị |

Mô tả hình ảnh, phân tích thông tin trực quan, cung cấp khả năng truy cập cho người khiếm thị. |

|

Đa phương thức |

Tương tác đa phương thức, Kịch bản nhập vai |

Kết hợp các phương thức một cách liền mạch, tạo ra trải nghiệm nhập vai. |

API GPT-4o: Cách kết nối với API của OpenAI

Bây giờ, hãy khám phá cách sử dụng GPT-4o thông qua API OpenAI.

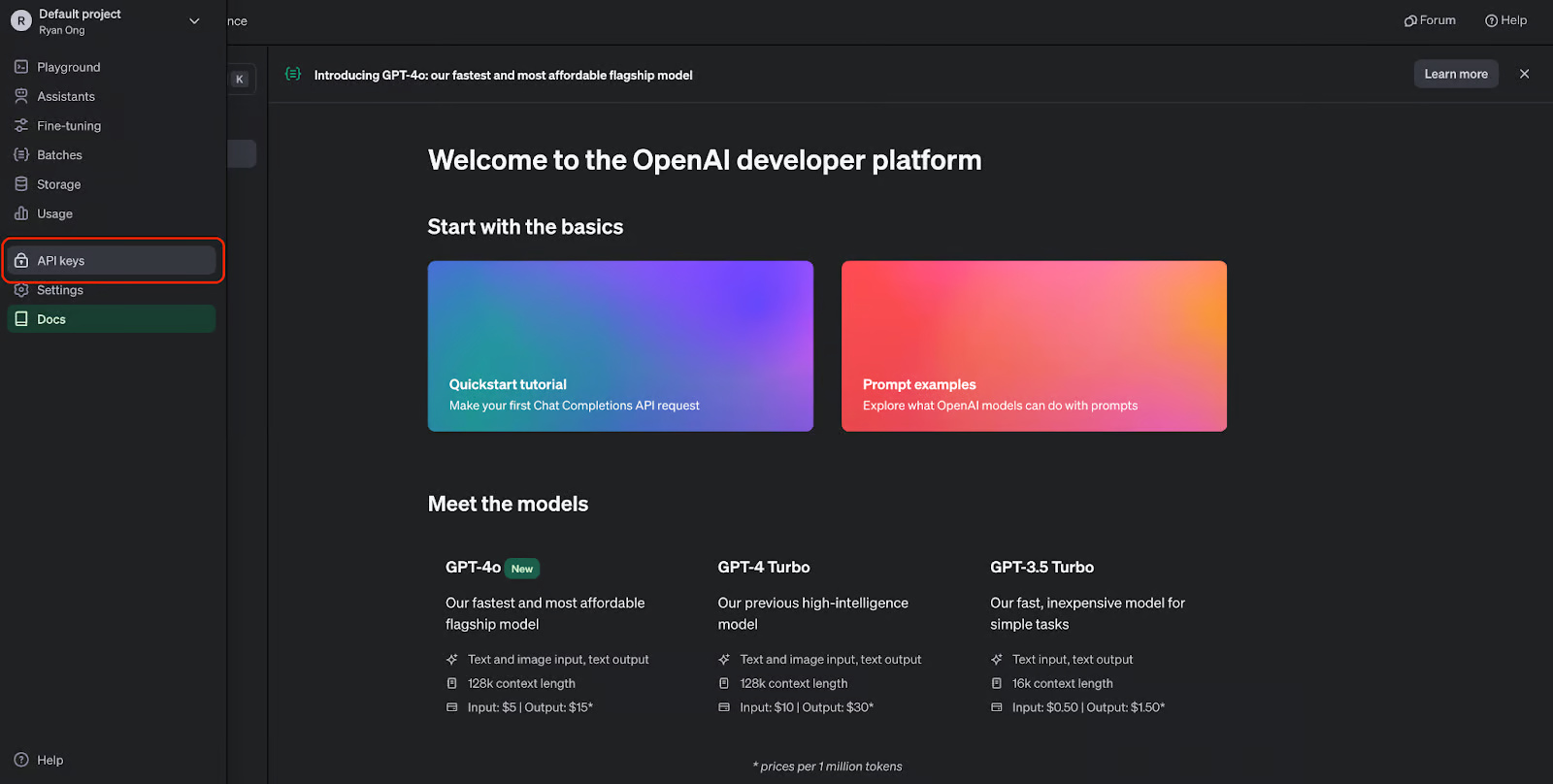

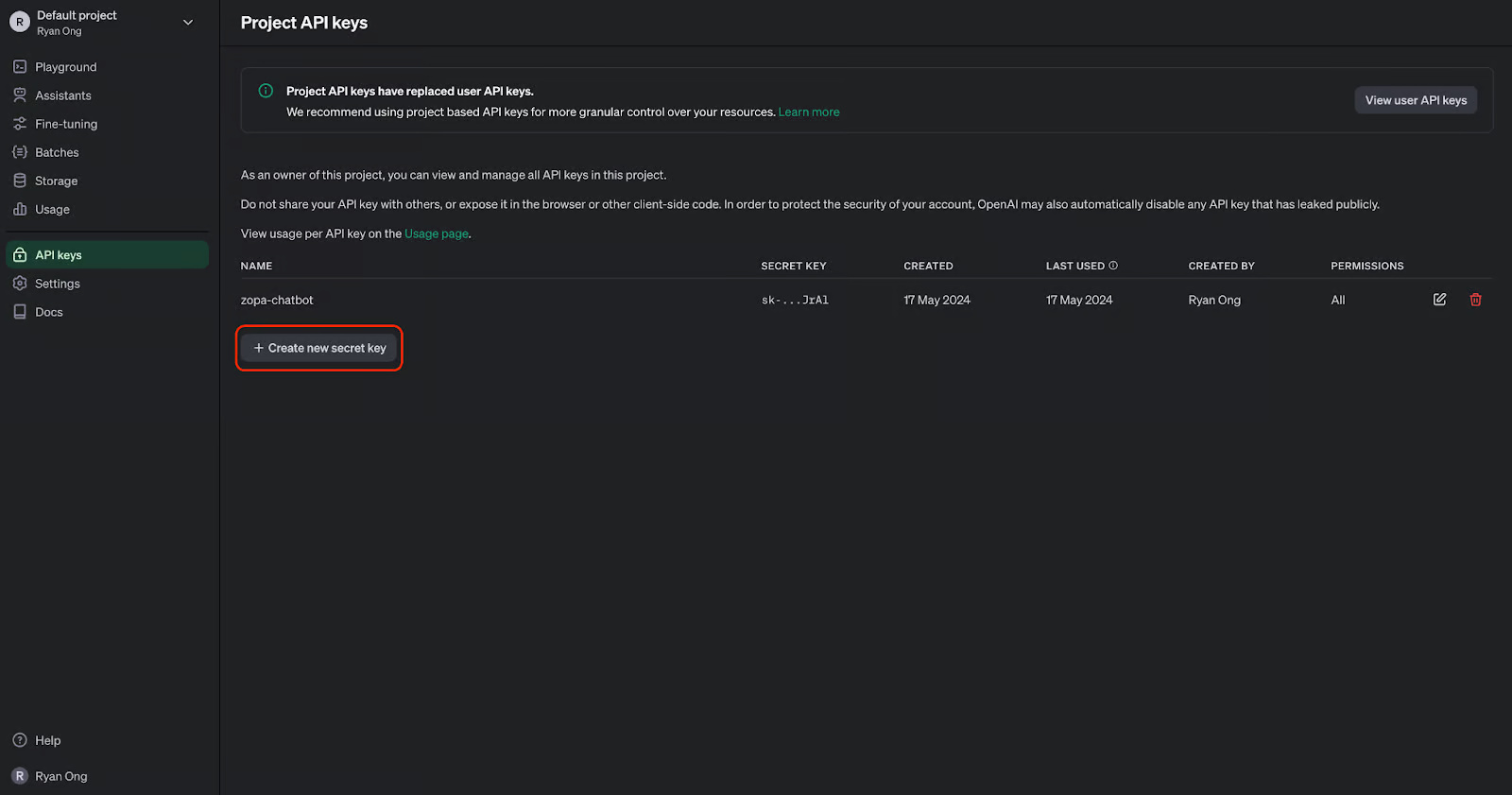

Bước 1: Tạo key API

Trước khi sử dụng API GPT-4o, chúng ta phải đăng ký tài khoản OpenAI và lấy key API. Bạn có thể tạo tài khoản trên trang web API OpenAI.

Sau khi có tài khoản, chúng ta có thể điều hướng đến trang key API:

Bây giờ, chúng ta có thể tạo key API. Chúng ta cần giữ key này an toàn vì sẽ không thể xem lại key này. Nhưng chúng ta luôn có thể tạo key mới nếu bị mất hoặc cần key mới cho một dự án khác.

Bước 2: Nhập API OpenAI vào Python

Để tương tác với API GPT-4o theo chương trình, chúng ta sẽ cần cài đặt thư viện Python OpenAI. Chúng ta có thể thực hiện điều này bằng cách chạy lệnh sau:

Sau khi cài đặt, chúng ta có thể nhập các mô-đun cần thiết vào script Python của mình:

from openai import OpenAIBước 3: Thực hiện lệnh gọi API

Trước khi có thể thực hiện yêu cầu API, chúng ta cần xác thực bằng key API của mình:

## Set the API keyclient = OpenAI(api_key="your_api_key_here")Thay thế "your_api_key_here" bằng key API thực tế của bạn.

Sau khi hoàn tất kết nối client, chúng ta có thể bắt đầu tạo văn bản bằng GPT-4o:

MODEL="gpt-4o"completion = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content": "You are a helpful assistant that helps me with my math homework!"}, {"role": "user", "content": "Hello! Could you solve 20 x 5?"} ])print("Assistant: " + completion.choices[0].message.content)Đoạn code này sử dụng API hoàn thành trò chuyện với mô hình GPT-4o, chấp nhận các câu hỏi liên quan đến toán học làm đầu vào và tạo phản hồi:

API GPT-4o: Các trường hợp sử dụng âm thanh

Phiên âm và tóm tắt âm thanh đã trở thành công cụ thiết yếu trong nhiều ứng dụng, từ cải thiện khả năng truy cập đến nâng cao năng suất. Với API GPT-4o, chúng ta có thể xử lý hiệu quả các tác vụ như phiên âm và tóm tắt nội dung âm thanh.

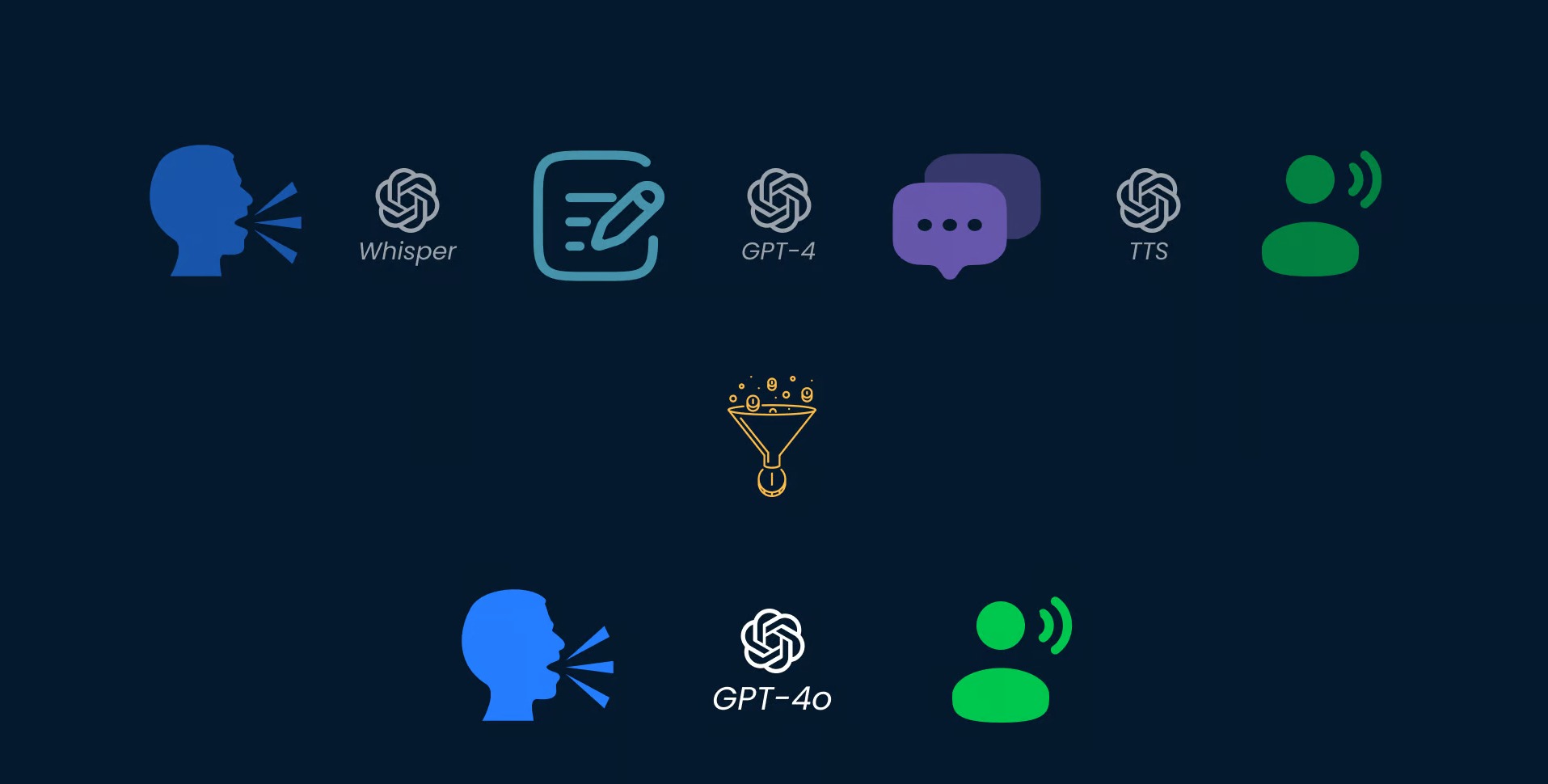

Mặc dù GPT-4o có khả năng xử lý âm thanh trực tiếp, nhưng tính năng nhập âm thanh trực tiếp vẫn chưa khả dụng thông qua API. Hiện tại, chúng ta có thể sử dụng quy trình hai bước với API GPT-4o để phiên âm và sau đó tóm tắt nội dung âm thanh.

Bước 1: Phiên âm âm thanh thành văn bản

Để phiên âm file âm thanh bằng GPT-4o, chúng ta phải cung cấp dữ liệu âm thanh cho API. Sau đây là một ví dụ:

# Transcribe the audioaudio_path = "path/to/audio.mp3"transcription = client.audio.transcriptions.create( model="whisper-1", file=open(audio_path, "rb"),)Thay thế "path/to/audio.mp3" bằng đường dẫn thực tế đến file âm thanh của bạn. Ví dụ này sử dụng mô hình whisper-1 để phiên âm.

Bước 2: Tóm tắt văn bản âm thanh

response = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content":"""You are generating a transcript summary. Create a summary of the provided transcription. Respond in Markdown."""}, {"role": "user", "content": [ {"type": "text", "text": f"The audio transcription is: {transcription.text}"} ], } ], temperature=0,)print(response.choices[0].message.content)GPT-4o API: Các trường hợp sử dụng thị giác

Phân tích dữ liệu trực quan rất quan trọng trong nhiều lĩnh vực, từ chăm sóc sức khỏe đến an ninh, v.v... Với GPT-4o API, bạn có thể phân tích hình ảnh một cách liền mạch, tham gia vào các cuộc trò chuyện về nội dung trực quan và trích xuất thông tin có giá trị từ hình ảnh.

Bước 1: Thêm dữ liệu hình ảnh vào API

Để phân tích hình ảnh bằng GPT-4o, trước tiên chúng ta phải cung cấp dữ liệu hình ảnh cho API. Chúng ta có thể thực hiện điều này bằng cách mã hóa hình ảnh cục bộ dưới dạng chuỗi base64 hoặc cung cấp URL đến hình ảnh trực tuyến:

import base64IMAGE_PATH = "image_path"# Open the image file and encode it as a base64 stringdef encode_image(image_path): with open(image_path, "rb") as image_file: return base64.b64encode(image_file.read()).decode("utf-8")base64_image = encode_image(IMAGE_PATH) "url": "<https://images.saymedia-content.com/.image/c_limit%2Ccs_srgb%2Cq_auto:eco%2Cw_538/MTczOTQ5NDQyMzQ3NTc0NTc5/compound-shapes-how-to-find-the-area-of-a-l-shape.webp>"Bước 2: Phân tích hình ảnh dữ liệu

Sau khi xử lý dữ liệu hình ảnh đầu vào, chúng ta có thể chuyển dữ liệu hình ảnh đến API để phân tích.

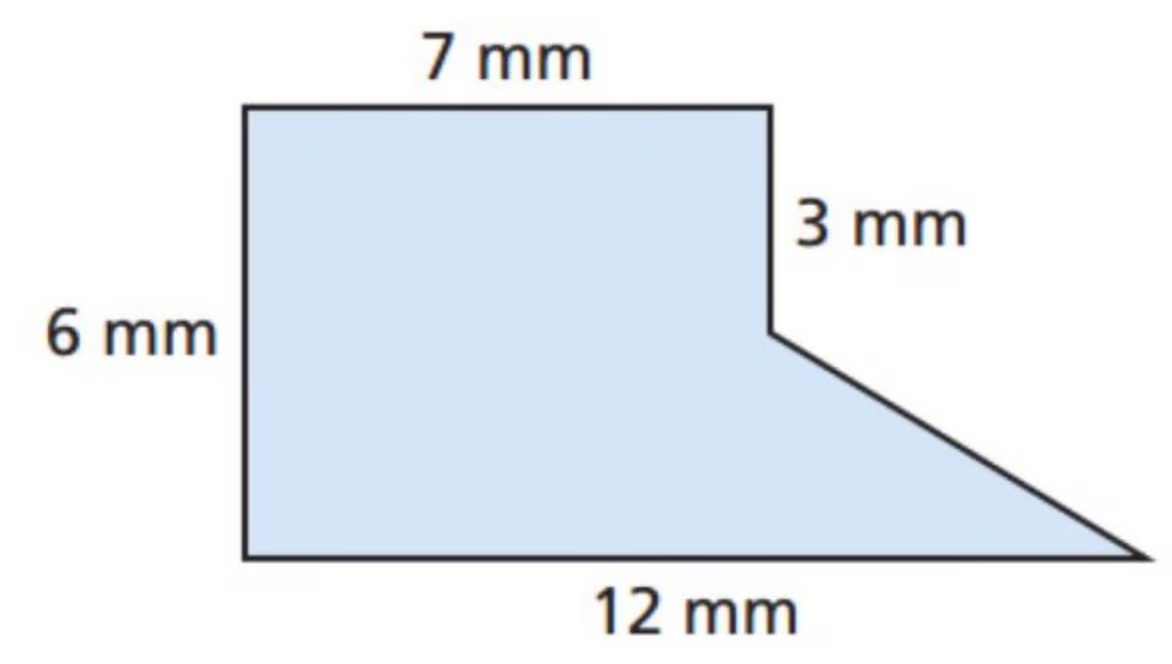

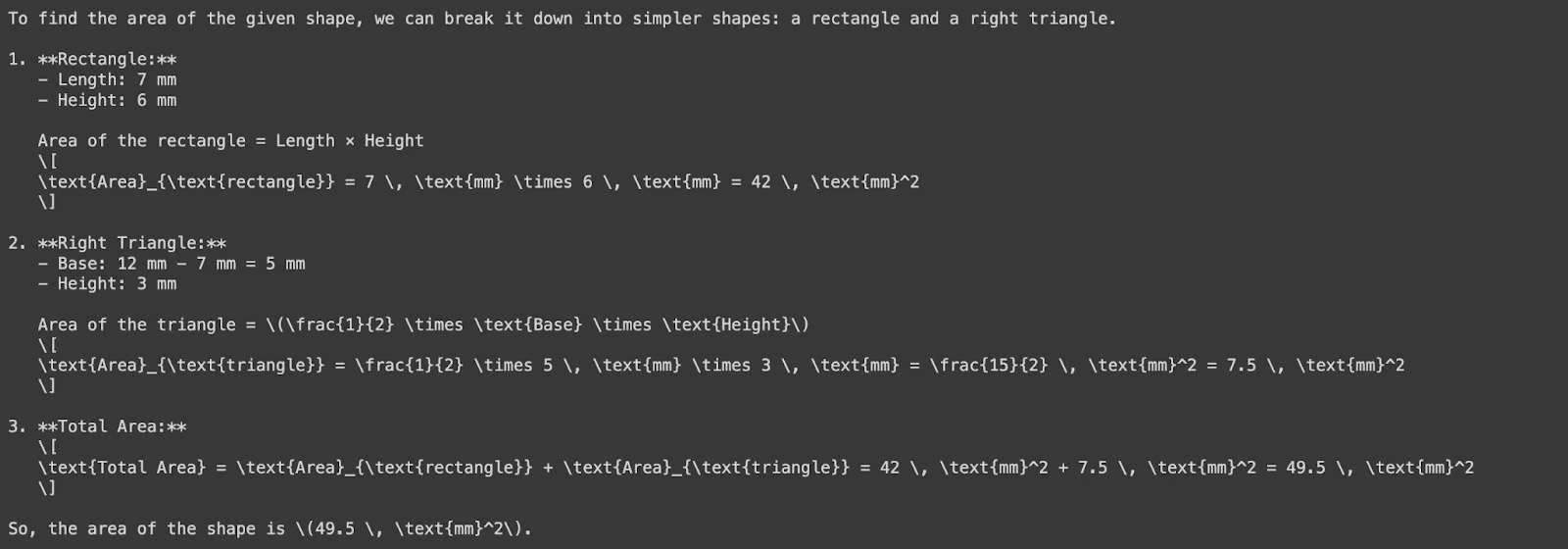

Hãy thử phân tích hình ảnh để xác định diện tích của một hình dạng. Trước tiên, hãy sử dụng hình ảnh bên dưới:

Bây giờ, chúng ta sẽ yêu cầu GPT-4o hỏi diện tích của hình dạng này - lưu ý rằng chúng ta đang sử dụng đầu vào hình ảnh base64 bên dưới:

response = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content": "You are a helpful assistant that responds in Markdown. Help me with my math homework!"}, {"role": "user", "content": [ {"type": "text", "text": "What's the area of the shape in this image?"}, {"type": "image_url", "image_url": { "url": f"data:image/png;base64,{base64_image}"} } ]} ], temperature=0.0,)print(response.choices[0].message.content)

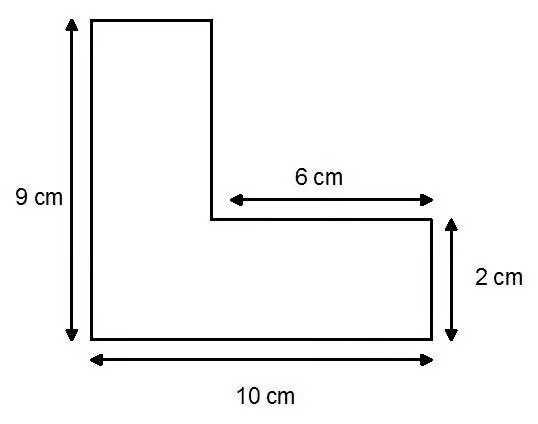

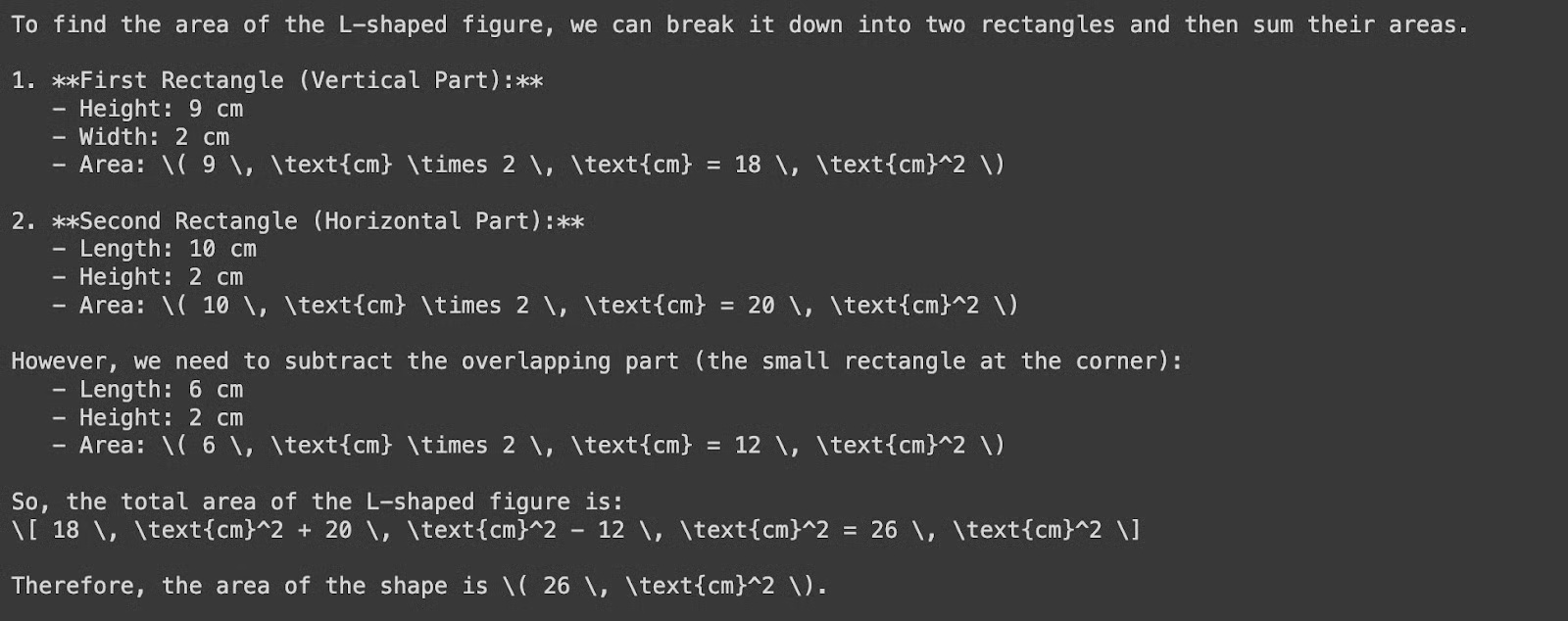

Bây giờ, chúng ta hãy xem xét hình dạng này:

Chúng ta sẽ truyền URL hình ảnh đến GPT-4o để tìm diện tích của hình dạng:

response = client.chat.completions.create( model=MODEL, messages=[ {"role": "system", "content": "You are a helpful assistant that responds in Markdown. Help me with my math homework!"}, {"role": "user", "content": [ {"type": "text", "text": "What's the area of the shape in the image?"}, {"type": "image_url", "image_url": { "url": "<https://images.saymedia-content.com/.image/c_limit%2Ccs_srgb%2Cq_auto:eco%2Cw_538/MTczOTQ5NDQyMzQ3NTc0NTc5/compound-shapes-how-to-find-the-area-of-a-l-shape.webp>"} } ]} ], temperature=0.0,)print(response.choices[0].message.content)

Lưu ý rằng GPT-4o đã đo sai chiều rộng của hình chữ nhật thẳng đứng - chiều rộng phải là 4 cm, không phải 2 cm. Sự khác biệt này phát sinh do sự không thẳng hàng giữa các nhãn đo lường và tỷ lệ thực tế của hình chữ nhật. Nếu có bất kỳ điều gì, điều này một lần nữa làm nổi bật tầm quan trọng của sự giám sát và xác thực của con người.

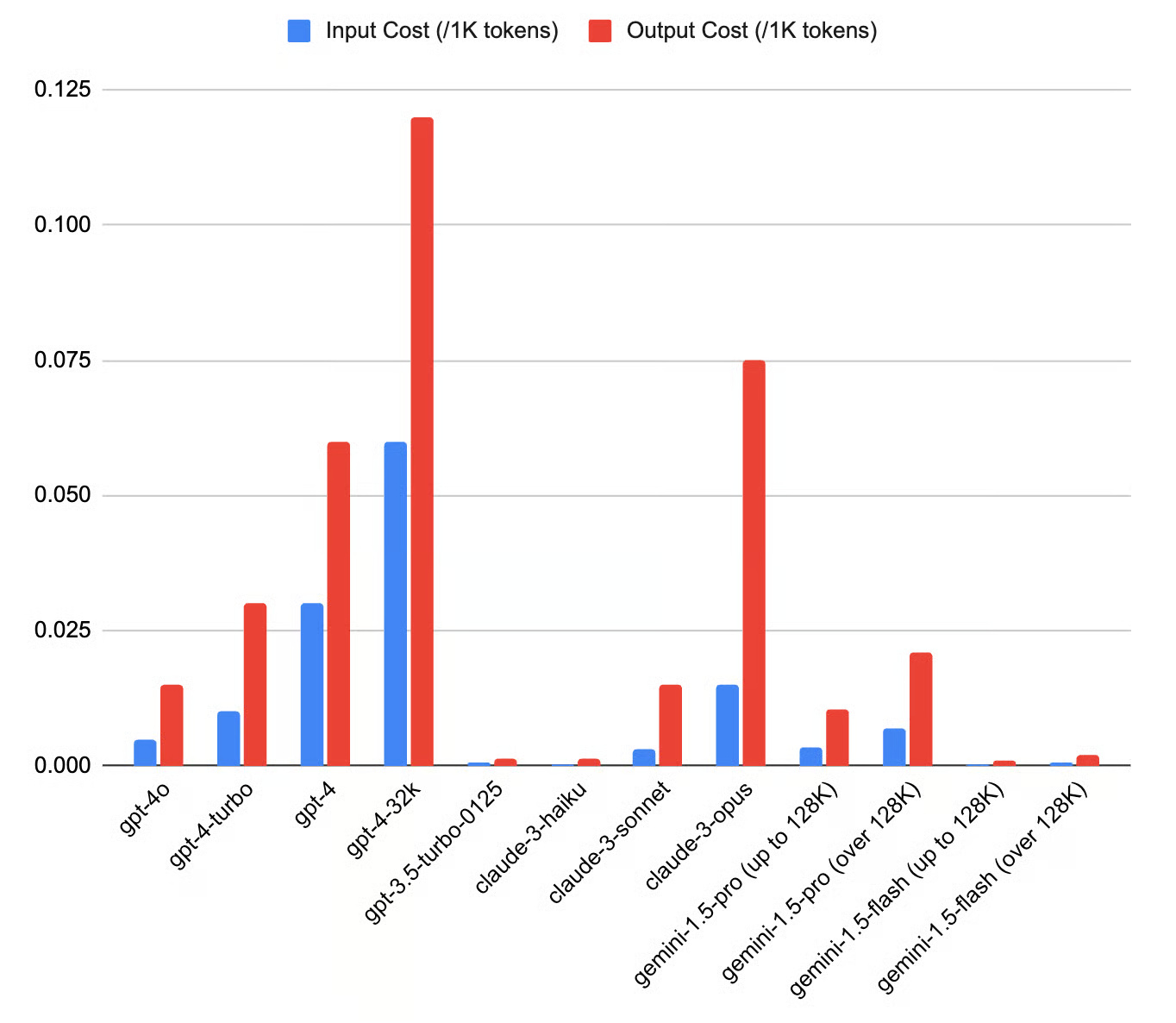

Giá API GPT-4o

OpenAI đã giới thiệu một cấu trúc giá cạnh tranh cho API GPT-4o, giúp API này dễ tiếp cận và tiết kiệm chi phí hơn so với các mô hình trước đây.

Sau đây là tóm tắt về giá cả cùng với các mô hình Claude của Antropic và Gemini của Google (giá được tính bằng USD):

Như bạn có thể thấy, GPT-4o có giá thấp hơn đáng kể so với cả GPT-4 Turbo và GPT-4. Giá của nó cũng cạnh tranh hơn so với các mô hình ngôn ngữ tiên tiến khác như Claude Opus và Gemini 1.5 Pro.

Những cân nhắc chính với API GPT-4o

Khi làm việc với API GPT-4o, điều quan trọng là phải ghi nhớ một số cân nhắc chính để đảm bảo hiệu suất tối ưu, hiệu quả về chi phí và phù hợp với từng trường hợp sử dụng cụ thể. Sau đây là 3 yếu tố quan trọng cần cân nhắc:

Giá cả và quản lý chi phí

API OpenAI tuân theo mô hình trả tiền theo mức sử dụng, trong đó chi phí được tính dựa trên số lượng token được xử lý.

Mặc dù GPT-4o rẻ hơn GPT-4 Turbo, nhưng việc lập kế hoạch sử dụng cho phù hợp là rất quan trọng để ước tính và quản lý chi phí.

Để giảm thiểu chi phí, bạn có thể cân nhắc các kỹ thuật như xử lý hàng loạt và tối ưu hóa prompt để giảm số lượng lệnh gọi API và token được xử lý.

Độ trễ và hiệu suất

Mặc dù GPT-4o cung cấp hiệu suất ấn tượng và độ trễ thấp, nhưng đây vẫn là một mô hình ngôn ngữ lớn, nghĩa là việc xử lý các yêu cầu có thể tốn nhiều tài nguyên tính toán, dẫn đến độ trễ tương đối cao.

Chúng ta cần tối ưu hóa code của mình và sử dụng các kỹ thuật như lưu cache và xử lý không đồng bộ để giảm thiểu những vấn đề về độ trễ.

Ngoài ra, chúng ta có thể khám phá việc sử dụng các phiên bản chuyên dụng của OpenAI hoặc tinh chỉnh mô hình theo trường hợp sử dụng cụ thể của mình, điều này có thể cải thiện hiệu suất và giảm độ trễ.

Tùy chỉnh trường hợp sử dụng

GPT-4o là một mô hình chung mạnh mẽ với nhiều khả năng, nhưng chúng ta cần đảm bảo rằng trường hợp sử dụng cụ thể của mình phù hợp với điểm mạnh của mô hình.

Trước khi chỉ dựa vào GPT-4o, chúng ta phải đánh giá cẩn thận trường hợp sử dụng của mình và xem xét liệu khả năng của mô hình có phù hợp với nhu cầu của mình hay không.

Nếu cần, chúng ta có thể tinh chỉnh các mô hình nhỏ hơn hoặc khám phá các mô hình khác có thể phù hợp hơn với nhiệm vụ cụ thể của mình.

Các khả năng đa phương thức của GPT-4o giải quyết những hạn chế của các mô hình trước đó vốn gặp khó khăn trong việc tích hợp và xử lý nhiều loại dữ liệu khác nhau một cách liền mạch.

Bằng cách tận dụng API GPT-4o, các nhà phát triển có thể xây dựng những giải pháp sáng tạo tích hợp liền mạch dữ liệu văn bản, âm thanh và hình ảnh.

Nếu muốn thực hành nhiều hơn với GPT-4o, bạn nên tham khảo code này để tạo trợ lý AI bằng GPT-4o. Tương tự, nếu muốn tìm hiểu thêm về cách làm việc với API, bạn nên tham khảo các tài nguyên sau:

Câu hỏi thường gặp

GPT-4o là gì và nó khác với các mô hình trước như thế nào?

GPT-4o là mô hình ngôn ngữ đa phương thức do OpenAI phát triển, có khả năng xử lý và tạo dữ liệu văn bản, âm thanh và hình ảnh. Không giống như các mô hình trước như GPT-4, chỉ xử lý văn bản, GPT-4o tích hợp thông tin âm thanh và hình ảnh, cho phép tương tác tự nhiên hơn và khả năng nâng cao trên nhiều phương thức.

Các nhà phát triển có thể truy cập GPT-4o thông qua API OpenAI như thế nào?

Các nhà phát triển có thể truy cập GPT-4o thông qua API OpenAI bằng cách đăng ký tài khoản OpenAI, lấy key API và cài đặt thư viện Python OpenAI.

Chi phí sử dụng API GPT-4o là bao nhiêu và nó khác với các mô hình khác như thế nào?

API GPT-4o tuân theo mô hình trả tiền theo mức sử dụng, với chi phí phát sinh dựa trên số lượng token được xử lý. So với các mô hình trước như GPT-4, GPT-4o giảm 50% chi phí, giúp giá cả phải chăng hơn.

GPT-4o có thể được tinh chỉnh cho các trường hợp sử dụng hoặc ngành cụ thể không?

Có, GPT-4o có thể được tinh chỉnh cho các trường hợp sử dụng hoặc ngành cụ thể thông qua những kỹ thuật như học chuyển giao. Bằng cách tinh chỉnh dữ liệu hoặc tác vụ cụ thể theo miền, các nhà phát triển có thể nâng cao hiệu suất của mô hình và điều chỉnh theo yêu cầu riêng của họ.

Có những tài nguyên nào để tìm hiểu thêm và triển khai API GPT-4o?

Có nhiều tài nguyên khác nhau, bao gồm hướng dẫn, khóa học và ví dụ thực tế, để tìm hiểu thêm và triển khai API GPT-4o. Bài viết này khuyến nghị bạn nên khám phá khóa học Working with the OpenAI API của DataCamp, OpenAI Cookbook và cheat sheet của DataCamp để tham khảo nhanh và hướng dẫn triển khai thực tế.

Khi nào nên sử dụng GPT-4o thay vì GPT-4o-mini?

GPT-4o lý tưởng cho các trường hợp sử dụng phức tạp hơn đòi hỏi phân tích chuyên sâu, hiểu ngôn ngữ hoặc tương tác lâu hơn. Mặt khác, GPT-4o-mini nhanh chóng và tiết kiệm chi phí hơn, phù hợp hơn với các tác vụ nhẹ hoặc khi cần phản hồi nhanh. Cả hai mô hình đều cung cấp khả năng đa phương thức, nhưng GPT-4o vượt trội hơn khi cần có lý luận nâng cao hơn và tương tác giữa các phương thức.

API GPT-4o khác với API o1 như thế nào đối với các trường hợp sử dụng cụ thể?

Trong khi GPT-4o tuyệt vời cho các tác vụ liên quan đến dữ liệu đa phương thức (văn bản, âm thanh và hình ảnh), API o1 lại tỏa sáng trong những tác vụ lý luận phức tạp và giải quyết vấn đề, đặc biệt là đối với khoa học, viết code và toán học. Nếu bạn cần phản hồi nhanh với lý luận vừa phải, GPT-4o là lựa chọn tốt nhất của bạn. Tuy nhiên, đối với các tác vụ đòi hỏi phân tích logic chuyên sâu và độ chính xác, như tạo code phức tạp hoặc giải những bài toán nâng cao, API o1 cung cấp các khả năng mạnh mẽ hơn.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học