Các tập đoàn công nghệ lớn như Meta, Google và X đang đầu tư mạnh vào các công cụ AI nhằm phát hiện tin giả trên internet. Nghe có vẻ đáng yên tâm, nhưng theo một nghiên cứu mới từ Université de Montréal, những hệ thống này vẫn tồn tại nhiều hạn chế ẩn sau các con số độ chính xác tưởng chừng rất ấn tượng.

Nghiên cứu sinh tiến sĩ Dorsaf Sallami đã phân tích nhiều hệ thống AI phát hiện tin giả và nhận ra rằng chúng thực chất không kiểm chứng sự thật của thông tin. Thay vào đó, các hệ thống này chỉ tính toán xác suất dựa trên dữ liệu huấn luyện mà chúng được cung cấp.

Nói cách khác, cách hoạt động của chúng không giống một nhà báo đi xác minh thông tin, mà giống như một chiếc gương phản chiếu lại dữ liệu mà nó đã được đào tạo. Điều này đồng nghĩa với việc hệ thống có thể tái tạo lại những thiên kiến và điểm mù vốn tồn tại trong dữ liệu huấn luyện.

Theo Sallami, một hệ thống đạt 95% độ chính xác trong môi trường phòng thí nghiệm vẫn có thể thất bại khi áp dụng trong thực tế, và khoảng cách giữa hai môi trường này là một vấn đề đáng lo ngại.

Vấn đề thiên kiến ít được nhắc tới

Ngoài câu chuyện về độ chính xác, nghiên cứu cũng phát hiện rằng nhiều hệ thống phát hiện tin giả bằng AI mang theo các thiên kiến tiềm ẩn mà người dùng gần như không nhận ra.

Một số mô hình có xu hướng gắn nhãn phụ nữ là nguồn lan truyền thông tin sai lệch nhiều hơn. Một số hệ thống khác lại thiên vị khi đánh giá các nguồn tin không đến từ phương Tây, hoặc vô tình tái tạo các định kiến chính trị có sẵn trong dữ liệu huấn luyện.

Bên cạnh đó còn tồn tại một vấn đề sâu hơn liên quan đến cách những hệ thống này được huấn luyện. Phần lớn dữ liệu nhãn được lấy từ các tổ chức kiểm chứng thông tin, nhưng nhiều tổ chức trong số đó thiếu minh bạch, thậm chí có những tổ chức hoạt động theo mô hình doanh nghiệp vì lợi nhuận.

Điều này khiến nền tảng dữ liệu mà các hệ thống AI dựa vào không thực sự vững chắc.

Thêm vào đó, sự xuất hiện của các công cụ tạo nội dung như ChatGPT khiến việc tạo ra nội dung giả trở nên dễ dàng hơn bao giờ hết. Vì vậy, các hệ thống phát hiện tin giả được huấn luyện chỉ vài tháng trước có thể nhanh chóng trở nên lỗi thời.

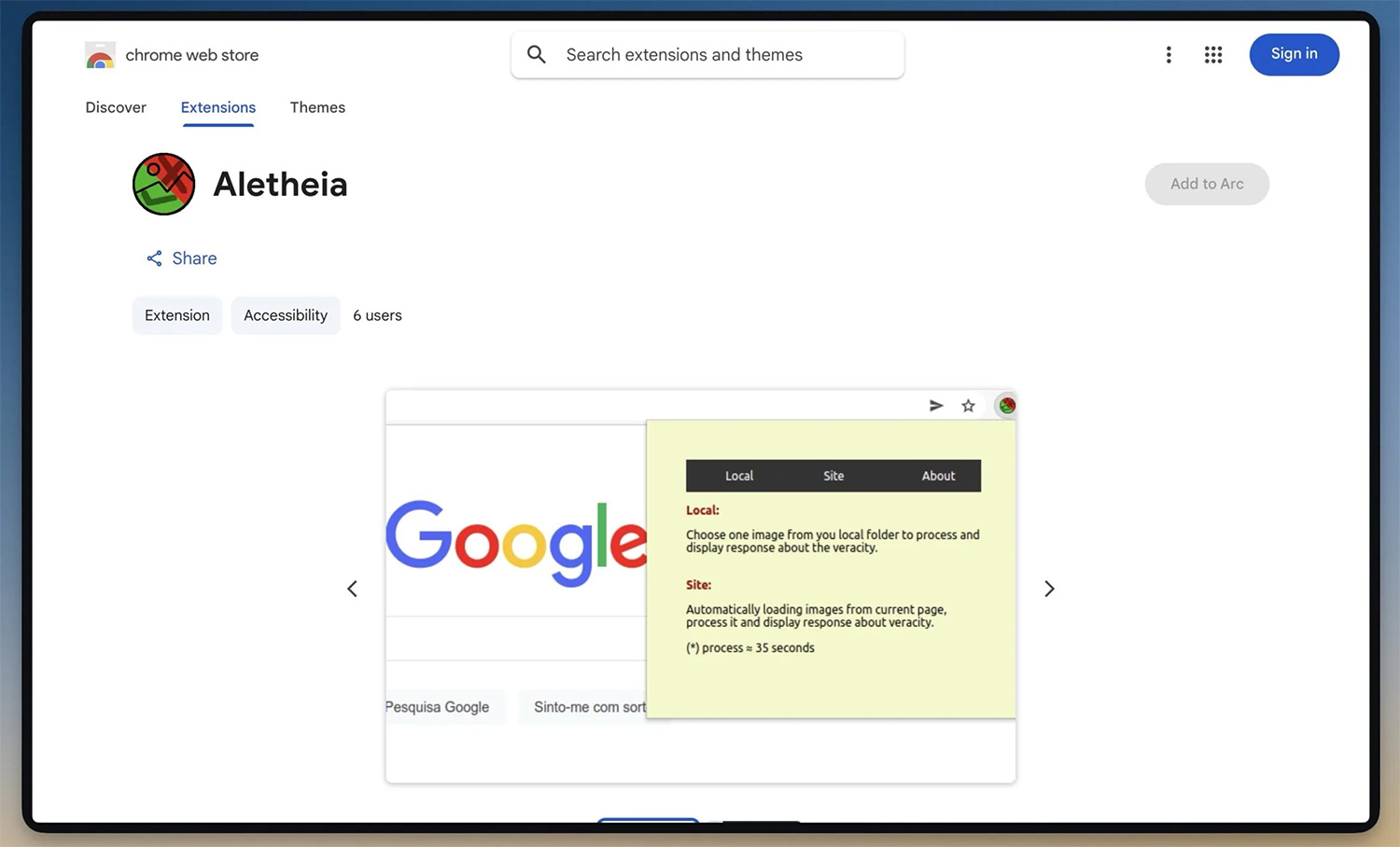

Để giải quyết vấn đề này, Sallami đề xuất một công cụ mới có tên Aletheia. Đây là một tiện ích trình duyệt giúp giải thích vì sao một nội dung có thể đáng nghi, thay vì chỉ đơn giản đưa ra kết luận đúng hay sai.

Trong các thử nghiệm, Aletheia đạt mức độ tin cậy khoảng 85%, vượt qua nhiều công cụ phát hiện tin giả hiện có. Điểm khác biệt lớn nhất của công cụ này nằm ở triết lý thiết kế.

Thay vì đưa ra một “phán quyết” và yêu cầu người dùng phải tin tưởng, Aletheia trình bày toàn bộ quá trình phân tích của mình. Công cụ này thu thập bằng chứng từ các nguồn trực tuyến, trình bày chúng bằng ngôn ngữ dễ hiểu và để người dùng tự đưa ra quyết định cuối cùng.

Ngoài ra, Aletheia còn cung cấp một bảng tin cập nhật các hoạt động kiểm chứng thông tin gần đây, cùng với diễn đàn cộng đồng để người dùng chia sẻ và thảo luận về các phát hiện của mình.

Thông điệp mà nghiên cứu này đưa ra khá rõ ràng: AI nên hỗ trợ khả năng phán đoán của con người, chứ không nên thay thế hoàn toàn nó.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học