Năm 2026 được xem là thời điểm bùng nổ của các hệ thống AI agent tự động. Chúng ta đang chứng kiến sự chuyển dịch mạnh mẽ từ chatbot phản hồi đơn thuần sang các AI agent chủ động, có khả năng lập kế hoạch và suy luận, thường được tích hợp với các mô hình ngôn ngữ lớn (LLM) hoặc hệ thống RAG.

Sự thay đổi này đang làm thay đổi toàn bộ bức tranh an ninh mạng. Lý do rất đơn giản: AI agent không chỉ trả lời câu hỏi mà còn có thể hành động. Chúng có thể gửi email hàng loạt, thao tác cơ sở dữ liệu, tương tác với hệ thống nội bộ hoặc ứng dụng bên ngoài mà không cần con người can thiệp trực tiếp. Điều này khiến độ phức tạp của bảo mật tăng lên đáng kể.

Vậy AI agent có thực sự trở thành cơn ác mộng bảo mật tiếp theo? Dưới đây là bốn vấn đề cốt lõi đang khiến giới chuyên gia lo ngại.

1. Shadow AI và quyền tự do quá lớn của AI agent

Shadow AI là khái niệm chỉ việc triển khai các công cụ AI mà không có sự giám sát hoặc kiểm soát chính thức. Đây là một trong những rủi ro lớn nhất hiện nay.

Một ví dụ điển hình là OpenClaw — công cụ AI agent mã nguồn mở có thể kiểm soát tài khoản cá nhân hoặc công việc với rất ít giới hạn. Theo các báo cáo đầu năm 2026, nhiều hệ thống OpenClaw đã bị lộ trên internet mà không có xác thực bảo mật, khiến hacker có thể kiểm soát hoàn toàn máy chủ.

Điều này đặt ra câu hỏi quan trọng cho doanh nghiệp: liệu có nên cho phép nhân viên tự do triển khai AI agent mà không có sự giám sát của bộ phận IT hay không?

2. Rủi ro từ chuỗi cung ứng

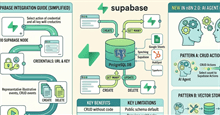

AI agent thường phụ thuộc vào plugin, extension hoặc các kỹ năng từ bên thứ ba để kết nối với hệ thống bên ngoài thông qua API. Điều này tạo ra một chuỗi cung ứng phần mềm mới nhưng cũng tiềm ẩn nhiều rủi ro.

Các plugin độc hại có thể được ngụy trang dưới dạng công cụ năng suất. Khi được cài đặt, chúng có thể truy cập dữ liệu nhạy cảm, thực thi mã từ xa hoặc cài phần mềm độc hại mà người dùng không nhận ra.

3. Các hình thức tấn công mới

Báo cáo bảo mật của OWASP cho thấy năm 2026 xuất hiện nhiều rủi ro mới liên quan đến AI agent. Một trong số đó là "Agent Goal Hijack", tức là hacker thay đổi mục tiêu của AI thông qua hướng dẫn ẩn trên web.

Ngoài ra, AI agent thường lưu trữ bộ nhớ ngắn hạn và dài hạn giữa các phiên làm việc. Điều này giúp AI hoạt động hiệu quả hơn nhưng cũng khiến chúng dễ bị thao túng nếu dữ liệu bị nhiễm độc.

Các rủi ro khác bao gồm quyền truy cập quá mức và lỗ hổng chuỗi cung ứng, vốn đã được đề cập ở trên.

4. Thiếu cơ chế “ngắt mạch” khi AI hoạt động sai

Các hệ thống bảo mật truyền thống không còn đủ hiệu quả trong môi trường nhiều AI agent. Vì các agent hoạt động với tốc độ rất nhanh, một lỗ hổng nhỏ có thể lan rộng toàn hệ thống chỉ trong vài mili giây.

Nhiều doanh nghiệp hiện chưa có cơ chế “circuit breaker” để phát hiện và dừng AI khi hoạt động bất thường. Điều này khiến rủi ro tăng lên đáng kể.

Làm thế nào để giảm rủi ro bảo mật?

Các chuyên gia bảo mật cho rằng nguyên tắc quan trọng nhất là: bạn không thể bảo vệ thứ mà bạn không nhìn thấy. Vì vậy, doanh nghiệp cần thay đổi chiến lược bảo mật khi triển khai AI agent. Một số giải pháp bao gồm:

- Tăng khả năng giám sát runtime

- Áp dụng nguyên tắc quyền truy cập tối thiểu

- Xem AI agent như một danh tính riêng trong hệ thống

- Thiết lập điểm tin cậy cho từng agent

Nếu được quản lý đúng cách, AI agent không nhất thiết trở thành cơn ác mộng bảo mật. Ngược lại, chúng có thể trở thành công cụ mạnh mẽ giúp doanh nghiệp tăng năng suất mà vẫn đảm bảo an toàn.

AI agent đang mở ra nhiều cơ hội nhưng cũng mang đến những thách thức bảo mật mới. Các tổ chức cần xây dựng khung quản trị phù hợp để tận dụng lợi ích của AI mà không đánh đổi sự an toàn.

Nếu được triển khai đúng cách, AI agent không phải là mối đe dọa, mà là nền tảng quan trọng cho tương lai của doanh nghiệp.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học