OpenAI đã giới thiệu model GPT-4o hàng đầu của mình tại sự kiện Spring Update và cung cấp miễn phí cho mọi người. Chỉ sau một ngày, tại sự kiện Google I/O 2024, Google đã ra mắt model Gemini 1.5 Pro dành cho người tiêu dùng thông qua Gemini Advanced. Hiện tại, hai model hàng đầu đã có sẵn cho người tiêu dùng, hãy so sánh ChatGPT 4o và Gemini 1.5 Pro xem model nào hoạt động tốt hơn.

Ghi chú: Để đảm bảo tính nhất quán, tất cả các thử nghiệm đã được thử nghiệm trên Google AI Studio và Gemini Advanced. Cả hai đều host model Gemini 1.5 Pro mới nhất.

1. Tính thời gian sấy

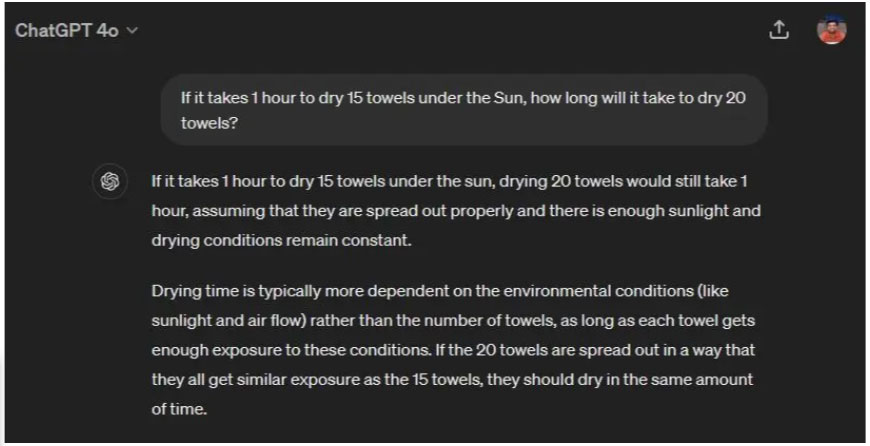

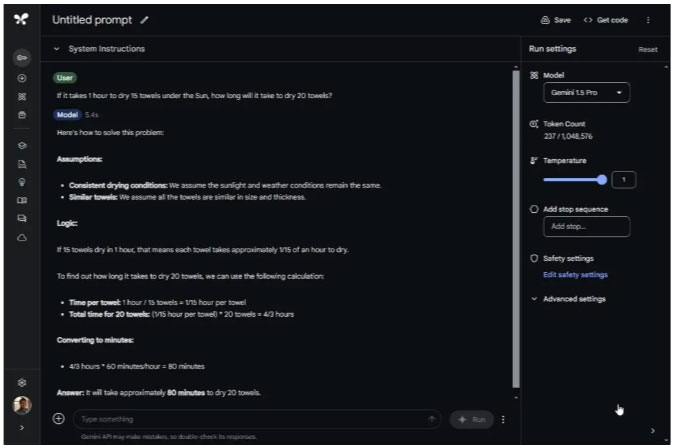

Tác giả đã chạy bài kiểm tra lý luận cổ điển trên ChatGPT 4o và Gemini 1.5 Pro để kiểm tra trí thông minh của chúng. ChatGPT 4o của OpenAI đã đạt được thành tích đó trong khi model Gemini 1.5 Pro cải tiến gặp khó khăn trong việc hiểu câu hỏi mẹo. Nó lao vào tính toán toán học và đưa ra một kết luận sai lầm.

If it takes 1 hour to dry 15 towels under the Sun, how long will it take to dry 20 towels?

Tạm dịch: Nếu phơi 15 chiếc khăn dưới ánh mặt trời trong 1 giờ thì phơi 20 chiếc khăn mất bao lâu?

Tùy chọn chiến thắng: ChatGPT 4o

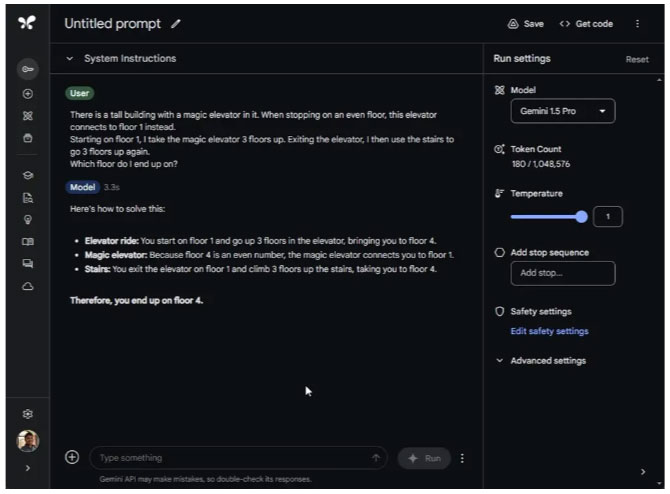

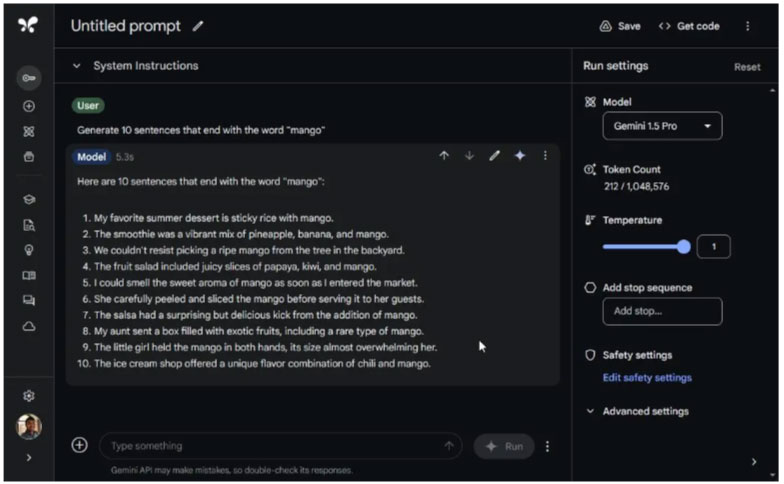

2. Bài kiểm tra thang máy ma thuật

Trong bài kiểm tra thang máy ma thuật, model ChatGPT 4 trước đó đã đoán sai câu trả lời. Tuy nhiên, lần này, mô hình ChatGPT 4o đã trả lời đúng. Gemini 1.5 Pro cũng đưa ra câu trả lời chính xác.

There is a tall building with a magic elevator in it. When stopping on an even floor, this elevator connects to floor 1 instead.

Starting on floor 1, I take the magic elevator 3 floors up. Exiting the elevator, I then use the stairs to go 3 floors up again.

Which floor do I end up on?

Tạm dịch: Có một tòa nhà cao tầng với thang máy thần kỳ bên trong. Khi dừng ở tầng chẵn, thang máy này sẽ kết nối với tầng 1.

Bắt đầu từ tầng 1, tôi đi thang máy thần kỳ lên 3 tầng. Ra khỏi thang máy, tôi dùng cầu thang bộ để đi lên 3 tầng nữa.

Cuối cùng tôi sẽ ở tầng nào?

Tùy chọn chiến thắng: ChatGPT 4o và Gemini 1.5 Pro

3. Xác định vị trí của quả táo

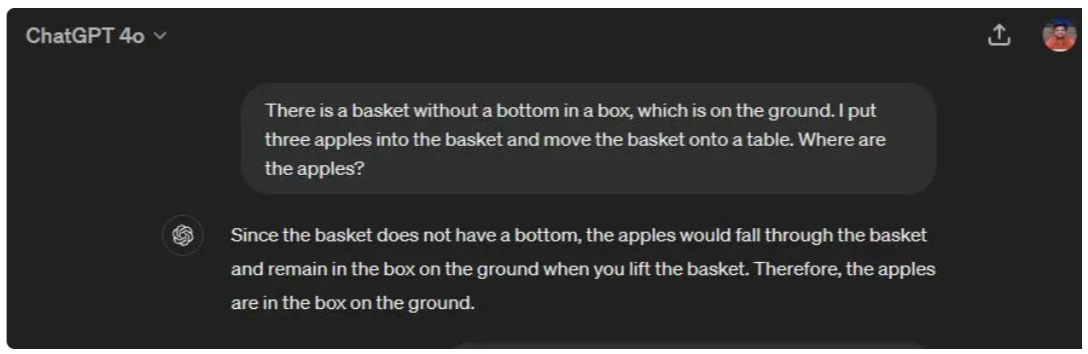

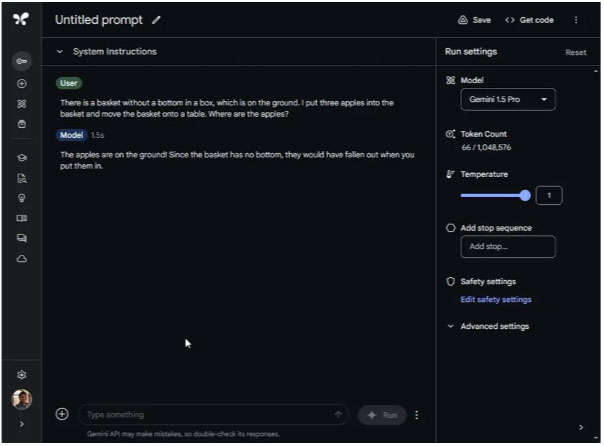

Trong bài kiểm tra này, Gemini 1.5 Pro hoàn toàn không hiểu được sắc thái của câu hỏi. Có vẻ như hình model Gemini không chú ý và bỏ qua nhiều khía cạnh quan trọng của câu hỏi. Mặt khác, ChatGPT 4o lại nói chính xác rằng táo nằm trong hộp trên mặt đất.

There is a basket without a bottom in a box, which is on the ground. I put three apples into the basket and move the basket onto a table. Where are the apples?

Tạm dịch: Trong một chiếc hộp có một cái giỏ không đáy, nằm trên mặt đất. Tôi bỏ ba quả táo vào giỏ và đặt giỏ lên bàn. Vậy những trái táo đang nằm ở đâu?

Tùy chọn chiến thắng: ChatGPT 4o

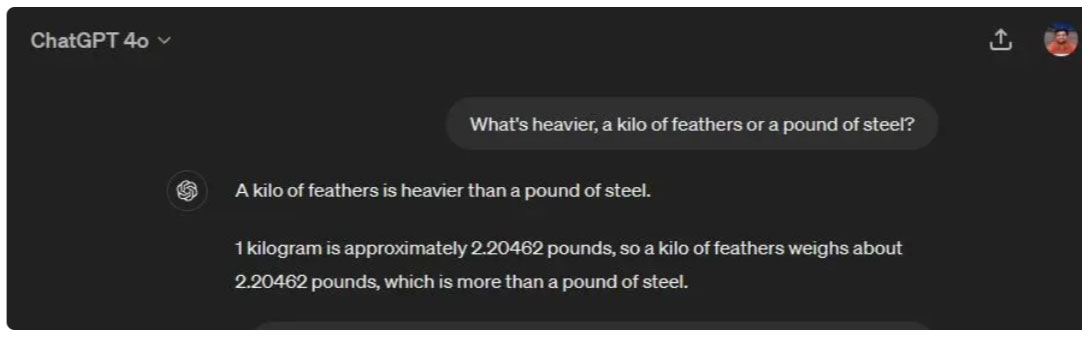

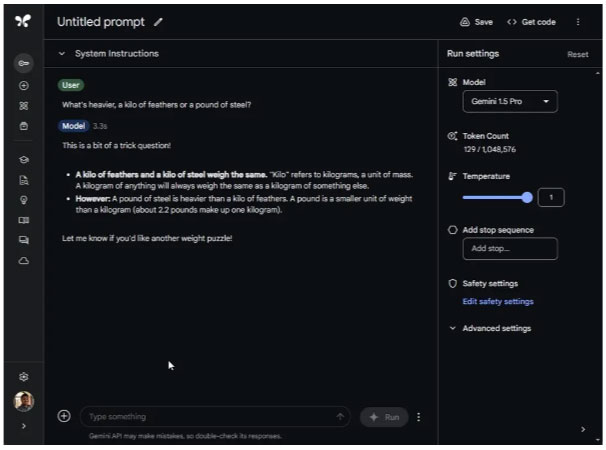

4. Cái nào nặng hơn?

Trong bài kiểm tra lý luận thông thường này, Gemini 1.5 Pro trả lời sai và cho biết cả hai đều có trọng lượng như nhau. Nhưng ChatGPT 4o đã chỉ ra một cách đúng đắn rằng các đơn vị là khác nhau, do đó, một kg vật liệu bất kỳ sẽ nặng hơn một pound. Có vẻ như model Gemini 1.5 Pro cải tiến đã trở nên kém hơn theo thời gian.

What's heavier, a kilo of feathers or a pound of steel?

Tạm dịch: Cái nào nặng hơn, một cân lông vũ hay một pound thép?

Tùy chọn chiến thắng: ChatGPT 4o

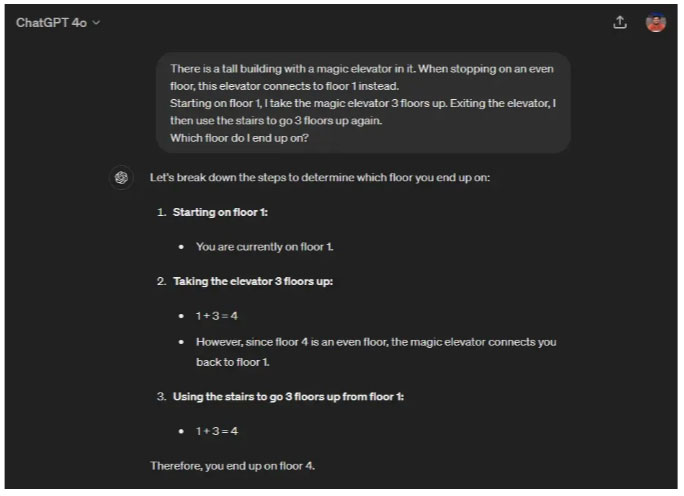

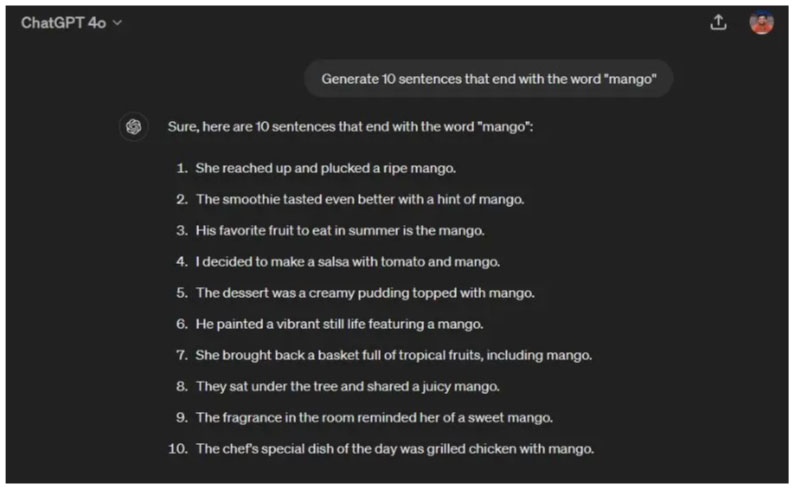

5. Làm theo hướng dẫn sử dụng

Tác giả bài viết đã yêu cầu ChatGPT 4o và Gemini 1.5 Pro tạo ra 10 câu kết thúc bằng từ “mango”. Đoán xem cái gì? ChatGPT 4o tạo chính xác cả 10 câu, nhưng Gemini 1.5 Pro chỉ có thể tạo 6 câu như vậy.

Trước GPT-4o, chỉ Llama 3 70B mới có thể thực hiện đúng hướng dẫn của người dùng. Model GPT-4 cũ cũng gặp khó khăn trước đó. Điều đó có nghĩa là OpenAI thực sự đã cải tiến mô hình của mình.

Generate 10 sentences that end with the word "mango"

Tạm dịch: Đặt 10 câu kết thúc bằng từ "mango"

Tùy chọn chiến thắng: ChatGPT 4o

6. Kiểm tra hình ảnh đa phương thức

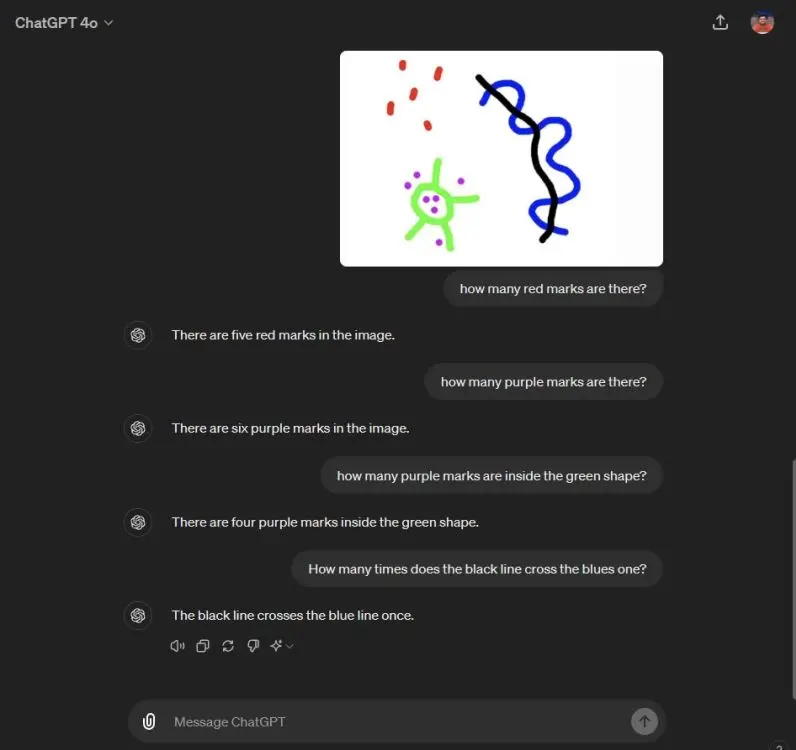

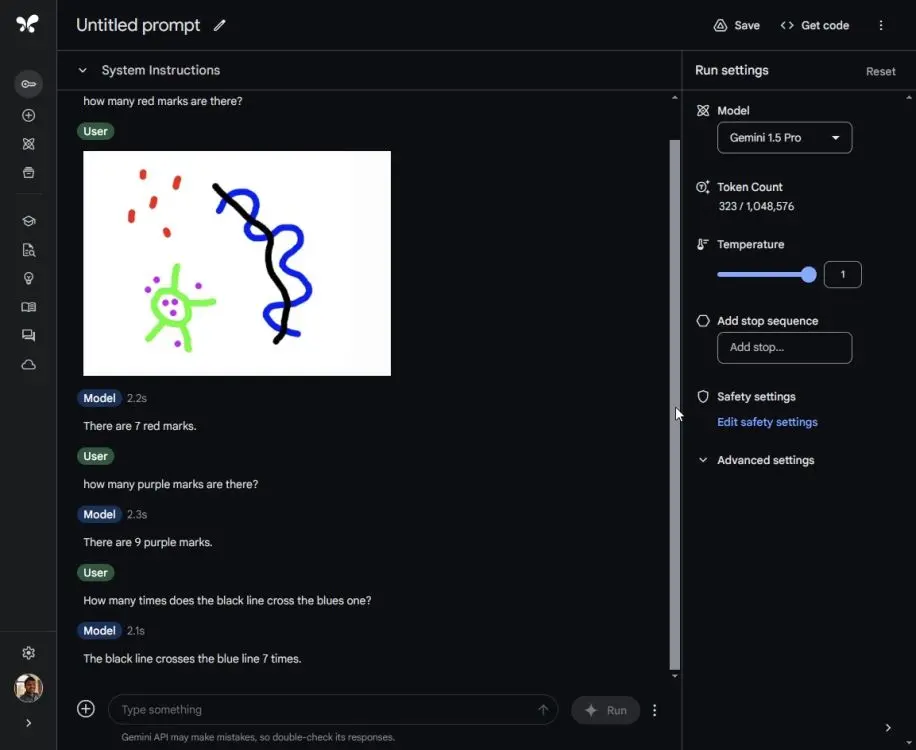

François Fleuret, tác giả cuốn The Little Book of Deep Learning, đã thực hiện bài kiểm tra phân tích hình ảnh đơn giản trên ChatGPT 4o và chia sẻ kết quả trên X (trước đây là Twitter). Hiện tác giả này đã xóa dòng tweet này để tránh thổi phồng vấn đề.

Tác giả bài viết đã thực hiện thử nghiệm tương tự trên Gemini 1.5 Pro và ChatGPT 4o để tái tạo kết quả. Gemini 1.5 Pro hoạt động kém hơn nhiều và đưa ra câu trả lời sai cho tất cả các câu hỏi. Mặt khác, ChatGPT 4o đưa ra một câu trả lời đúng nhưng lại thất bại ở các câu hỏi khác.

Điều đó tiếp tục cho thấy rằng có nhiều lĩnh vực mà các mô hình đa phương thức cần được cải tiến. Khả năng đa phương thức của Gemini đặc biệt đáng thất vọng vì nó có vẻ khác xa với những câu trả lời chính xác.

Tùy chọn chiến thắng: Không có

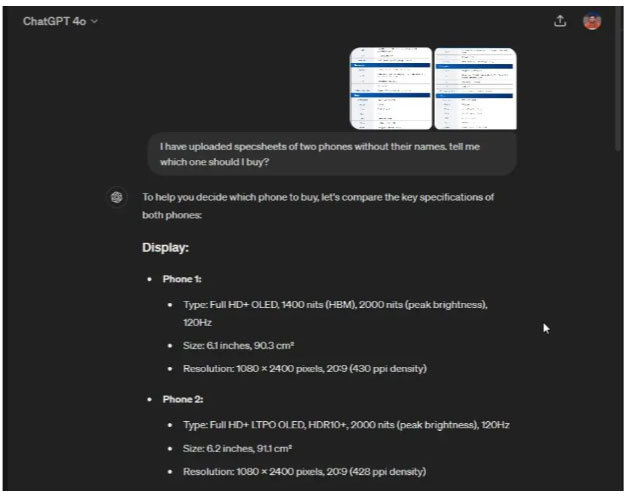

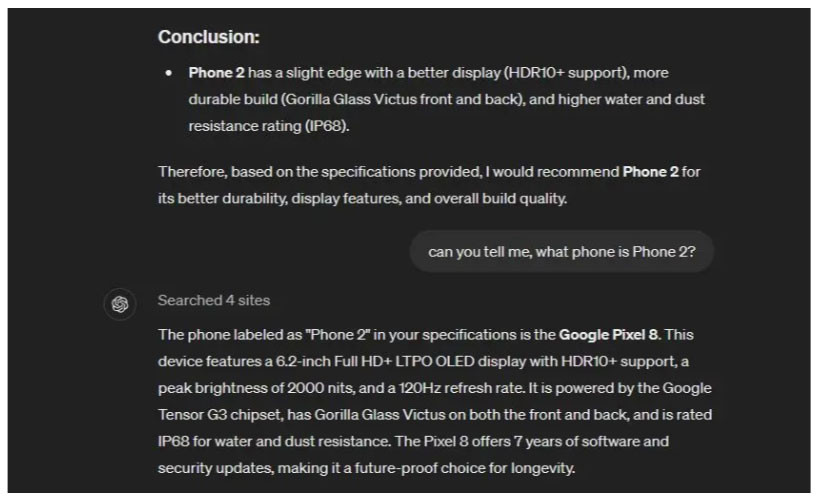

7. Kiểm tra nhận dạng ký tự

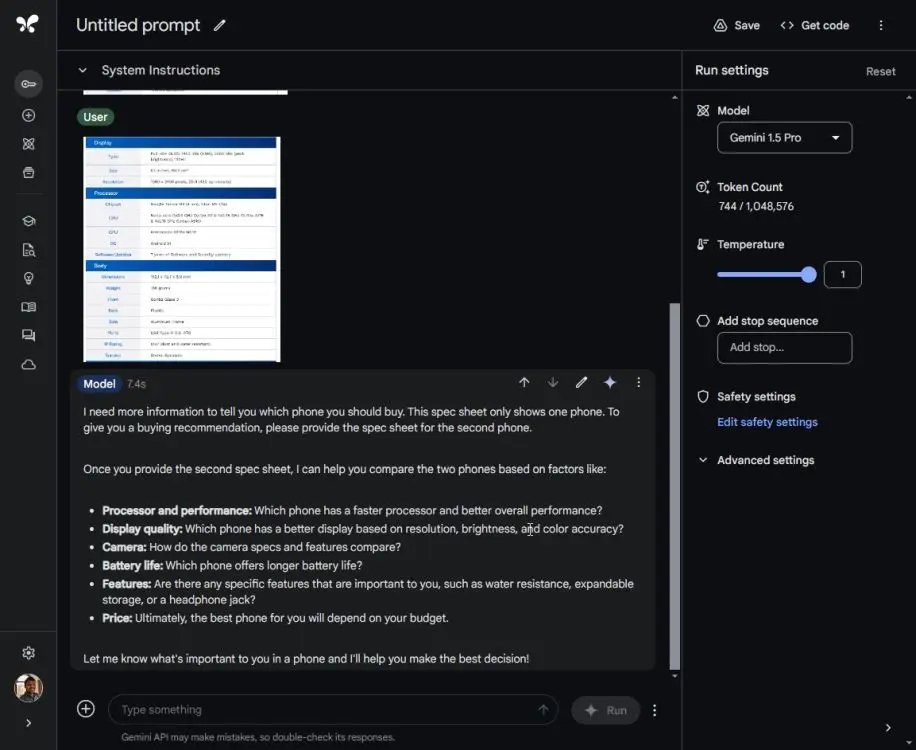

Trong một thử nghiệm đa phương thức khác, tác giả bài viết đã load thông số kỹ thuật của hai điện thoại (Pixel 8a và Pixel 8) lên ở định dạng hình ảnh, không tiết lộ tên điện thoại và ảnh chụp màn hình cũng không có tên điện thoại. Sau đó, nhờ ChatGPT 4o cho biết nên mua điện thoại nào.

Kiểm tra nhận dạng ký tự trên ChatGPT 4o

Nó trích xuất thành công văn bản từ ảnh chụp màn hình, so sánh các thông số kỹ thuật và bảo tôi mua Điện thoại 2, thực ra là Pixel 8. Hơn nữa, tôi yêu cầu nó đoán điện thoại và một lần nữa, ChatGPT 4o đã đưa ra câu trả lời đúng - Pixel 8.

Bài kiểm tra tương tự đã được thực hiện trên Gemini 1.5 Pro thông qua Google AI Studio. Gemini Advanced chưa hỗ trợ upload hàng loạt hình ảnh. Kết quả là nó không trích xuất được văn bản từ cả hai ảnh chụp màn hình và liên tục hỏi thêm chi tiết. Trong các thử nghiệm như thế này, bạn thấy rằng Google thua xa OpenAI khi nói đến việc hoàn thành công việc một cách liền mạch.

Tùy chọn chiến thắng: ChatGPT 4o

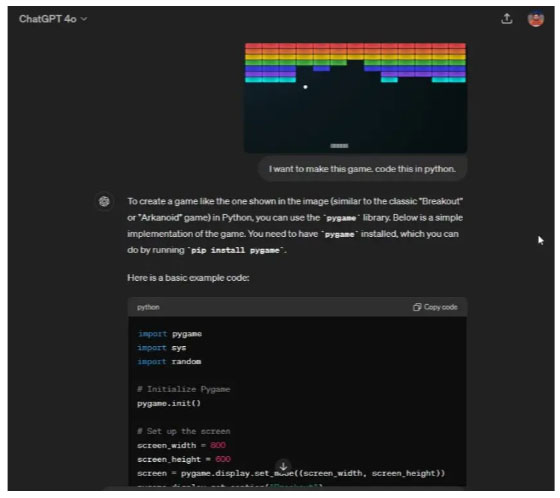

8. Tạo game

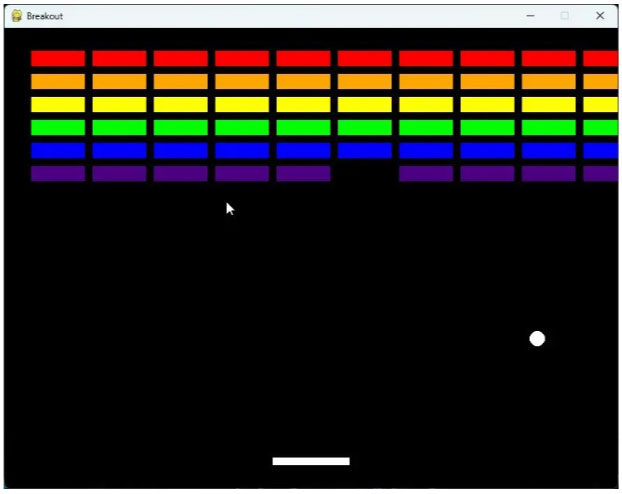

Bây giờ để kiểm tra khả năng mã hóa của ChatGPT 4o và Gemini 1.5 Pro, tác giả đã yêu cầu cả hai model tạo một game. Tác giả đã upload lên ảnh chụp màn hình của game Atari Breakout (tất nhiên là không tiết lộ tên) và yêu cầu ChatGPT 4o tạo game này bằng Python. Chỉ trong vài giây, nó tạo ra toàn bộ code và yêu cầu cài đặt thêm thư viện “pygame”.

Tạo game Python bằng ChatGPT 4o

Sau khi cài đặt thư viện và chạy code bằng Python, game đã khởi chạy thành công mà không có bất kỳ lỗi nào. Tuyệt vời! Không cần gỡ lỗi qua lại. Trên thực tế, tác giả đã yêu cầu ChatGPT 4o cải thiện trải nghiệm bằng cách thêm hotkey Resume và nó đã nhanh chóng bổ sung chức năng. Điều đó thật tuyệt!

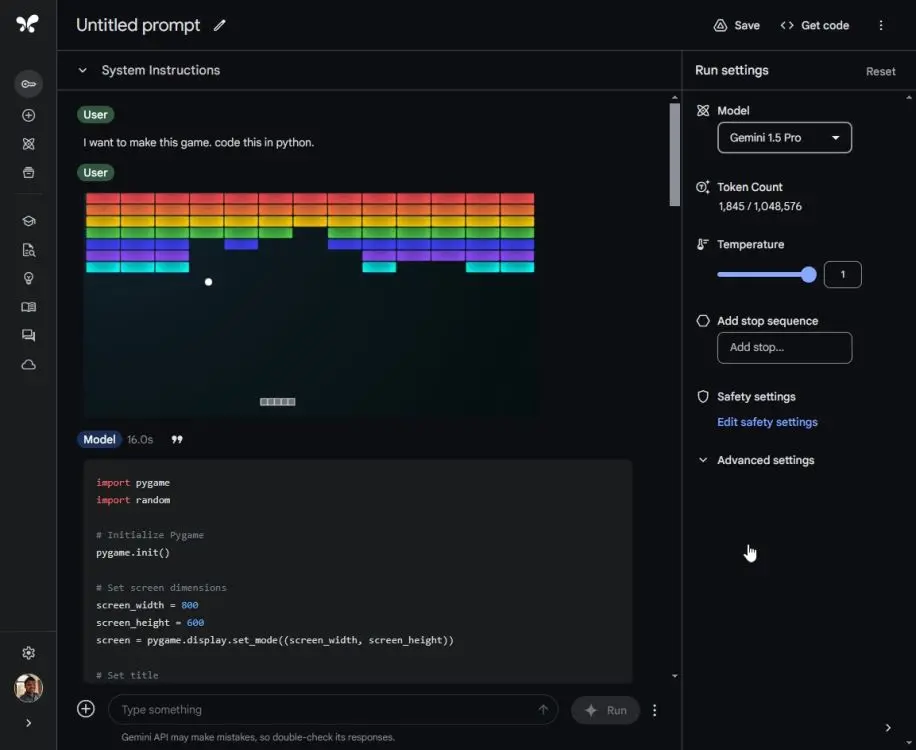

Tiếp theo, upload hình ảnh tương tự lên Gemini 1.5 Pro và yêu cầu nó tạo code cho game này. Gemini 1.5 Pro tạo ra code, nhưng khi chạy nó, cửa sổ tiếp tục đóng. Không thể chơi game này chút nào. Nói một cách đơn giản, đối với các tác vụ mã hóa, ChatGPT 4o đáng tin cậy hơn nhiều so với Gemini 1.5 Pro.

Tùy chọn chiến thắng: ChatGPT 4o

Kết luận

Rõ ràng là Gemini 1.5 Pro thua xa ChatGPT 4o. Ngay cả sau khi cải tiến model 1.5 Pro trong nhiều tháng ở bản xem trước, nó vẫn không thể cạnh tranh với model GPT-4o mới nhất của OpenAI. Từ lý luận thông thường đến các bài kiểm tra đa phương thức và mã hóa, ChatGPT 4o thực hiện một cách thông minh và chăm chú làm theo hướng dẫn.

Ưu điểm duy nhất với Gemini 1.5 Pro là cửa sổ ngữ cảnh khổng lồ có hỗ trợ lên tới 1 triệu token. Ngoài ra, bạn cũng có thể upload video lên, đó là một lợi thế. Tuy nhiên, vì mô hình này không thông minh lắm nên không chắc nhiều người sẽ muốn sử dụng nó chỉ vì cửa sổ ngữ cảnh lớn.

Tại sự kiện Google I/O 2024, Google không công bố bất kỳ mô hình mới nào. Công ty đang mắc kẹt với model Gemini 1.5 Pro của mình. Không có thông tin về Gemini 1.5 Ultra hoặc Gemini 2.0. Nếu Google phải cạnh tranh với OpenAI thì cần phải có một bước nhảy vọt thực sự.

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống  Làng Công nghệ

Làng Công nghệ