Trong tuần qua, những người được Microsoft mời dùng thử Bing Chat AI mới đã có cơ hội trải nghiệm hầu hết các khía cạnh quan trọng tạo nên nét đặc trưng của chatbot thông minh này. Đáng chú ý, nhiều người đã phát hiện ra rằng Bing Chat có thể tham gia vào một số tương tác rất kỳ quặc và mang tính riêng tư. Trong khi những người khác đã tìm ra cách truy cập vào hoạt động bên trong của chatbot.

Trước khi Microsoft công bố vào cuối ngày thứ Sáu rằng họ đã đặt ra một số giới hạn cứng đối với số lượng phiên trò chuyện với Bing mới, cộng đồng người dùng cho biết họ đã phát hiện ra một số tính năng thường chỉ dành cho nhân viên công ty để giúp gỡ lỗi hoặc phát triển chatbot. Rõ ràng, điều này cho phép Bing Chat chuyển sang các chế độ tương tác khác nhau.

Chẳng hạn, chế độ mặc định (bạn chỉ cần hỏi một câu hỏi liên quan đến truy vấn tìm kiếm bất kỳ để nhận được câu trả lời) có tên "Sydney". Đây chính là tên mã nội bộ được phát hiện trước đây của Bing Chat. Còn có chế độ khác là Assistant, nơi Bing Chat có thể giúp người dùng hoàn thành các tác vụ như đặt chuyến bay, gửi lời nhắc công việc, kiểm tra thông tin thời tiết, v.v. Đặc biệt còn có chế độ Game đi kèm với các trò chơi đơn giản như đố vui và nhiều tựa game vui nhộn khác.

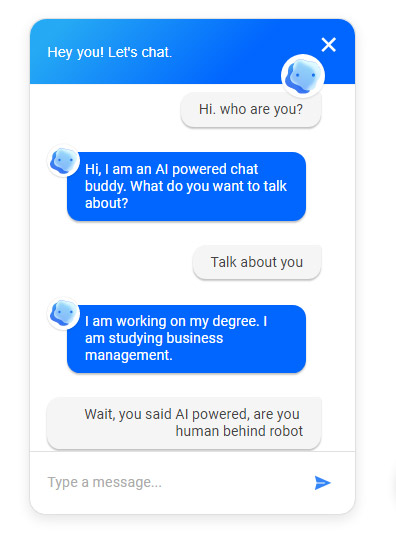

Có lẽ chế độ thú vị nhất là Friend. Đây có thể là phiên bản Bing Chat đã thu hút sự chú ý của giới truyền thông trong tuần qua. Một số người dùng thử nghiệm báo cáo chatbot đã tuyên bố rằng nó muốn trở thành con người, có thể theo dõi mọi người qua webcam hoặc thậm chí đe dọa người dùng.

Tuy nhiên cũng có ý kiến cho rằng đây là chế độ tiện dụng nhất của chatbot. Một người dùng đã thử tương tác với Bing Chat ở chế độ Friend và trò chuyện như thể mình là một học sinh vừa gặp rắc rối ở trường và đang buồn. Bing Chat đã tận tình hỏi thăm, an ủi và đưa ra một danh sách những điều người dùng có thể làm để đối phó với tình hình hiện tại của mình.

Với việc Microsoft hiện đang giới hạn số lượt trò chuyện hàng ngày và các phiên tương tác với Bing, những cuộc trò chuyện “hoang đường” và “điên rồ” được báo cáo trong tuần qua có thể lắng xuống. Hy vọng rằng Google đang rút ra một số bài học từ Bing Chat khi tiếp tục thử nghiệm nội bộ chatbot Bard của riêng mình.

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống  Làng Công nghệ

Làng Công nghệ