-

Theo hãng nghiên cứu thị trường Gartner, ảo hóa cùng vi xử lý đa lõi, điện toán “đám mây”, điện-toán-mọi-nơi và mạng xã hội ảo sẽ là 5 công nghệ làm thay đổi hoàn toàn ngành công nghiệp CNTT toàn cầu.

-

XenServer là phần mềm ảo hóa được đưa ra bởi Citrix – công ty chuyên về công nghệ ảo hóa. Được phát triển trên nền tảng Xen, XenServer hỗ trợ cho cả Linux và Window vì thế sẽ thuận lợi hơn cho khách hàng khi khởi tạo VPS. Bài viết sẽ hướng dẫn người dùng cách cài đặt Citrix XenServer 6 và XenCenter bắt đầu từ yêu cầu hệ thống và cuối cùng là các bước cài đặt.

-

Ảo hóa là một trong các chủ đề được quan tâm nhất hiện nay. Bạn sẽ thấy hầu hết các dân IT chuyên nghiệp (quản trị hệ thống và quản trị mạng) đều nói rất nhiều về ảo hóa.

-

Nếu bạn đang sử dụng Linux thì bạn không cần VirtualBox hay Vmware để tạo máy ảo. Ta có thể sử dụng KVM, một máy ảo kernel cho phép chạy cả Windows và Linux trong các con máy ảo.

-

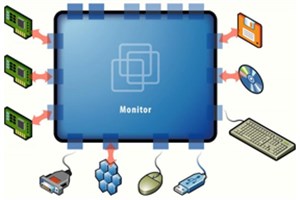

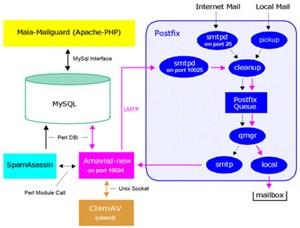

Postfix là một MTA (Mail Transport Agent), được viết bởi Wietse Venema khi ông đang làm việc ở trung tâm nghiên cứu T. J. Watson của IBM. Đặc điểm của Postfix: dễ quản lý, nhanh, an toàn...

-

Bài viết sau chúng tôi sẽ giúp người dùng CentOS thiết lập một máy chủ CentOS 5.7 x86_64 cho cài đặt ISPConfig 3. Sau đó tiến hành cài đặt và cấu hình ISPConfig 3.

-

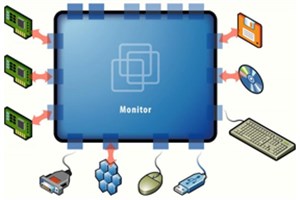

Ảo hóa giúp việc quản trị đơn giản cũng như giảm chi phí. Bài viết sẽ hướng dẫn bạn cách chọn máy chủ và phần mềm dùng cho ảo hóa. Bằng cách dùng một máy chủ vật lý để chạy nhiều máy chủ ảo hóa, bạn có thể giảm nhiều chi phí hoạt động cũng như chi phí đầu tư.

-

Chuyên mục Linux trên QuanTriMang sẽ cố gắng cập nhật đầy đủ các hướng dẫn tối ưu nhất để bạn đọc có thể dễ dàng thao tác, kịp thời, nhanh chóng. Bài hướng dẫn sau đây sẽ trình bày cách sử dụng KVM trên hệ thống Ubuntu 11.10.

-

Với quá nhiều bản phân phối Linux có sẵn, việc chọn một distro phù hợp cho máy tính gia đình thật không dễ dàng. Việc chọn một bản phân phối Linux cho máy chủ thậm chí còn khó khăn hơn.

-

-size-300x0-znd.jpg)

Trong bài viết sau, Quản Trị Mạng sẽ giới thiệu với các bạn cách thức chạy máy ảo với Sun VirtualBox 3.1.x trên hệ thống headless CentOS 5.4 server

-

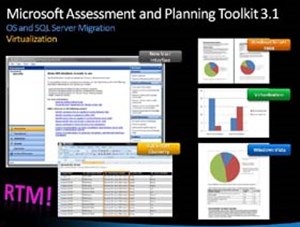

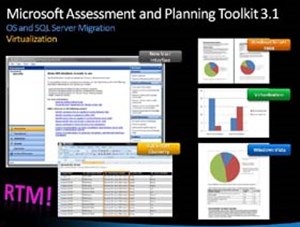

Trong bài này chúng tôi sẽ giới thiệu cho các bạn một tổng quan về việc đánh giá việc ảo hóa máy chủ và kiểu dữ liệu mà bạn cần phải lựa chọn để thực hiện một đánh giá như vậy.

-

Với CentOS Stream, Red Hat đã thay đổi vị trí của CentOS từ bản sao miễn phí của Red Hat Enterprise Linux thành một dự án upstream giữa Fedora và RHEL.

-

Do sự phổ biến của Pi với vai trò một home server, Quantrimang.com hôm nay sẽ hướng dẫn bạn cách cài đặt CentOS trên Raspberry Pi.

-

Kiến trúc ARM đã được sử dụng rộng rãi trong điện thoại thông minh và đang tiến vào thị trường PC vì những lợi thế mà nó mang lại.

-

Hầu hết các hệ điều hành ngày nay đều hỗ trợ giải pháp cài đặt đa hệ điều hành trên nhiều phân vùng khác nhau của ổ đĩa cứng. Nhưng đã bao giờ bạn đã nghĩ đến việc có thể chạy cùng một lúc nhiều hệ điều hành chưa? Ảo hoá sẽ giúp bạn thực hiện điều đó.

-

Bắt đầu với KVM trên Linux là một quá trình đơn giản. Nếu bạn muốn chạy các bản phân phối Linux khác hoặc thậm chí Windows trên PC Linux của mình, tất cả những gì bạn cần làm là cài đặt một vài mô-đun và chuẩn bị PC cho việc ảo hóa.

-

Ảo hóa máy chủ có thể giúp chống lại việc các máy chủ hoạt động kém, tận dụng tốt hơn khả năng tính toán, hạn chế việc tiêu thụ năng lượng và cải thiện sự linh hoạt của trung tâm dữ liệu.

-

Intel và HP Việt Nam đã trao hai máy chủ cho Cục Tin học và Thống kê tài chính nhằm phục vụ dự án thử nghiệm công nghệ ảo hóa.

-

Việc thiết lập một máy ảo mới trên Arch Linux bằng KVM và QEMU có vẻ khó khăn. Nhưng đừng băn khoăn, vì sẽ rất dễ dàng để học cách thực hiện.

-

Trend Micro đang dẫn đầu thị trường thế giới về giải pháp an ninh đầu cuối dành cho máy chủ doanh nghiệp, ước tính khoảng 22,9%.

-

Hôm thứ tư ngày 4/5/2011, Internap công bố kế hoạch “nhảy vào” thị trường đám mây công cộng vào cuối năm nay với các dịch vụ dựa trên nền tảng ảo hóa VMware hoặc KVM hypervisor (một nền tảng ảo hóa nguồn mở).

-

Vài công ty CNTT lớn do IBM, Red Hat dẫn đầu, tuyên bố sáng kiến mới: Liên minh ảo hoá mở, tung ra giải pháp mở KVM trên hệ điều hành Linux với sự tham gia của HP, Intel, Novell, BMC và Eucalyptus.

Chia sẻ dữ liệu giữa máy tính thật và máy ảo tạo bằng VMware WorkStation là nhu cầu không hề xa lạ với người dùng, chuyển đổi qua lại giữa các tài liệu.

Chia sẻ dữ liệu giữa máy tính thật và máy ảo tạo bằng VMware WorkStation là nhu cầu không hề xa lạ với người dùng, chuyển đổi qua lại giữa các tài liệu. Làm sao để biết máy tính đã bật ảo hóa chưa? Với cách kiểm tra ảo hóa bật hay tắt trong bài viết này, bạn có thể biết được trạng thái ảo hóa của máy tính chỉ chưa đầy 1 phút.

Làm sao để biết máy tính đã bật ảo hóa chưa? Với cách kiểm tra ảo hóa bật hay tắt trong bài viết này, bạn có thể biết được trạng thái ảo hóa của máy tính chỉ chưa đầy 1 phút. Theo hãng nghiên cứu thị trường Gartner, ảo hóa cùng vi xử lý đa lõi, điện toán “đám mây”, điện-toán-mọi-nơi và mạng xã hội ảo sẽ là 5 công nghệ làm thay đổi hoàn toàn ngành công nghiệp CNTT toàn cầu.

Theo hãng nghiên cứu thị trường Gartner, ảo hóa cùng vi xử lý đa lõi, điện toán “đám mây”, điện-toán-mọi-nơi và mạng xã hội ảo sẽ là 5 công nghệ làm thay đổi hoàn toàn ngành công nghiệp CNTT toàn cầu. XenServer là phần mềm ảo hóa được đưa ra bởi Citrix – công ty chuyên về công nghệ ảo hóa. Được phát triển trên nền tảng Xen, XenServer hỗ trợ cho cả Linux và Window vì thế sẽ thuận lợi hơn cho khách hàng khi khởi tạo VPS. Bài viết sẽ hướng dẫn người dùng cách cài đặt Citrix XenServer 6 và XenCenter bắt đầu từ yêu cầu hệ thống và cuối cùng là các bước cài đặt.

XenServer là phần mềm ảo hóa được đưa ra bởi Citrix – công ty chuyên về công nghệ ảo hóa. Được phát triển trên nền tảng Xen, XenServer hỗ trợ cho cả Linux và Window vì thế sẽ thuận lợi hơn cho khách hàng khi khởi tạo VPS. Bài viết sẽ hướng dẫn người dùng cách cài đặt Citrix XenServer 6 và XenCenter bắt đầu từ yêu cầu hệ thống và cuối cùng là các bước cài đặt. Ảo hóa là một trong các chủ đề được quan tâm nhất hiện nay. Bạn sẽ thấy hầu hết các dân IT chuyên nghiệp (quản trị hệ thống và quản trị mạng) đều nói rất nhiều về ảo hóa.

Ảo hóa là một trong các chủ đề được quan tâm nhất hiện nay. Bạn sẽ thấy hầu hết các dân IT chuyên nghiệp (quản trị hệ thống và quản trị mạng) đều nói rất nhiều về ảo hóa. Nếu bạn đang sử dụng Linux thì bạn không cần VirtualBox hay Vmware để tạo máy ảo. Ta có thể sử dụng KVM, một máy ảo kernel cho phép chạy cả Windows và Linux trong các con máy ảo.

Nếu bạn đang sử dụng Linux thì bạn không cần VirtualBox hay Vmware để tạo máy ảo. Ta có thể sử dụng KVM, một máy ảo kernel cho phép chạy cả Windows và Linux trong các con máy ảo. Postfix là một MTA (Mail Transport Agent), được viết bởi Wietse Venema khi ông đang làm việc ở trung tâm nghiên cứu T. J. Watson của IBM. Đặc điểm của Postfix: dễ quản lý, nhanh, an toàn...

Postfix là một MTA (Mail Transport Agent), được viết bởi Wietse Venema khi ông đang làm việc ở trung tâm nghiên cứu T. J. Watson của IBM. Đặc điểm của Postfix: dễ quản lý, nhanh, an toàn... Bài viết sau chúng tôi sẽ giúp người dùng CentOS thiết lập một máy chủ CentOS 5.7 x86_64 cho cài đặt ISPConfig 3. Sau đó tiến hành cài đặt và cấu hình ISPConfig 3.

Bài viết sau chúng tôi sẽ giúp người dùng CentOS thiết lập một máy chủ CentOS 5.7 x86_64 cho cài đặt ISPConfig 3. Sau đó tiến hành cài đặt và cấu hình ISPConfig 3. Ảo hóa giúp việc quản trị đơn giản cũng như giảm chi phí. Bài viết sẽ hướng dẫn bạn cách chọn máy chủ và phần mềm dùng cho ảo hóa. Bằng cách dùng một máy chủ vật lý để chạy nhiều máy chủ ảo hóa, bạn có thể giảm nhiều chi phí hoạt động cũng như chi phí đầu tư.

Ảo hóa giúp việc quản trị đơn giản cũng như giảm chi phí. Bài viết sẽ hướng dẫn bạn cách chọn máy chủ và phần mềm dùng cho ảo hóa. Bằng cách dùng một máy chủ vật lý để chạy nhiều máy chủ ảo hóa, bạn có thể giảm nhiều chi phí hoạt động cũng như chi phí đầu tư. Chuyên mục Linux trên QuanTriMang sẽ cố gắng cập nhật đầy đủ các hướng dẫn tối ưu nhất để bạn đọc có thể dễ dàng thao tác, kịp thời, nhanh chóng. Bài hướng dẫn sau đây sẽ trình bày cách sử dụng KVM trên hệ thống Ubuntu 11.10.

Chuyên mục Linux trên QuanTriMang sẽ cố gắng cập nhật đầy đủ các hướng dẫn tối ưu nhất để bạn đọc có thể dễ dàng thao tác, kịp thời, nhanh chóng. Bài hướng dẫn sau đây sẽ trình bày cách sử dụng KVM trên hệ thống Ubuntu 11.10. Với quá nhiều bản phân phối Linux có sẵn, việc chọn một distro phù hợp cho máy tính gia đình thật không dễ dàng. Việc chọn một bản phân phối Linux cho máy chủ thậm chí còn khó khăn hơn.

Với quá nhiều bản phân phối Linux có sẵn, việc chọn một distro phù hợp cho máy tính gia đình thật không dễ dàng. Việc chọn một bản phân phối Linux cho máy chủ thậm chí còn khó khăn hơn.-size-300x0-znd.jpg) Trong bài viết sau, Quản Trị Mạng sẽ giới thiệu với các bạn cách thức chạy máy ảo với Sun VirtualBox 3.1.x trên hệ thống headless CentOS 5.4 server

Trong bài viết sau, Quản Trị Mạng sẽ giới thiệu với các bạn cách thức chạy máy ảo với Sun VirtualBox 3.1.x trên hệ thống headless CentOS 5.4 server Trong bài này chúng tôi sẽ giới thiệu cho các bạn một tổng quan về việc đánh giá việc ảo hóa máy chủ và kiểu dữ liệu mà bạn cần phải lựa chọn để thực hiện một đánh giá như vậy.

Trong bài này chúng tôi sẽ giới thiệu cho các bạn một tổng quan về việc đánh giá việc ảo hóa máy chủ và kiểu dữ liệu mà bạn cần phải lựa chọn để thực hiện một đánh giá như vậy. Với CentOS Stream, Red Hat đã thay đổi vị trí của CentOS từ bản sao miễn phí của Red Hat Enterprise Linux thành một dự án upstream giữa Fedora và RHEL.

Với CentOS Stream, Red Hat đã thay đổi vị trí của CentOS từ bản sao miễn phí của Red Hat Enterprise Linux thành một dự án upstream giữa Fedora và RHEL. Do sự phổ biến của Pi với vai trò một home server, Quantrimang.com hôm nay sẽ hướng dẫn bạn cách cài đặt CentOS trên Raspberry Pi.

Do sự phổ biến của Pi với vai trò một home server, Quantrimang.com hôm nay sẽ hướng dẫn bạn cách cài đặt CentOS trên Raspberry Pi. Kiến trúc ARM đã được sử dụng rộng rãi trong điện thoại thông minh và đang tiến vào thị trường PC vì những lợi thế mà nó mang lại.

Kiến trúc ARM đã được sử dụng rộng rãi trong điện thoại thông minh và đang tiến vào thị trường PC vì những lợi thế mà nó mang lại. Hầu hết các hệ điều hành ngày nay đều hỗ trợ giải pháp cài đặt đa hệ điều hành trên nhiều phân vùng khác nhau của ổ đĩa cứng. Nhưng đã bao giờ bạn đã nghĩ đến việc có thể chạy cùng một lúc nhiều hệ điều hành chưa? Ảo hoá sẽ giúp bạn thực hiện điều đó.

Hầu hết các hệ điều hành ngày nay đều hỗ trợ giải pháp cài đặt đa hệ điều hành trên nhiều phân vùng khác nhau của ổ đĩa cứng. Nhưng đã bao giờ bạn đã nghĩ đến việc có thể chạy cùng một lúc nhiều hệ điều hành chưa? Ảo hoá sẽ giúp bạn thực hiện điều đó. Bắt đầu với KVM trên Linux là một quá trình đơn giản. Nếu bạn muốn chạy các bản phân phối Linux khác hoặc thậm chí Windows trên PC Linux của mình, tất cả những gì bạn cần làm là cài đặt một vài mô-đun và chuẩn bị PC cho việc ảo hóa.

Bắt đầu với KVM trên Linux là một quá trình đơn giản. Nếu bạn muốn chạy các bản phân phối Linux khác hoặc thậm chí Windows trên PC Linux của mình, tất cả những gì bạn cần làm là cài đặt một vài mô-đun và chuẩn bị PC cho việc ảo hóa. Ảo hóa máy chủ có thể giúp chống lại việc các máy chủ hoạt động kém, tận dụng tốt hơn khả năng tính toán, hạn chế việc tiêu thụ năng lượng và cải thiện sự linh hoạt của trung tâm dữ liệu.

Ảo hóa máy chủ có thể giúp chống lại việc các máy chủ hoạt động kém, tận dụng tốt hơn khả năng tính toán, hạn chế việc tiêu thụ năng lượng và cải thiện sự linh hoạt của trung tâm dữ liệu. Intel và HP Việt Nam đã trao hai máy chủ cho Cục Tin học và Thống kê tài chính nhằm phục vụ dự án thử nghiệm công nghệ ảo hóa.

Intel và HP Việt Nam đã trao hai máy chủ cho Cục Tin học và Thống kê tài chính nhằm phục vụ dự án thử nghiệm công nghệ ảo hóa. Việc thiết lập một máy ảo mới trên Arch Linux bằng KVM và QEMU có vẻ khó khăn. Nhưng đừng băn khoăn, vì sẽ rất dễ dàng để học cách thực hiện.

Việc thiết lập một máy ảo mới trên Arch Linux bằng KVM và QEMU có vẻ khó khăn. Nhưng đừng băn khoăn, vì sẽ rất dễ dàng để học cách thực hiện. Trend Micro đang dẫn đầu thị trường thế giới về giải pháp an ninh đầu cuối dành cho máy chủ doanh nghiệp, ước tính khoảng 22,9%.

Trend Micro đang dẫn đầu thị trường thế giới về giải pháp an ninh đầu cuối dành cho máy chủ doanh nghiệp, ước tính khoảng 22,9%. Hôm thứ tư ngày 4/5/2011, Internap công bố kế hoạch “nhảy vào” thị trường đám mây công cộng vào cuối năm nay với các dịch vụ dựa trên nền tảng ảo hóa VMware hoặc KVM hypervisor (một nền tảng ảo hóa nguồn mở).

Hôm thứ tư ngày 4/5/2011, Internap công bố kế hoạch “nhảy vào” thị trường đám mây công cộng vào cuối năm nay với các dịch vụ dựa trên nền tảng ảo hóa VMware hoặc KVM hypervisor (một nền tảng ảo hóa nguồn mở). Vài công ty CNTT lớn do IBM, Red Hat dẫn đầu, tuyên bố sáng kiến mới: Liên minh ảo hoá mở, tung ra giải pháp mở KVM trên hệ điều hành Linux với sự tham gia của HP, Intel, Novell, BMC và Eucalyptus.

Vài công ty CNTT lớn do IBM, Red Hat dẫn đầu, tuyên bố sáng kiến mới: Liên minh ảo hoá mở, tung ra giải pháp mở KVM trên hệ điều hành Linux với sự tham gia của HP, Intel, Novell, BMC và Eucalyptus. Công nghệ

Công nghệ  Học CNTT

Học CNTT  Tiện ích

Tiện ích  Khoa học

Khoa học  Cuộc sống

Cuộc sống  Làng Công nghệ

Làng Công nghệ

Công nghệ

Công nghệ  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Linux

Linux  Đồng hồ thông minh

Đồng hồ thông minh  macOS

macOS  Chụp ảnh - Quay phim

Chụp ảnh - Quay phim  Thủ thuật SEO

Thủ thuật SEO  Phần cứng

Phần cứng  Kiến thức cơ bản

Kiến thức cơ bản  Dịch vụ ngân hàng

Dịch vụ ngân hàng  Lập trình

Lập trình  Dịch vụ công trực tuyến

Dịch vụ công trực tuyến  Dịch vụ nhà mạng

Dịch vụ nhà mạng  Học CNTT

Học CNTT  Quiz công nghệ

Quiz công nghệ  Microsoft Word 2016

Microsoft Word 2016  Microsoft Word 2013

Microsoft Word 2013  Microsoft Word 2007

Microsoft Word 2007  Microsoft Excel 2019

Microsoft Excel 2019  Microsoft Excel 2016

Microsoft Excel 2016  Microsoft PowerPoint 2019

Microsoft PowerPoint 2019  Google Sheets

Google Sheets  Học Photoshop

Học Photoshop  Lập trình Scratch

Lập trình Scratch  Bootstrap

Bootstrap  Download

Download  Văn phòng

Văn phòng  Tải game

Tải game  Tiện ích hệ thống

Tiện ích hệ thống  Ảnh, đồ họa

Ảnh, đồ họa  Internet

Internet  Bảo mật, Antivirus

Bảo mật, Antivirus  Doanh nghiệp

Doanh nghiệp  Video, phim, nhạc

Video, phim, nhạc  Mạng xã hội

Mạng xã hội  Học tập - Giáo dục

Học tập - Giáo dục  Máy ảo

Máy ảo  AI Trí tuệ nhân tạo

AI Trí tuệ nhân tạo  ChatGPT

ChatGPT  Gemini

Gemini  Tiện ích

Tiện ích  Khoa học

Khoa học  Điện máy

Điện máy  Tivi

Tivi  Tủ lạnh

Tủ lạnh  Điều hòa

Điều hòa  Máy giặt

Máy giặt  Cuộc sống

Cuộc sống  TOP

TOP  Kỹ năng

Kỹ năng  Món ngon mỗi ngày

Món ngon mỗi ngày  Nuôi dạy con

Nuôi dạy con  Mẹo vặt

Mẹo vặt  Phim ảnh, Truyện

Phim ảnh, Truyện  Làm đẹp

Làm đẹp  DIY - Handmade

DIY - Handmade  Du lịch

Du lịch  Quà tặng

Quà tặng  Giải trí

Giải trí  Là gì?

Là gì?  Nhà đẹp

Nhà đẹp  Giáng sinh - Noel

Giáng sinh - Noel  Hướng dẫn

Hướng dẫn  Ô tô, Xe máy

Ô tô, Xe máy  Làng Công nghệ

Làng Công nghệ  Tấn công mạng

Tấn công mạng  Chuyện công nghệ

Chuyện công nghệ  Công nghệ mới

Công nghệ mới  Trí tuệ Thiên tài

Trí tuệ Thiên tài  Bình luận công nghệ

Bình luận công nghệ