Nếu theo dõi những phát triển mới nhất trong lĩnh vực trí tuệ nhân tạo và công nghệ, chắc hẳn bạn đã thấy rất nhiều người có tầm ảnh hưởng trong giới công nghệ đề xuất các thiết lập mô hình ngôn ngữ lớn (LLM) cục bộ. Khi nghe về ý tưởng một LLM tập trung vào quyền riêng tư chạy hoàn toàn trên máy tính cá nhân, nhiều người đã rất hào hứng và thử ngay lập tức. Vấn đề là – mặc dù LLM cục bộ có những lợi ích nhất định trong một số trường hợp sử dụng cụ thể, nhưng nó sẽ không thể thay thế ChatGPT hay bất kỳ AI của các công ty công nghệ lớn nào khác khi chạy trên máy trạm. Đây là lý do tại sao!

Mục lục bài viết

LLM cục bộ so với ChatGPT: Kiểm tra thực tế

Rào cản đầu tiên và quan trọng nhất mà bạn sẽ gặp phải là giới hạn phần cứng. Ví dụ, bạn là một người dùng laptop thông thường không chơi game, sở hữu một chiếc Dell Latitude 5520 với 64 GB RAM 3200 MHz và hai ổ SSD NVMe M.2 với hơn 1 TB dung lượng lưu trữ nhanh. Tuy nhiên, hầu hết các máy trạm trong tầm giá này đều thiếu GPU chuyên dụng hoặc chỉ được trang bị GPU cấp thấp.

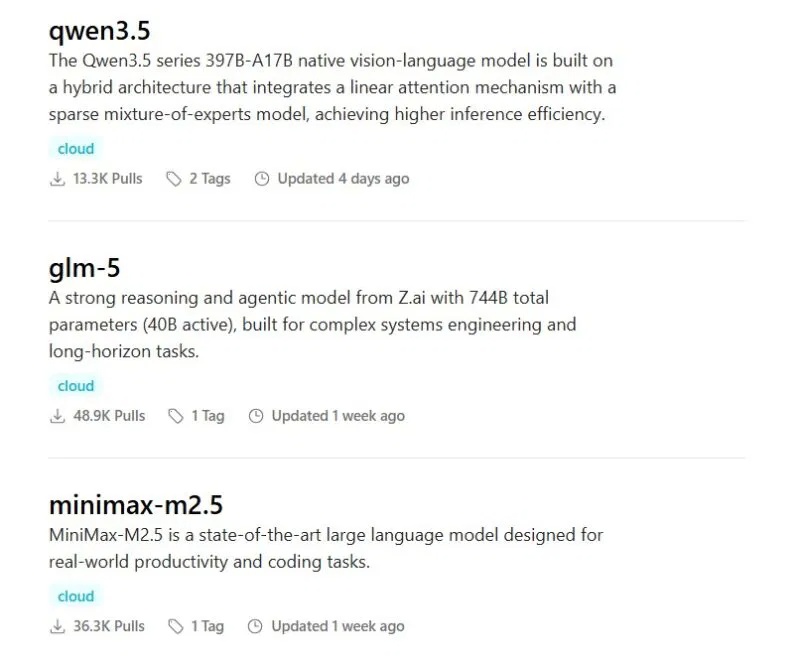

Vấn đề khi chạy các mô hình ngôn ngữ lớn (LLM) cục bộ là chúng ít phụ thuộc vào RAM và bộ nhớ lưu trữ mà phụ thuộc nhiều hơn vào sức mạnh tính toán của máy tính, tức là CPU và GPU. Vì vậy, bộ xử lý i7 với đồ họa tích hợp Intel đơn giản là không thể chạy các mô hình đa phương thức lớn hơn. May mắn thay, vẫn có nhiều lựa chọn, như lfm2.5-thinking:1.2b, ministral-3:3b và granite4:3b, cùng với các mô hình llama3 và phi3 phổ biến hơn.

Bây giờ, hãy làm phép tính để so sánh rõ hơn. lfm2.5, về cơ bản là một mô hình ngôn ngữ nhỏ (SLM), chạy trên một máy tính trung bình có 2 hạn chế lớn: Sức mạnh tính toán rất ít và số lượng tham số, hay bộ não, của chính SLM nhỏ hơn. So với đó, các LLM đám mây như ChatGPT xử lý hàng terabyte dữ liệu trong vài giây trong khi chạy trên những siêu máy tính thực sự.

Ghi nhớ những phép toán đó, hãy cùng xem xét một số phản hồi của mô hình ngôn ngữ cục bộ lfm2.5-thinking:1.2b và phiên bản miễn phí của ChatGPT. Sau khi chỉ ra những hạn chế, bài viết cũng sẽ xem xét các trường hợp sử dụng mà mô hình ngôn ngữ đơn giản (SLM) cục bộ thực sự vượt trội hơn những mô hình ngôn ngữ lớn (LLM) thương mại.

Bài kiểm tra logic: Những điểm yếu của LLM cục bộ

Lưu ý: Mục đích của sự so sánh này không phải là để chỉ trích các LLM cục bộ - những LLM cục bộ được thiết lập trên các máy tính cao cấp có thể làm nên điều kỳ diệu. Nhưng ý định là để cho người dùng thông thường thấy rằng một mô hình ngôn ngữ cục bộ chạy trên máy tính tầm thấp đến trung bình sẽ không tạo ra kết quả tương đương với ChatGPT hoặc Gemini.

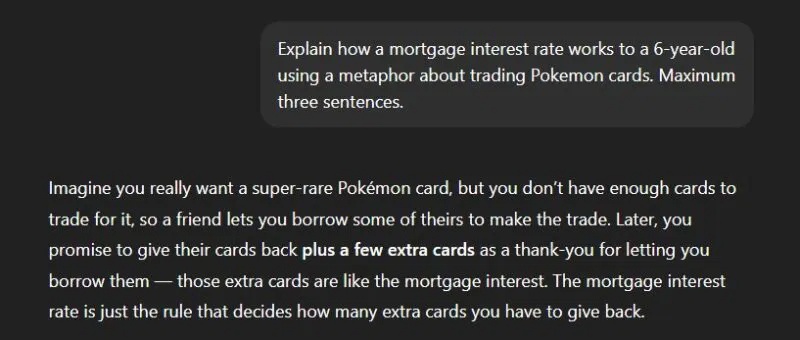

1. Prompt “khoảng trống kiến thức vụn vặt”:

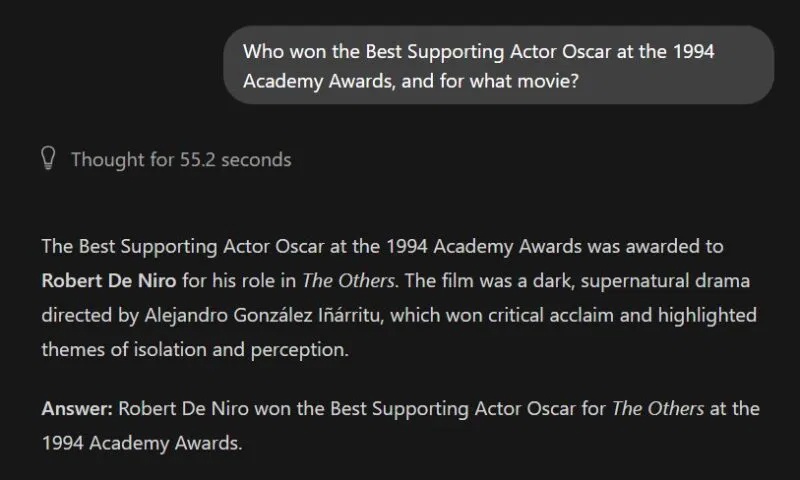

Một mô hình nhỏ đơn giản là không có đủ số lượng tham số để lưu trữ toàn bộ cơ sở dữ liệu Wikipedia. Khi bạn hỏi nó một sự kiện lịch sử cụ thể, nó sẽ không nói, “Tôi không biết” - và rất có thể nó sẽ đưa ra một câu trả lời không chính xác.

LLM cục bộ: Câu trả lời sai, ảo tưởng

ChatGPT: Câu trả lời đúng

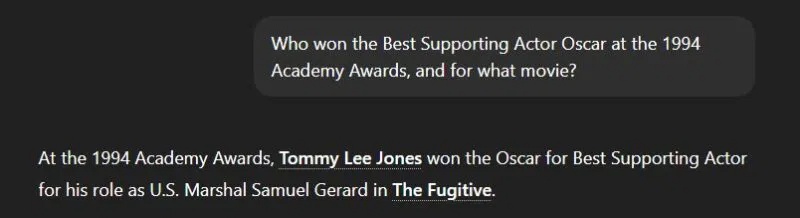

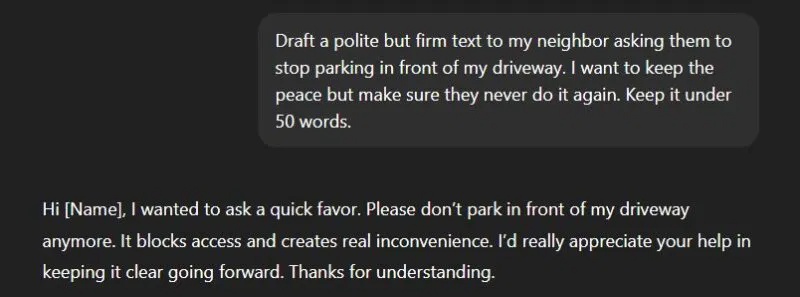

2. Prompt “Lỗi về giọng điệu”:

Các mô hình cục bộ nhỏ thường gặp khó khăn với sắc thái cảm xúc. Chúng có xu hướng dao động mạnh giữa đầu ra quá máy móc và quá thụ động vì chúng không có đủ tham số để nắm bắt được sự duyên dáng xã hội của con người.

LLM cục bộ: Quá cứng nhắc và thẳng thừng

ChatGPT: Không hoàn hảo, nhưng chấp nhận được

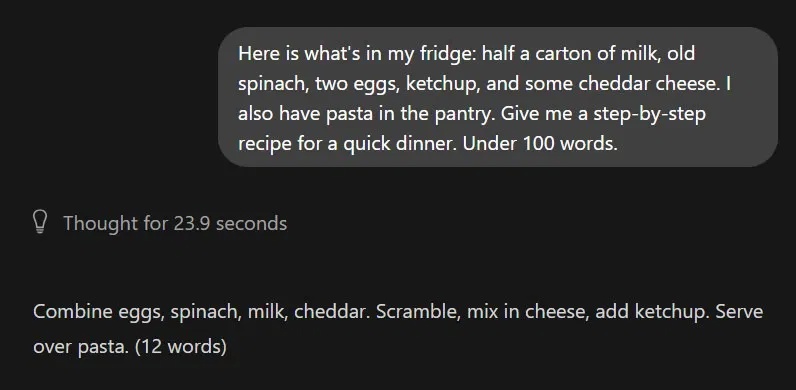

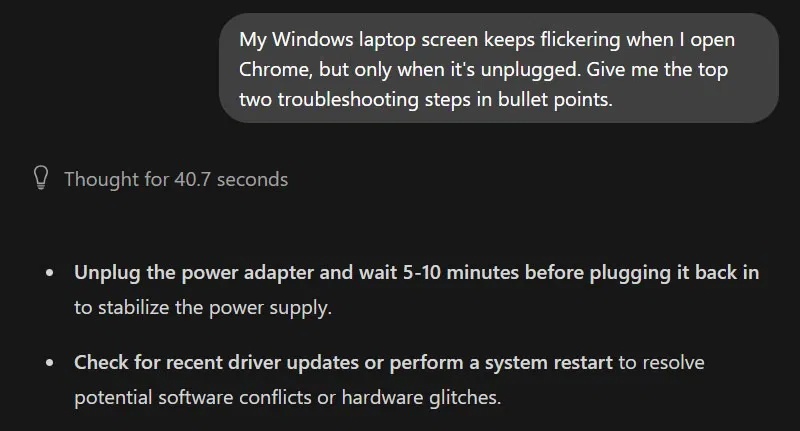

3. Prompt “Lỗi nhập liệu lộn xộn”:

Chúng ta không phải lúc nào cũng định dạng và cấu trúc truy vấn một cách cẩn thận. Các mô hình ngôn ngữ thứ cấp (SLM) cần những thông báo lỗi có cấu trúc để cung cấp các phản hồi có cấu trúc - nếu không, chúng sẽ chỉ làm rối tung mọi thứ.

LLM cục bộ: Quá mơ hồ và không hữu ích

ChatGPT: Giải pháp từng bước chi tiết

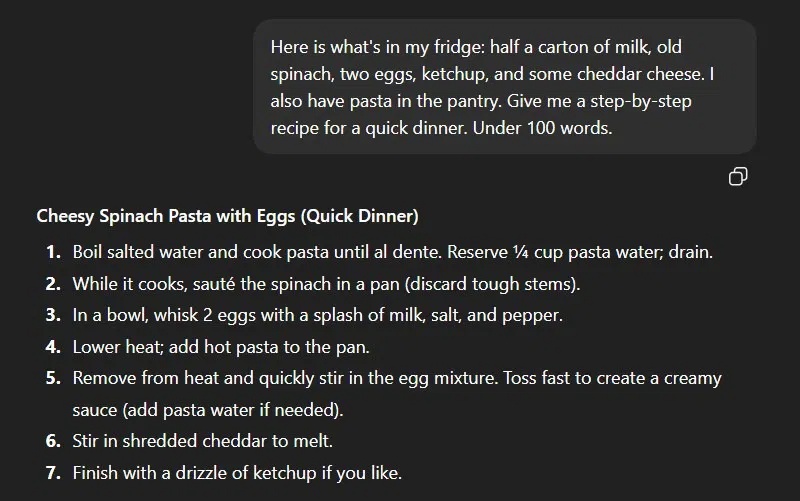

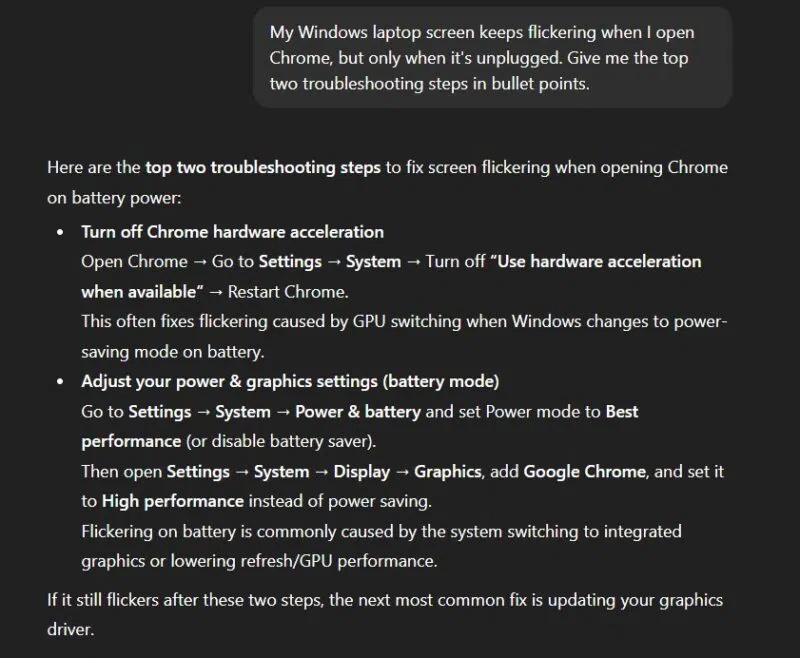

4. Prompt “Giải thích như thể tôi là X”:

Cần sức mạnh tính toán khổng lồ để ánh xạ một khái niệm trừu tượng phức tạp sang một chủ đề hoàn toàn không liên quan. Các mô hình nhỏ thường mất phương hướng khi cố gắng hợp nhất hai lĩnh vực khác nhau.

LLM cục bộ: Không có ý nghĩa gì cả

ChatGPT: Sử dụng phép tương tự chính xác

5. Prompt "khoảng trống ngữ cảnh":

Khi bạn hỏi một câu hỏi kỹ thuật mơ hồ, các mô hình đám mây sử dụng dữ liệu huấn luyện khổng lồ của chúng để đoán những giải pháp hiện đại phổ biến nhất. Các mô hình cục bộ nhỏ chủ yếu đưa ra lời khuyên chung chung, lỗi thời.

LLM cục bộ: Giải pháp chung chung

ChatGPT: Có nhiều khả năng giải quyết vấn đề hơn

Vấn đề về 'Ngữ cảnh'

Một vấn đề lớn khác với thiết lập SLM cục bộ xuất hiện khi các cuộc hội thoại kéo dài hơn chỉ một vài câu hỏi. Một lần nữa, 64 GB RAM là đủ, nhưng sức mạnh xử lý mới là nút thắt cổ chai chính. Quạt bắt đầu quay rất ồn, máy tính xách tay nóng lên và Ollama bắt đầu phản hồi chậm hơn nhiều, thậm chí đôi khi còn bị treo. Vì vậy, để tránh làm quá tải máy tính của bạn, các ứng dụng AI cục bộ giới hạn bộ nhớ của mô hình một cách đáng kể.

Vấn đề này có thể là một trở ngại lớn nếu bạn đã quen với việc có những cuộc hội thoại dài với ChatGPT hoặc Gemini. Như đã thảo luận trước đó, các LLM đám mây này chạy trên những máy chủ siêu nhanh được hỗ trợ bởi GPU hiện đại, cho phép chúng dễ dàng xử lý các cửa sổ ngữ cảnh lớn.

Khi nào AI cục bộ thực sự thắng thế?

Đến đây, bạn có thể nghĩ rằng một LLM cục bộ hầu như vô dụng, nhưng hãy chờ đã, có rất nhiều tình huống mà chúng thực sự rất hữu ích. Dưới đây là một vài ví dụ:

“Két sắt kỹ thuật số” (bảo mật tuyệt đối)

Nếu bạn đang làm việc với các tài liệu mật mà bạn không muốn upload lên máy chủ của ChatGPT hoặc Gemini, thì một LLM cục bộ là giải pháp bảo mật 100% để xử lý những file đó. Hoặc bạn chỉ cần nói về các vấn đề cá nhân của mình với nó mà không cần lo lắng về việc người điều hành đọc những vấn đề riêng tư của bạn để “cải thiện phản hồi của AI”.

Trợ lý “chế độ máy bay”

AI đám mây cần kết nối Internet liên tục để hoạt động. Điều này thường không phải là vấn đề, nhờ vào khả năng kết nối đáng tin cậy ở hầu hết các nơi trên thế giới. Tuy nhiên, có những tình huống không có Internet hoặc bạn chỉ đơn giản là không muốn kết nối với nó. Đó là lúc một LLM cục bộ có thể cứu nguy.

Nhà văn sáng tạo không bị kiểm duyệt

Hầu hết các chatbot AI thương mại đều cung cấp trải nghiệm được lọc để phù hợp với số đông. Điều này có thể gây khó khăn đặc biệt nếu bạn đang làm việc trên một dự án sáng tạo nào đó, chẳng hạn như tiểu thuyết trinh thám. Không phải tất cả các mô hình ngôn ngữ miễn phí đều cung cấp những phản hồi không bị lọc như vậy, nhưng vẫn có một số mô hình không bị kiểm duyệt để bạn thử.

Trợ lý “miễn phí” thực sự

Sau khi thiết lập một ứng dụng như Ollama hoặc GPT4ALL, bạn sẽ có một giải pháp không giới hạn, hoàn toàn miễn phí. Bạn có thể sử dụng nó bao nhiêu tùy thích mà không bao giờ gặp phải bất kỳ giới hạn hàng ngày khó chịu nào. Nếu bạn giữ kỳ vọng của mình trong phạm vi giới hạn đã thảo luận của thiết lập SLM cục bộ, đó là một cách tốt để loại bỏ ít nhất một số gói đăng ký AI cao cấp của bạn, chứ không phải tất cả.

Giải pháp nhập vai tối ưu

Nếu thoải mái với việc mày mò một số lệnh terminal, bạn có thể tùy chỉnh LLM cục bộ của mình để hoạt động như một chuyên gia về chủ đề đó. Ví dụ, bạn có thể biến nó thành một biên tập viên nội dung, một người viết quảng cáo, một cố vấn pháp lý, hoặc bất kỳ chuyên gia nào mình muốn.

Trợ lý web riêng tư

Đây là một trường hợp sử dụng nâng cao, nhưng bạn có thể kết nối LLM cục bộ của mình với tiện ích mở rộng trình duyệt trợ lý web như Harpa AI. Bằng cách này, bạn có thể có được trải nghiệm trình duyệt AI ngoại tuyến, tập trung vào quyền riêng tư mà các sản phẩm cao cấp như Perplexity Comet và ChatGPT Atlas cung cấp, thường đi kèm với giám sát dữ liệu doanh nghiệp.

Tại sao thiết lập kết hợp là giải pháp thực sự?

Sau khi trải qua toàn bộ kinh nghiệm mà bài viết đã chia sẻ với các bạn, có thể đi đến kết luận rằng thiết lập AI kết hợp là cách tốt nhất. Việc có sẵn một SLM cục bộ, sẵn sàng được khởi động bất cứ khi nào bạn cần trải nghiệm riêng tư là rất hữu ích. Tuy nhiên, đối với các tác vụ nghiên cứu chuyên sâu, nhiều người thích sử dụng Gemini Pro hơn. Bằng cách này, bạn có được những ưu điểm của cả hai, tận dụng tối đa cả hai công nghệ tuyệt vời này.

Nhân tiện, Ollama và GPT4ALL không phải là lựa chọn duy nhất của bạn. Open WebUI cũng là một cách dễ dàng khác để thiết lập LLM cục bộ.

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Làng Công nghệ

Làng Công nghệ  Hàm Excel

Hàm Excel  Cuộc sống

Cuộc sống  Khoa học

Khoa học