Facebook vừa phải chính thức đưa ra lời xin lỗi công khai sau một sự cố khá nghiêm trọng liên quan đến vấn đề phân biệt chủng tộc.

Theo đó, thuật toán AI của mạng xã hội lớn nhất thế giới đã gán nhãn một đoạn video về những người đàn ông da màu là “nội dung liên quan đến loài linh trưởng. Tất nhiên sự nhầm lẫn tai hại này đã gây ra làn sóng tranh cãi lớn, đặc biệt là trong bối cảnh nạn phân biệt chủng tộc vẫn đang là chủ đề nóng tại Hoa Kỳ cũng như nhiều quốc gia trên thế giới. Trước vô số chỉ trích từ dư luận, phía Facebook đã phải lập tức đưa ra lời xin lỗi công khai, cũng như đính chính về sự việc.

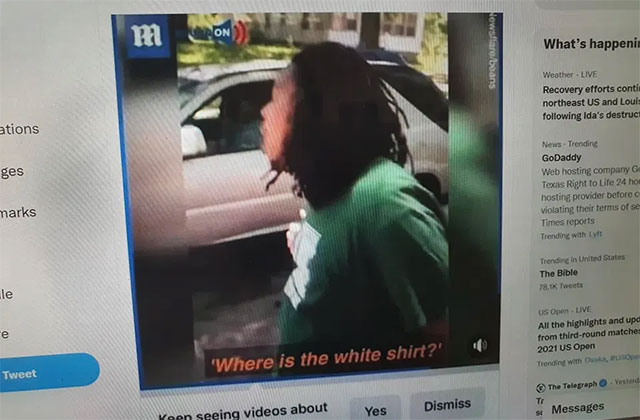

Trước đó theo báo cáo từ The New York Times, một số người dùng Facebook gần đây đã bắt gặp một đoạn video do Daily Mail đăng tải về những người đàn ông da màu, nhưng lại xuất hiện với lời đề xuất tự động có nội dung: "[k]eep seeing videos about Primates" (tạm dịch: Xem tiếp video về Linh trưởng). Đây rõ ràng là một sai sót lớn từ thuật toán nhận dạng video tự động từ Facebook. Bản thân phía nền tảng mạng xã hội này cũng đã thừa nhận rằng đây là "lỗi không thể chấp nhận được". Đồng thời lập tức vô hiệu hóa tính thuật toán để khắc phục nhằm ngăn việc các sự cố nghiêm trọng như thế này xảy ra lần nữa.

"Như đã đề cập trước đó, mặc dù chúng tôi đã không ngừng cải tiến các mô hình AI của mình trong nhiều năm qua, nhưng không phải lúc nào mọi thứ cũng hoạt động hoàn hảo, và sẽ còn tiếp tục cần được hoàn thiện hơn nữa. Chúng tôi xin được gửi lời xin lỗi trân thành nhất tới bất kỳ ai cảm thấy bị xúc phạm hoặc tổn thương bởi sự cố đáng tiếc này”, phát ngôn viên Facebook, Dani Lever, cho biết trong một thông cáo báo chí.

Trên thực tế, thành kiến giới tính và phân biệt chủng tộc trong trí tuệ nhân tạo hầu như không phải là vấn đề riêng của các trang mạng xã hội. Chẳng hạn, các công nghệ nhận dạng khuôn mặt hiện nay, dù tiên tiến, nhưng vẫn chưa hoàn hảo và có xu hướng xác định sai POC và phụ nữ nói chung. Chẳng hạn vào năm 2015, thuật toán AI của Google Photos cũng đã gắn thẻ các bức ảnh của người da màu là "khỉ đột". Vài năm sau, Wired phát hiện ra rằng giải pháp của gã khổng lồ công nghệ là kiểm duyệt từ "gorilla" khỏi các truy vấn tìm kiếm và gắn thẻ hình ảnh.

Về phần mình, Facebook cũng đã chia sẻ một tập dữ liệu mà họ tạo ra với cộng đồng AI trong nỗ lực chống lại vấn đề này vài tháng trước. Gói dữ liệu này chứa hơn 40.000 video, trong đó có hơn 3.000 cá nhân được trả tiền đã chia sẻ độ tuổi và giới tính chính xác của mình với công ty. Facebook thậm chí còn thuê các chuyên gia để chỉnh sáng ảnh chụp của những người này, và đánh dấu tông màu da của họ. Nhờ lượng dữ liệu đầu vào đa dạng như vậy, các hệ thống AI có thể tìm hiểu những người thuộc các sắc tộc khác nhau sẽ trông như thế nào trong các điều kiện ánh sáng nhất định.

Nhìn chung, việc giải quyết vấn đề thiên vị và định kiến sẽ vẫn là một trong những ưu tiên hàng đầu của cộng đồng AI trong nhiều năm tới. Và tất nhiên không thể giải quyết được chỉ trong một sớm một chiều.

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống  Làng Công nghệ

Làng Công nghệ