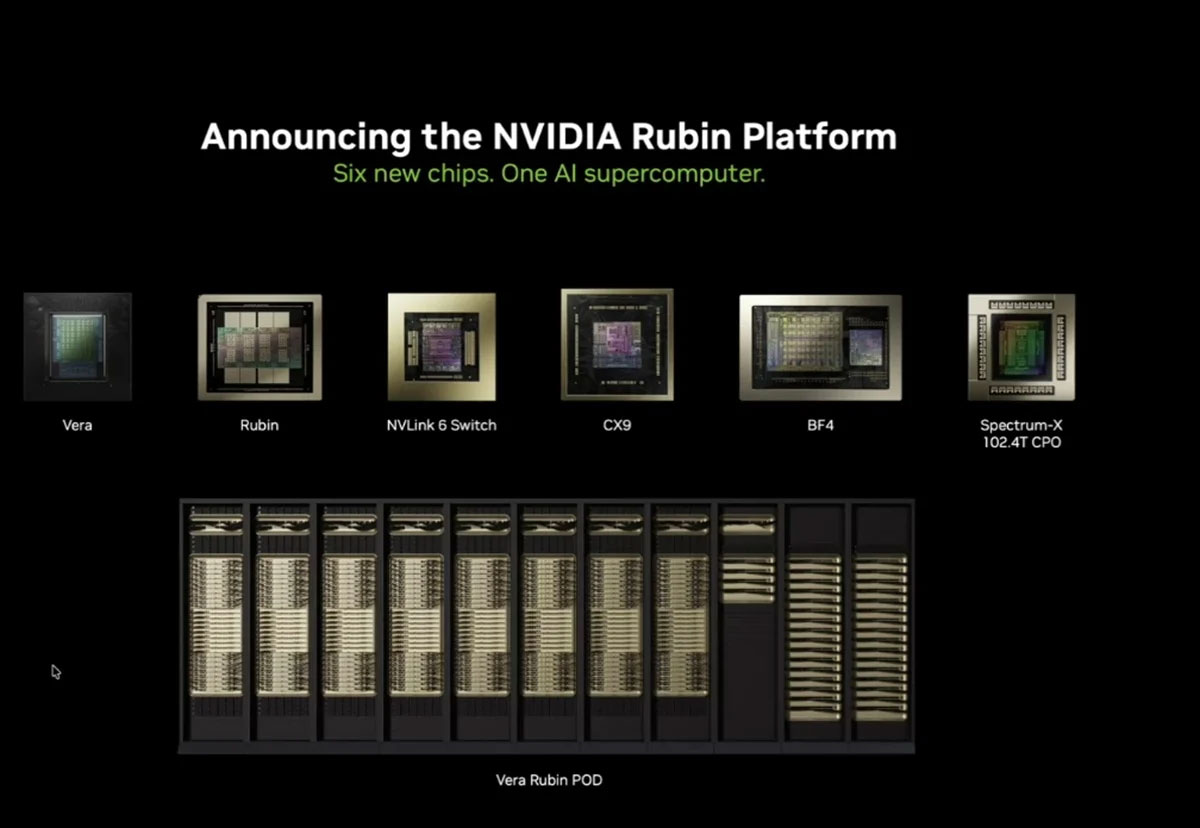

Sau thành công vang dội của nền tảng Blackwell, tại CES 2026, NVIDIA đã chính thức công bố Rubin – nền tảng thế hệ tiếp theo dành cho các siêu máy tính AI. Rubin được thiết kế như một hệ sinh thái phần cứng hoàn chỉnh, gồm sáu loại chip được đồng thiết kế để tối ưu hiệu năng huấn luyện mô hình và suy luận AI.

Nền tảng này bao gồm CPU NVIDIA Vera, GPU NVIDIA Rubin, bộ chuyển mạch NVLink 6, card mạng ConnectX-9 SuperNIC, DPU BlueField-4 và switch Ethernet Spectrum-6. Đối với các hyperscaler, NVIDIA cung cấp hai cấu hình chính là hệ thống rack-scale Vera Rubin NVL72 và hệ thống NVIDIA HGX Rubin NVL8.

Theo NVIDIA, Rubin mang lại bước nhảy vọt lớn về hiệu quả chi phí. Cụ thể, chi phí suy luận AI tính trên mỗi token có thể giảm tới 10 lần so với nền tảng Blackwell. Đồng thời, các mô hình MoE (Mixture of Experts) có thể được huấn luyện với số GPU ít hơn tới 4 lần. Những cải tiến này đến từ thế hệ kết nối NVLink mới nhất, Transformer Engine, công nghệ Confidential Computing, RAS Engine cùng CPU NVIDIA Vera.

NVIDIA cho biết Rubin đã bước vào giai đoạn sản xuất hàng loạt, và hầu hết các công ty AI cũng như hyperscaler lớn như AWS, Google Cloud, Microsoft và OCI sẽ bắt đầu triển khai các giải pháp dựa trên nền tảng này trong nửa cuối năm 2026.

Microsoft cũng đã xác nhận sẽ sử dụng các hệ thống rack-scale NVIDIA Vera Rubin NVL72 cho thế hệ trung tâm dữ liệu AI tiếp theo của mình. Thậm chí, hãng đã đăng tải một bài blog chi tiết cho biết Azure đã sẵn sàng để triển khai Rubin ngay khi nền tảng này được cung cấp trong năm nay.

Với hiệu năng suy luận lên tới 50 PF NVFP4 trên mỗi chip và 3,6 EF NVFP4 trên mỗi rack – cao gấp gần 5 lần so với hệ thống GB200 NVL72 hiện tại – Microsoft đã sớm đưa ra nhiều giả định kiến trúc cốt lõi để chuẩn bị cho Rubin. Hạ tầng rack của Azure đã được thiết kế lại để tận dụng thế hệ NVLink thứ sáu, đạt băng thông scale-up xấp xỉ 260 TB/s. Các hệ thống làm mát, cấp nguồn và bố trí rack cũng đã được nâng cấp nhằm đáp ứng mật độ cao hơn và yêu cầu tản nhiệt khắt khe của bộ nhớ HBM4 và HBM4e.

Ngoài ra, nền tảng Azure đã tích hợp và kiểm chứng khả năng mở rộng bộ nhớ dựa trên SOCAMM2 của các Rubin Superchip. Chuỗi cung ứng, thiết kế cơ khí và lớp điều phối cũng đã được tinh chỉnh để phù hợp với GPU kích thước lớn hơn và kiến trúc đa die của Rubin. Về mạng, Azure sẽ hỗ trợ kết nối NVIDIA ConnectX-9 với băng thông lên tới 1.600 Gb/s, đáp ứng các khối lượng công việc AI quy mô rất lớn.

Microsoft nhấn mạnh rằng nhiều năm đồng thiết kế cùng NVIDIA, từ kết nối, bộ nhớ, tản nhiệt cho tới đóng gói và kiến trúc rack-scale, đã giúp hãng có thể tích hợp Rubin trực tiếp vào hạ tầng Azure mà không cần phải thay đổi quá nhiều.

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống  Làng Công nghệ

Làng Công nghệ