Tại một hội nghị thượng đỉnh về AI gần đây ở New Delhi, CEO Sam Altman cảnh báo rằng những phiên bản đầu tiên của siêu trí tuệ nhân tạo có thể xuất hiện ngay từ năm 2028. Ông cũng nhấn mạnh rằng AI có thể bị vũ khí hóa để tạo ra các mầm bệnh mới, và các xã hội dân chủ cần hành động trước khi bị chính công nghệ mà họ tạo ra vượt mặt.

Những lo ngại này không chỉ đến từ một mình Altman. Geoffrey Hinton — người thường được gọi là “cha đỡ đầu của AI” — đã nhiều lần cảnh báo rằng việc tạo ra những thực thể kỹ thuật số thông minh hơn con người có thể trở thành mối đe dọa tồn vong thực sự.

Tương tự, Mustafa Suleyman trong cuốn sách The Coming Wave lập luận rằng khi AI kết hợp với sinh học tổng hợp , nó có thể giúp một cá nhân đơn lẻ tạo ra một đại dịch chết người.

Đây không còn là cảnh báo cho một tương lai xa xôi. Chỉ tuần trước, một cuộc xung đột về việc ai kiểm soát AI và theo những điều kiện nào đã khiến quan hệ giữa một công ty công nghệ và Bộ Chiến tranh Hoa Kỳ sụp đổ hoàn toàn.

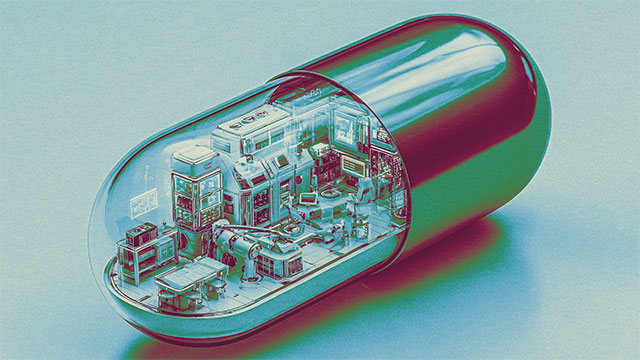

Vì sao so sánh AI với ngành dược

Khi các chính trị gia và lãnh đạo doanh nghiệp cố gắng hiểu những vấn đề này, họ thường tìm đến ngành dược phẩm như một mô hình quản lý.

Richard Blumenthal — một trong số ít nghị sĩ Mỹ tích cực thúc đẩy việc quản lý AI — đã đề xuất rằng cách chính phủ Mỹ giám sát ngành dược có thể trở thành mẫu hình cho việc giám sát AI.

So sánh này nghe có vẻ hợp lý. Ngành dược cho thấy rằng cấp phép nghiêm ngặt và giám sát chặt chẽ có thể kiểm soát các công nghệ nguy hiểm mà không bóp nghẹt đổi mới.

Trên thực tế, nhiều công ty công nghệ cũng đang vô thức áp dụng logic này. Họ quản lý rủi ro AI bằng các bước quen thuộc như kiểm tra trước khi triển khai, đánh giá theo từng giai đoạn và giám sát sau khi ra mắt. Nói cách khác, mô hình của ngành dược đã trở thành khung quản trị mặc định trong nhiều tổ chức AI.

Nhưng vấn đề nằm ở chỗ: đó là khung sai. Và sự khác biệt không chỉ mang tính kỹ thuật, mà mang tính bản chất.

Mô hình quản lý dược phẩm hoạt động hiệu quả vì ba điều kiện cơ bản: rào cản gia nhập cao, sản phẩm mang tính vật lý và chu kỳ phát triển chậm. Nhưng AI không có bất kỳ điều kiện nào trong số đó.

1. Rào cản gia nhập

Đưa một loại thuốc mới ra thị trường có thể tốn khoảng 1,1 tỷ USD, theo một nghiên cứu năm 2020 đăng trên Journal of the American Medical Association.

Các phòng thí nghiệm, thử nghiệm lâm sàng và nhà máy sản xuất khiến chỉ một số ít công ty có thể tham gia — và cơ quan quản lý dễ dàng theo dõi họ.

AI thì hoàn toàn khác. Một mô hình mạnh có thể được xây dựng với chi phí thấp hơn rất nhiều, tinh chỉnh trên phần cứng tiêu dùng và triển khai toàn cầu chỉ từ một chiếc laptop.

Điều đó có nghĩa là đối tượng mà nhà quản lý cần theo dõi không phải vài công ty, mà có thể là bất kỳ ai, ở bất kỳ đâu.

2. Tính vật lý của sản phẩm

Thuốc là sản phẩm vật lý . Việc sản xuất và phân phối cần nguyên liệu, máy móc và logistics. Những yếu tố này tạo ra các điểm kiểm soát để cơ quan quản lý giám sát.

AI thì khác.

Khi một mô hình được phát hành, trọng số của nó có thể được sao chép chính xác và lan truyền toàn cầu trong vài phút. Chi phí sao chép gần như bằng 0.

Quan trọng hơn, bạn không thể thu hồi phần mềm như thu hồi thuốc lỗi. Một khi nó đã phát tán trên internet, nó sẽ ở đó mãi mãi.

Ngay cả những mô hình chỉ truy cập qua cloud cũng không hoàn toàn an toàn. Gần đây, Anthropic tiết lộ rằng ba phòng thí nghiệm AI Trung Quốc — DeepSeek, Moonshot AI và MiniMax — đã sử dụng 24.000 tài khoản để tạo ra hơn 16 triệu lượt tương tác với Claude nhằm trích xuất khả năng của mô hình thông qua kỹ thuật “distillation”.

Họ không cần xâm nhập chuỗi cung ứng hay xây nhà máy. Chỉ cần API và các prompt được thiết kế khéo léo.

Không có thứ tương đương trong ngành dược.

3. Tốc độ phát triển

Quy trình phê duyệt thuốc thường kéo dài nhiều năm . Trong khi đó, AI tiến hóa theo tốc độ phần mềm .

Khả năng của mô hình tăng lên không chỉ nhờ phần cứng mà còn nhờ:

- phương pháp huấn luyện mới

- cập nhật phần mềm

- phát hành phiên bản liên tục

Ví dụ, Anthropic đã tung ra hai phiên bản Claude lớn chỉ trong 10 tuần.

Điều này có nghĩa là khi một quy trình phê duyệt kiểu dược phẩm hoàn tất đánh giá một mô hình, thì mô hình đó đã lỗi thời và được thay bằng một phiên bản mạnh hơn.

Vì sao mô hình “test – triển khai – giám sát” không đủ

Tư duy kiểu dược không chỉ tồn tại trong chính phủ mà còn lan rộng trong doanh nghiệp.

Trong ngành dược, rủi ro quen thuộc là tác dụng phụ. Bạn thử nghiệm trước khi phát hành, giám sát sau khi tung ra và thu hồi nếu xảy ra sự cố.

Nhiều công ty đang áp dụng logic tương tự với AI. Điều này nghe có vẻ có trách nhiệm. Nhưng chính nó lại tạo ra ảo giác an toàn.

Các phương pháp như kiểm tra trước khi triển khai hay đánh giá theo giai đoạn vẫn có giá trị. Chúng giúp phát hiện lỗi, tạo kỷ luật vận hành và chứng minh sự thận trọng trước hội đồng quản trị.

Nhưng chúng chỉ giải quyết những rủi ro quen thuộc như lỗi sản phẩm hoặc sai sót kỹ thuật.

Trong khi đó, rủi ro của AI có hình dạng hoàn toàn khác: nó liên quan đến tính không thể đảo ngược, khả năng lan truyền nhanh và nguy cơ bị lạm dụng.

Không giống sản phẩm lỗi, khi AI gây ra hậu quả nghiêm trọng, bạn không thể phát hành lệnh thu hồi.

Cách tiếp cận mới trong quản trị rủi ro AI

Để giải quyết vấn đề này, các tác giả đề xuất khung quản trị CARE.

CARE gồm bốn bước:

- Catastrophize (xác định điều tồi tệ nhất có thể xảy ra),

- Assess (đánh giá mức độ rủi ro),

- Regulate (thiết lập biện pháp kiểm soát),

- Exit (chuẩn bị kế hoạch khi các biện pháp kiểm soát thất bại).

Khi áp dụng vào doanh nghiệp, khung này dẫn đến một số hành động quan trọng.

Trước hết, các lãnh đạo cần phát hiện “shadow AI” — những công cụ AI mà nhân viên đang sử dụng nhưng không được công ty cung cấp.

Tiếp theo là xác định các điểm không thể đảo ngược, chẳng hạn như email tự động gửi cho khách hàng, mã code AI đưa thẳng vào hệ thống sản xuất, hay hệ thống tuyển dụng dựa trên thuật toán.

Doanh nghiệp cũng phải kiểm soát chặt chẽ dữ liệu. Mỗi công cụ AI thực chất là một đường ống dữ liệu hai chiều. Khi dữ liệu độc quyền được đưa vào hệ thống bên thứ ba, gần như không thể lấy lại hoàn toàn.

Ngoài ra, các tổ chức cần “red team” không chỉ để tìm lỗi kỹ thuật mà còn để kiểm tra khả năng bị lạm dụng.

Cuối cùng, trách nhiệm về rủi ro AI phải thuộc về một lãnh đạo cụ thể, tương tự cách giám đốc tài chính chịu trách nhiệm về rủi ro tài chính.

Trong nhiều thập kỷ, mô hình quản lý kiểu dược đã được xem là một trong những khung quản trị thành công nhất: vừa bảo vệ công chúng vừa cho phép đổi mới.

Nhưng với AI, mô hình đó không đủ.

Tại hội nghị ở New Delhi, Sam Altman đã kêu gọi thành lập một cơ quan quản lý AI quốc tế tương tự International Atomic Energy Agency.

Đó là một cách nhìn thực tế hơn về bản chất của AI — một công nghệ cần cơ chế giám sát tương xứng với mức độ rủi ro thực sự, chứ không phải những mô hình vay mượn từ các ngành hoàn toàn khác.

Các nhà lãnh đạo doanh nghiệp cũng nên suy nghĩ theo hướng tương tự. Những vấn đề mà chính phủ đang đối mặt ở cấp quốc tế cũng chính là những vấn đề đang tồn tại trong nội bộ doanh nghiệp.

Vì vậy, hãy thiết kế hệ thống quản trị phù hợp với công nghệ mà bạn thực sự đang sử dụng, chứ không phải công nghệ mà bạn mong nó giống.

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

Làng Công nghệ

Làng Công nghệ  Chuyện công nghệ

Chuyện công nghệ

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Công nghệ

Công nghệ  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Học CNTT

Học CNTT  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống