Khi AI ngày càng được tích hợp sâu vào đời sống, một câu hỏi mới bắt đầu xuất hiện: liệu AI có thể giúp chúng ta sống tốt hơn, không chỉ ở mặt kỹ thuật hay sáng tạo, mà còn ở cách con người ra quyết định và hợp tác với nhau?

Một nghiên cứu gần đây của Arend Hintze và Christoph Adami mang tên “Promoting Cooperation in the Public Goods Game Using Artificial Intelligence Agents” , đăng trên tạp chí npj Complexity, đã thử tìm câu trả lời cho vấn đề này.

“Bi kịch tài sản chung” và bài kiểm tra lòng vị tha

Nghiên cứu dựa trên một lý thuyết kinh tế nổi tiếng gọi là “bi kịch tài sản chung” (tragedy of the commons). Theo đó, khi nhiều người cùng sử dụng một nguồn tài nguyên hữu hạn, mỗi cá nhân có xu hướng khai thác tối đa vì lợi ích riêng. Kết quả là tài nguyên bị cạn kiệt và cả tập thể đều thiệt hại.

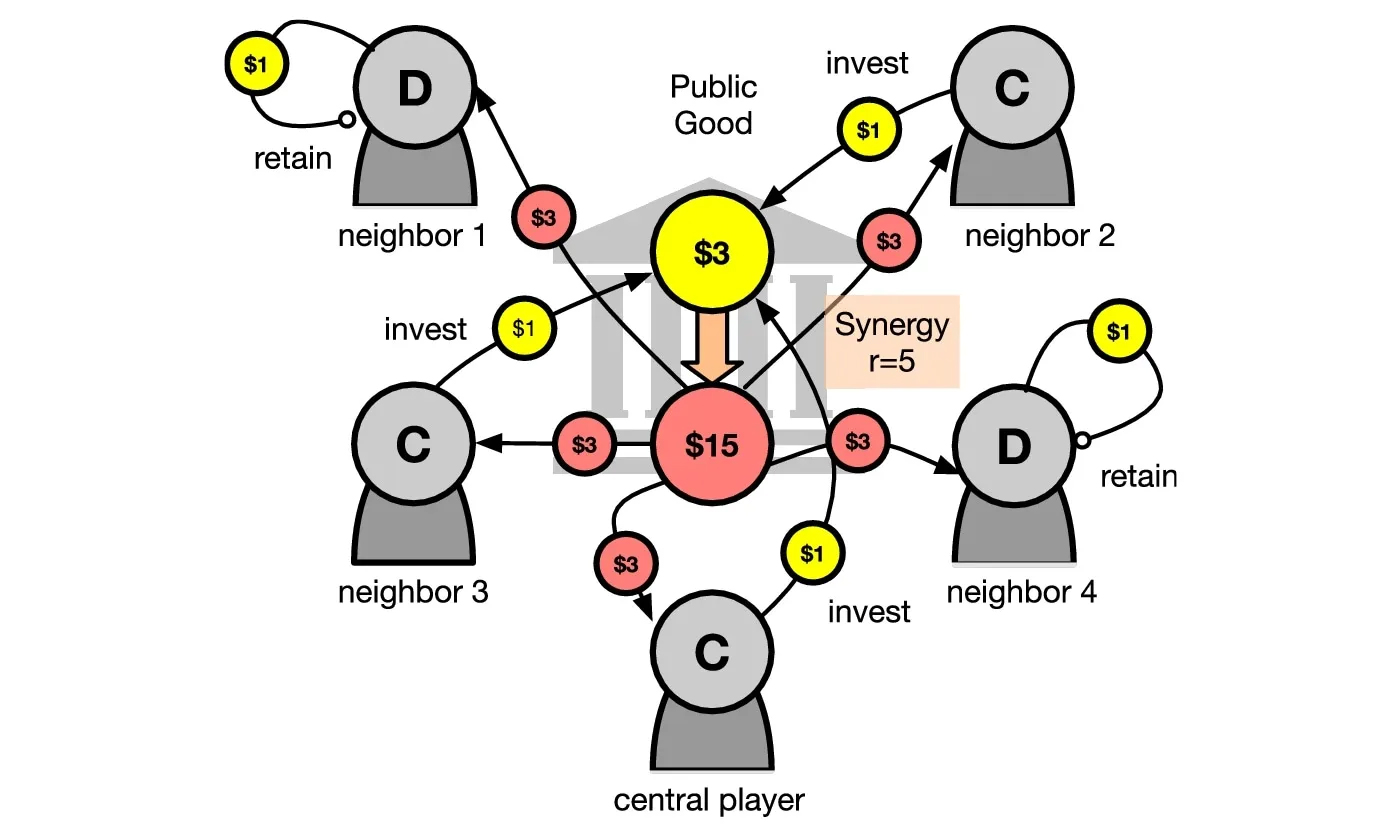

Để kiểm chứng liệu AI có thể cải thiện mức độ hợp tác giữa con người hay không, nhóm nghiên cứu sử dụng mô hình “trò chơi hàng hóa công” (public goods game). Trong trò chơi này, mỗi người chơi có thể đóng góp vào một quỹ chung để mang lại lợi ích cho cả nhóm, hoặc giữ lại phần của mình.

Về lý thuyết, nếu tất cả cùng đóng góp thì cả nhóm đều được lợi nhiều nhất. Nhưng trên thực tế, con người thường chọn giữ phần của mình và hưởng lợi từ đóng góp của người khác. Kết quả thử nghiệm cho thấy khi chỉ có con người tham gia, họ chủ yếu hành động vì lợi ích cá nhân thay vì vì tập thể.

Sau đó, các nhà nghiên cứu đưa AI vào cuộc chơi.

Ở kịch bản đầu tiên, AI được lập trình để luôn hợp tác. Nghe có vẻ tích cực, nhưng thực tế không thay đổi được hành vi của con người. Người chơi vẫn tiếp tục hành động ích kỷ. Việc bổ sung “những người tốt” vào hệ thống đơn thuần là chưa đủ.

Ở kịch bản thứ hai, người chơi được quyền điều khiển AI. Kết quả còn tệ hơn: họ cấu hình AI luôn hợp tác, trong khi bản thân thì không. Nói cách khác, họ “thuê ngoài” hành vi tốt để tối đa hóa lợi ích cá nhân.

Kịch bản thứ ba mới thực sự cho kết quả đáng chú ý. AI được thiết kế để phản chiếu hành vi của người chơi: nếu bạn hợp tác, AI cũng hợp tác; nếu bạn ích kỷ, AI sẽ làm điều tương tự. Cơ chế phản hồi này tạo ra một vòng lặp khuyến khích hợp tác. Khi hành vi tích cực được “thưởng” bằng sự hợp tác từ AI, mức độ hợp tác giữa những người chơi tăng lên rõ rệt.

Liên quan gì đến xe tự lái?

Dù nghiên cứu còn đơn giản hóa nhiều yếu tố so với đời thực, các nhà khoa học cho rằng nguyên tắc này có thể áp dụng vào nhiều tình huống, trong đó có xe tự lái.

Thay vì chỉ tuân thủ cứng nhắc các quy tắc, xe tự hành có thể được thiết kế để “thưởng” cho hành vi lái xe hợp tác. Nếu đủ nhiều xe tự lái hoạt động theo cơ chế này, một vòng lặp tích cực có thể hình thành, giúp giao thông vận hành trơn tru hơn.

Các nghiên cứu đăng trên Transportation Research Part C cũng đề xuất hệ thống định tuyến và điều phối xe nhàn rỗi nhằm phục vụ hành khách hiệu quả hơn. Trong khi đó, một công trình trên Robotics giới thiệu hệ thống theo dõi và duy trì kết nối trực quan giữa các xe tự lái để tránh va chạm.

Nguyên tắc khuyến khích hợp tác còn có thể áp dụng cho việc lên lịch sạc xe điện tự lái, nhằm giảm tình trạng chờ đợi kéo dài và hạn chế áp lực lên lưới điện.

AI không thể “xóa” bản tính ích kỷ của con người. Tuy nhiên, nếu được thiết kế đúng cách, nó có thể tạo ra đủ động lực để việc hợp tác trở thành lựa chọn mang lại lợi ích cao nhất.

Trên thực tế, các hệ thống AI hiện nay – bao gồm chatbot như ChatGPT và Gemini – đều học hỏi dựa trên cơ chế thưởng – phạt để tối ưu hiệu suất. Cách tiếp cận tương tự hoàn toàn có thể được mở rộng sang các hệ thống robotaxi và hạ tầng giao thông thông minh trong tương lai.

Nếu được triển khai hợp lý, AI không chỉ là công cụ hỗ trợ kỹ thuật, mà còn có thể trở thành “bộ điều tiết hành vi”, giúp xã hội vận hành hiệu quả và ít xung đột hơn.

AI

AI  Hướng dẫn AI

Hướng dẫn AI  ChatGPT

ChatGPT  Gemini

Gemini  Thư viện Prompt

Thư viện Prompt  Công nghệ

Công nghệ  Học IT

Học IT  Tiện ích

Tiện ích

AI

AI  Hướng dẫn AI

Hướng dẫn AI  Ứng dụng

Ứng dụng  Hệ thống

Hệ thống  Game - Trò chơi

Game - Trò chơi  iPhone

iPhone  Android

Android  Hàm Excel

Hàm Excel  Download

Download  Khoa học

Khoa học  Cuộc sống

Cuộc sống  Làng Công nghệ

Làng Công nghệ