Thành thật mà nói: Không hề vui vẻ gì khi biết rằng bất cứ thứ gì bạn từng viết có thể đã được sử dụng để huấn luyện các mô hình ngôn ngữ lớn (LLM). Chúng ta chẳng thể làm gì để thay đổi điều đó. Luật bản quyền nghiêng về phía các công ty AI vì cho đến nay, trách nhiệm thuộc về người dùng trong việc "từ chối" để dữ liệu cá nhân, những cuộc trò chuyện và tác phẩm sáng tạo của họ được sử dụng để huấn luyện các mô hình AI. Việc từ chối sẽ không xóa bỏ tác phẩm khỏi tập dữ liệu đã được sử dụng để huấn luyện các mô hình AI, nhưng nó có thể ngăn chặn điều đó trong tương lai.

May mắn thay, hầu hết các công cụ AI phổ biến đều cung cấp những tùy chọn cho phép bạn quyết định xem có muốn các cuộc trò chuyện và nội dung của mình được sử dụng để huấn luyện mô hình hay không.

3 công cụ phổ biến nhất: ChatGPT, Gemini và Claude

3 công cụ phổ biến nhất hiện nay là ChatGPT, Gemini và Claude. May mắn thay, tùy chọn không tham gia đối với cả ba phần mềm này không bị ẩn dưới hàng loạt cài đặt và menu phụ.

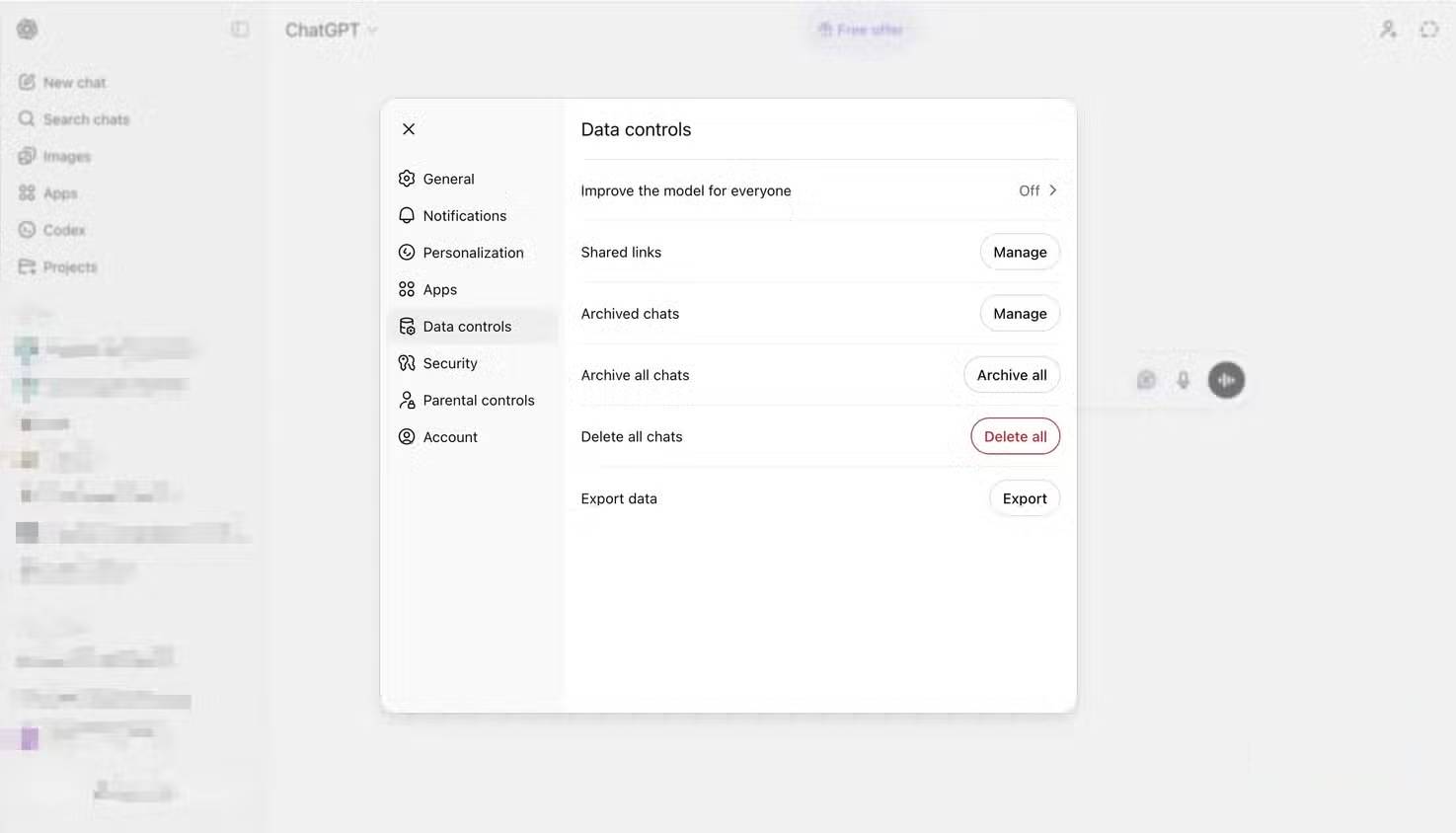

Trên ChatGPT, hãy nhấp vào ảnh profile của bạn, sau đó chọn Settings -> Data Controls. Tắt tùy chọn "Improve the model for everyone" (Cải thiện mô hình cho mọi người) để ngăn các cuộc trò chuyện trong tương lai được sử dụng cho việc huấn luyện. Bạn cũng có thể sử dụng Temporary Chats không lưu trữ bộ nhớ hoặc sử dụng cuộc trò chuyện để huấn luyện. Tuy nhiên, có một vài lưu ý. Ví dụ, nếu bạn cung cấp phản hồi về một cuộc trò chuyện bằng cách sử dụng biểu tượng thích/không thích, toàn bộ cuộc trò chuyện có thể được sử dụng để huấn luyện, ngay cả khi bạn đã tắt cài đặt này trong Data Controls. Ngoài ra, ChatGPT tạm thời lưu trữ mỗi cuộc trò chuyện để giám sát hành vi lạm dụng và đảm bảo an toàn.

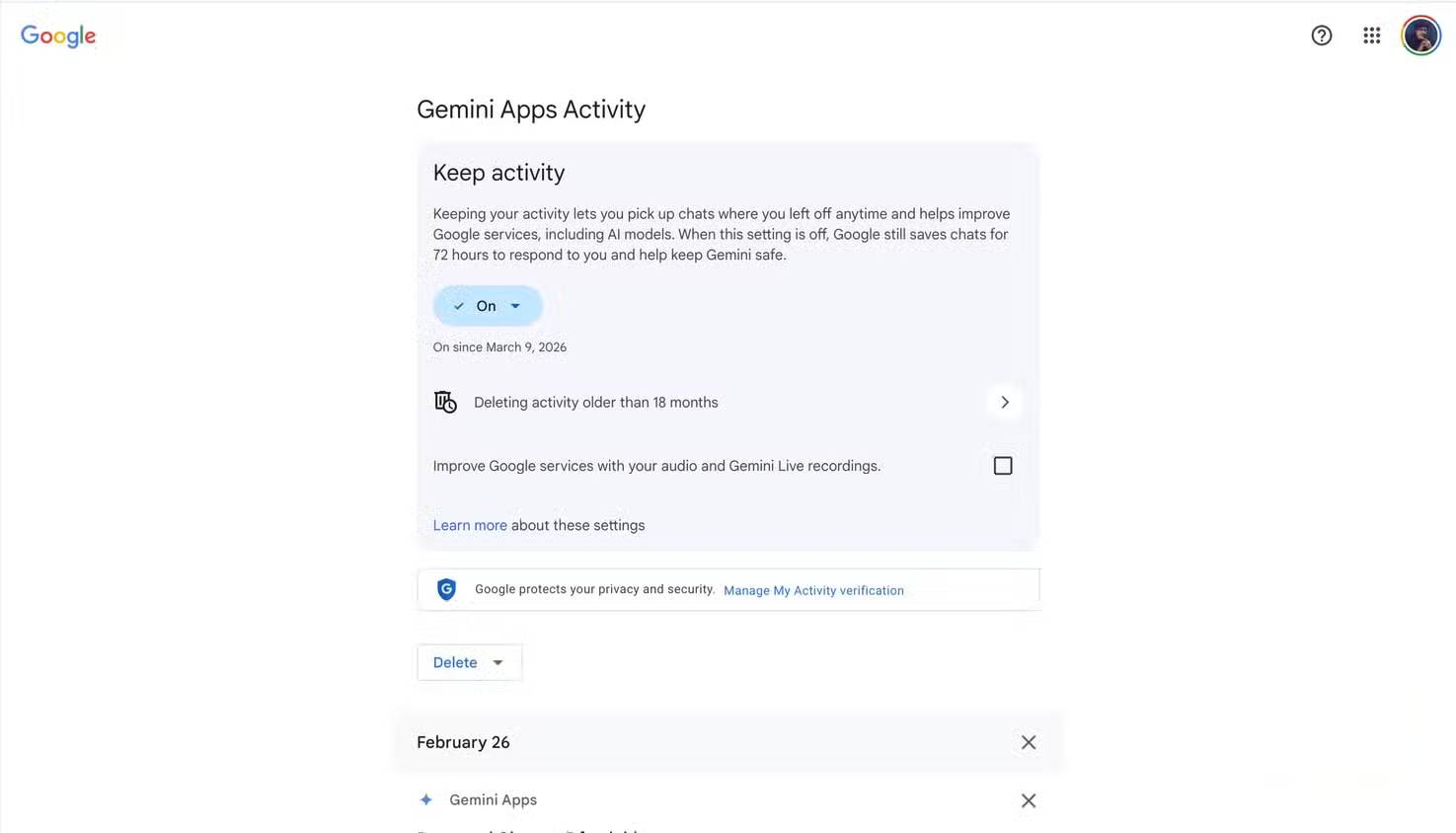

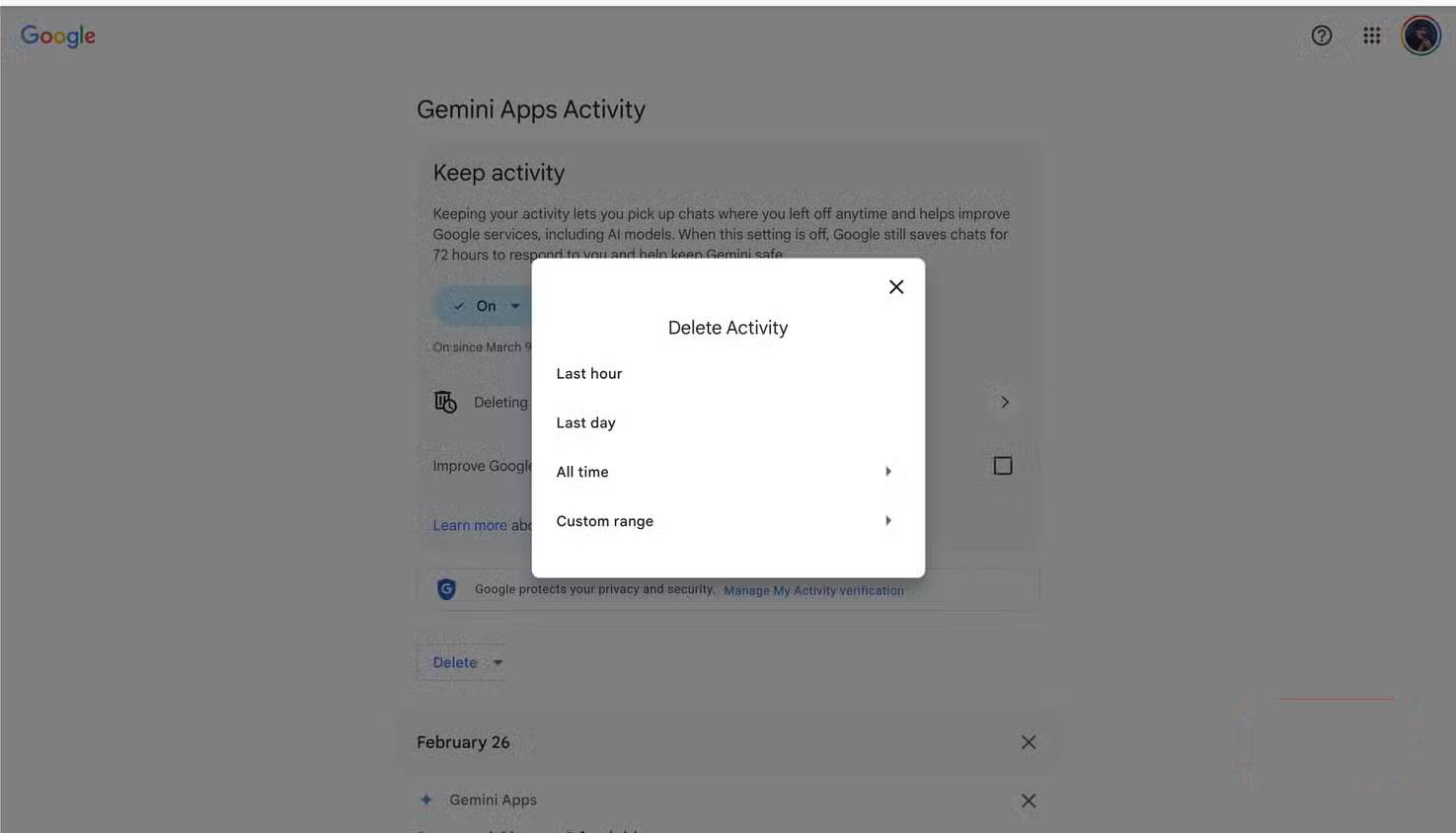

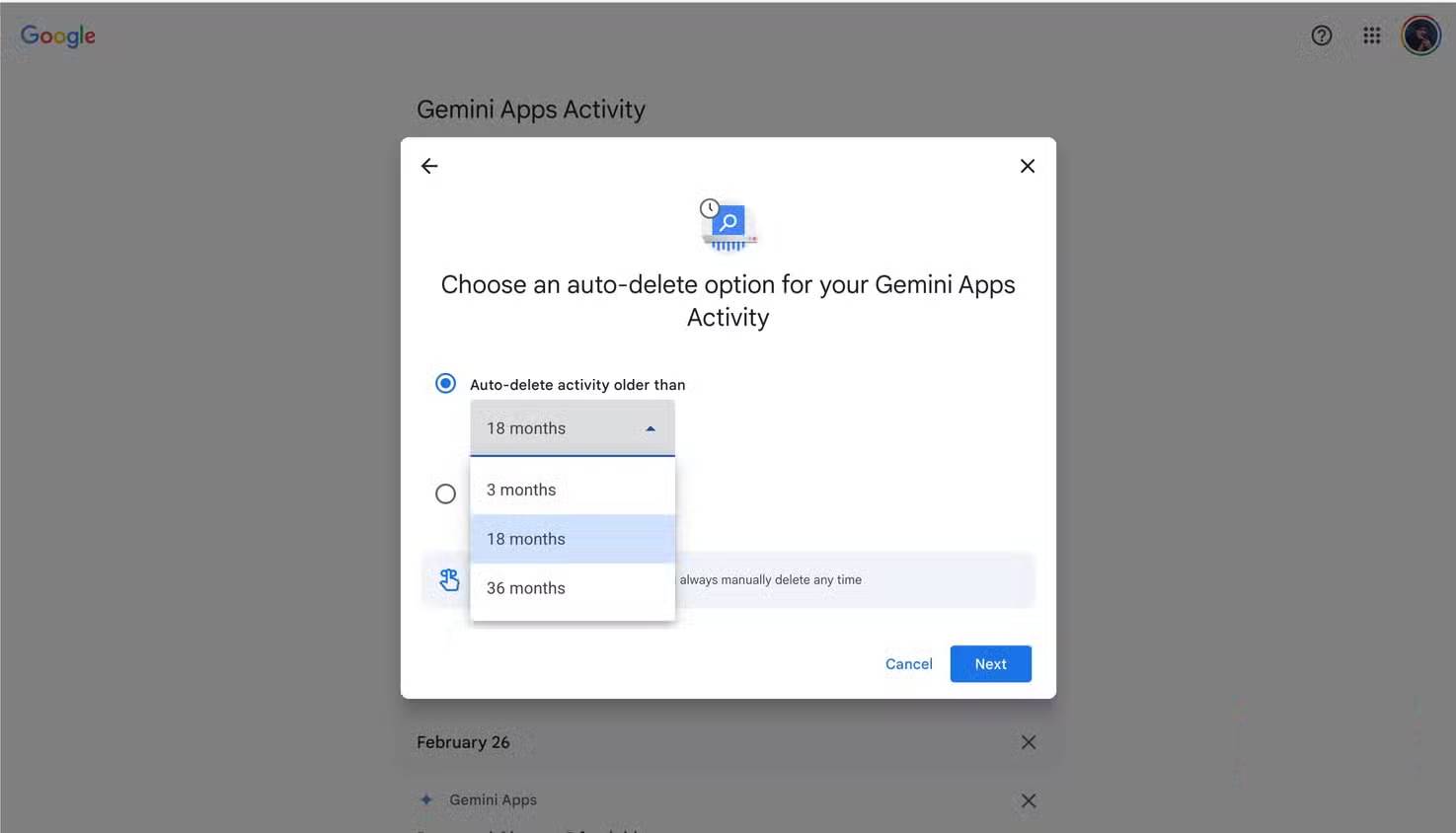

Nếu bạn dùng Gemini, việc từ chối rất đơn giản: Vào Settings and help -> Activity, rồi nhấp vào Turn Off trong menu drop-down Keep Activity. Sau khi được bật, Gemini sẽ lưu các cuộc trò chuyện mới trong tối đa 72 giờ, nhưng chúng sẽ không được sử dụng để huấn luyện. Bạn cũng có thể xóa hoạt động cũ bằng tùy chọn Delete Activity trên cùng trang. Tuy nhiên, điều này sẽ không ảnh hưởng đến các cuộc trò chuyện trước đó đã được đánh dấu để xem xét thủ công - dữ liệu từ các cuộc trò chuyện này có thể được lưu giữ trong tối đa 3 năm, theo Privacy Hub của ứng dụng Gemini.

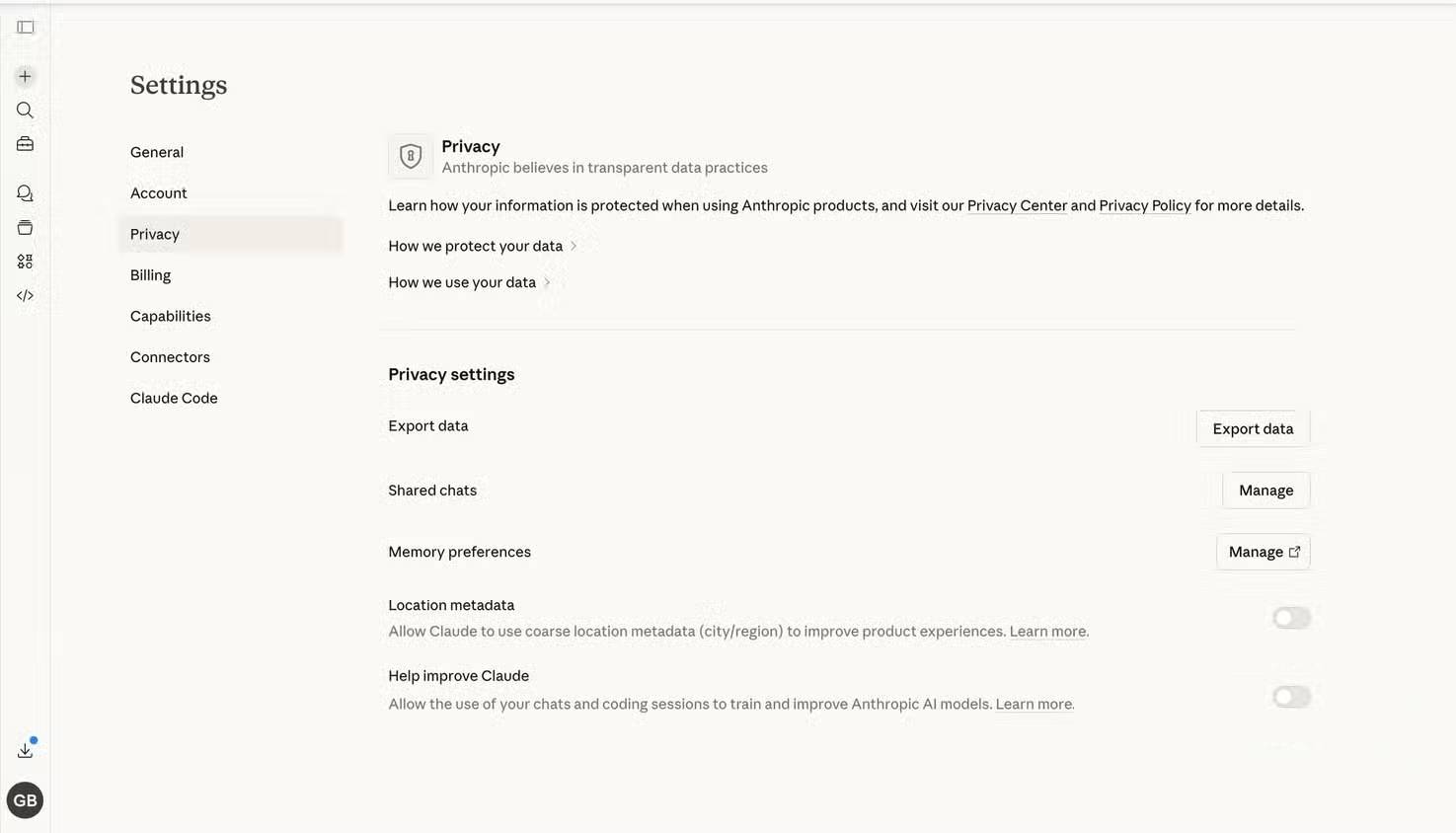

Claude sử dụng các cuộc trò chuyện và phiên lập trình của bạn để cải thiện mô hình của nó. Để tắt tính năng này, hãy nhấp vào ảnh đại diện của bạn, sau đó vào Settings -> Privacy và tắt tùy chọn Help improve Claude for everyone. Không giống như ChatGPT và Gemini, sau khi bạn chọn không tham gia vào việc cải thiện Claude, thông tin trước đây của bạn sẽ không được sử dụng để cải thiện mô hình. Ngoài ra, nếu bạn muốn một cuộc trò chuyện cụ thể không được sử dụng để huấn luyện mô hình, chỉ cần xóa nó. Hãy nhớ rằng, nếu bạn cung cấp phản hồi về một câu trả lời, toàn bộ cuộc trò chuyện sẽ được lưu lại và sử dụng để cải thiện mô hình, ngay cả khi bạn đã tắt tùy chọn Help improve Claude for everyone.

Các công cụ sáng tạo cũng sử dụng tác phẩm của bạn

Đảm bảo các thiết kế gốc của bạn không được sử dụng để huấn luyện AI

Các nhà cung cấp phần mềm thiết kế, Adobe và Figma, sử dụng dữ liệu và nội dung của bạn để cải thiện những mô hình AI của họ.

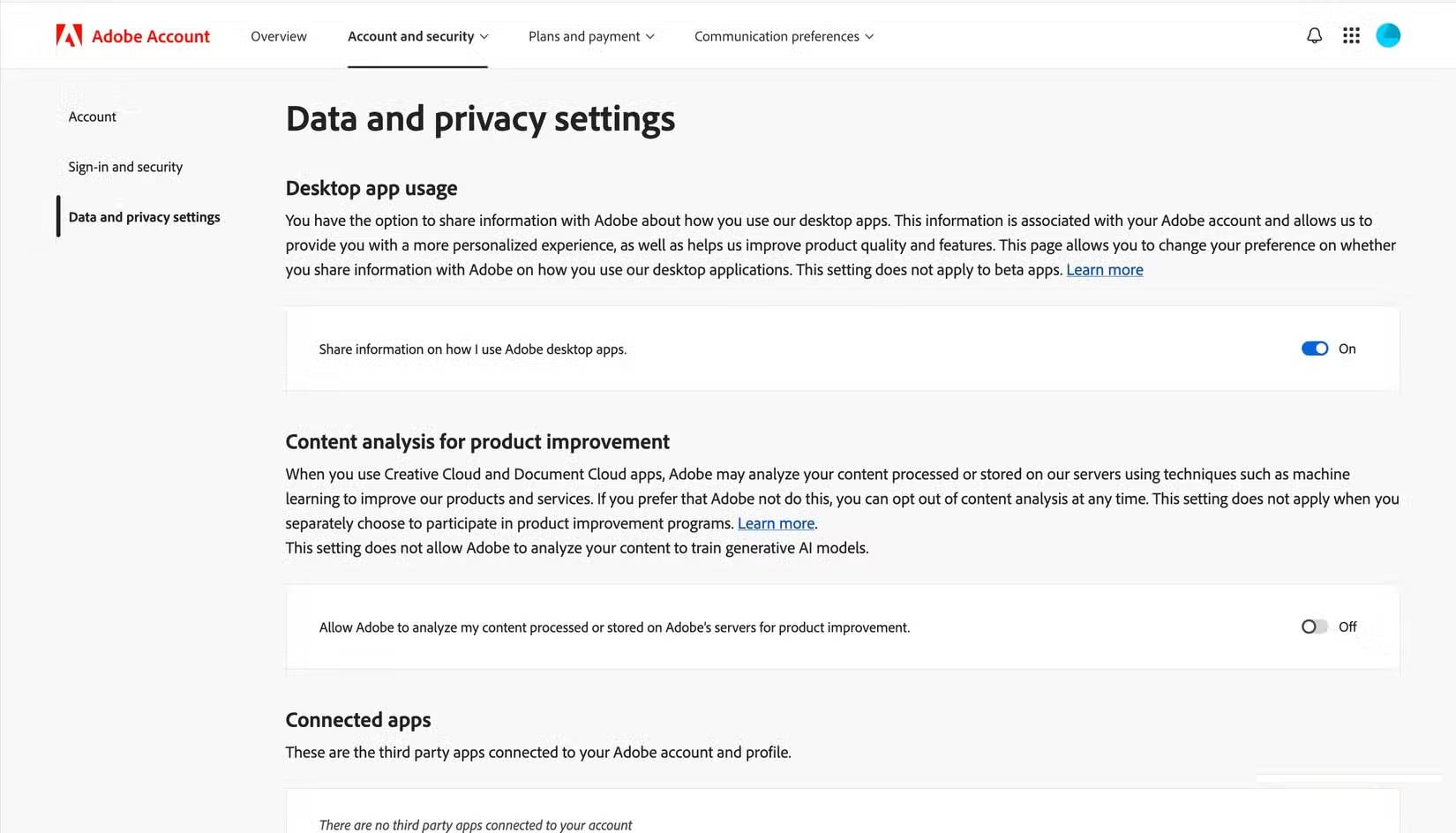

Trong trường hợp của Adobe, bất kỳ nội dung nào được upload lên Adobe Stock marketplace đều được sử dụng để huấn luyện AI. Các file được lưu trữ trên Adobe Creative Cloud có thể được phân tích để cải thiện phần mềm Adobe, nhưng chúng sẽ không được sử dụng trong quá trình huấn luyện mô hình. Điều này không áp dụng cho các file được lưu trữ cục bộ. Vì vậy, nếu bạn không muốn Adobe sử dụng tác phẩm của bạn để huấn luyện AI, đừng upload nó lên Adobe Stock marketplace. Trong trường hợp bạn muốn từ chối phân tích nội dung, bạn có thể thực hiện bằng cách truy cập trang chính sách bảo mật của Adobe và tắt Content analysis for product improvement.

Figma sử dụng dữ liệu nội dung và sử dụng của bạn để cải thiện các tính năng AI của nó. Dữ liệu nội dung bao gồm văn bản, hình ảnh, bình luận, chú thích, tên layer, thuộc tính layer, v.v..., mà bạn đã tạo hoặc upload lên Figma. Mặt khác, dữ liệu sử dụng liên quan đến cách bạn sử dụng và truy cập Figma. Để từ chối điều này, hãy vào tab AI trên trang Figma Settings và tắt Content improvement.

Các nền tảng mạng xã hội đang huấn luyện AI bằng bài đăng của bạn

LinkedIn cho phép bạn tắt tính năng này, nhưng Meta cần làm tốt hơn

Các công ty AI không phải là những người duy nhất sử dụng dữ liệu của bạn để huấn luyện mô hình của họ. LinkedIn và Meta cũng đang sử dụng bài đăng và thông tin khác của bạn để cải thiện mô hình AI của mình.

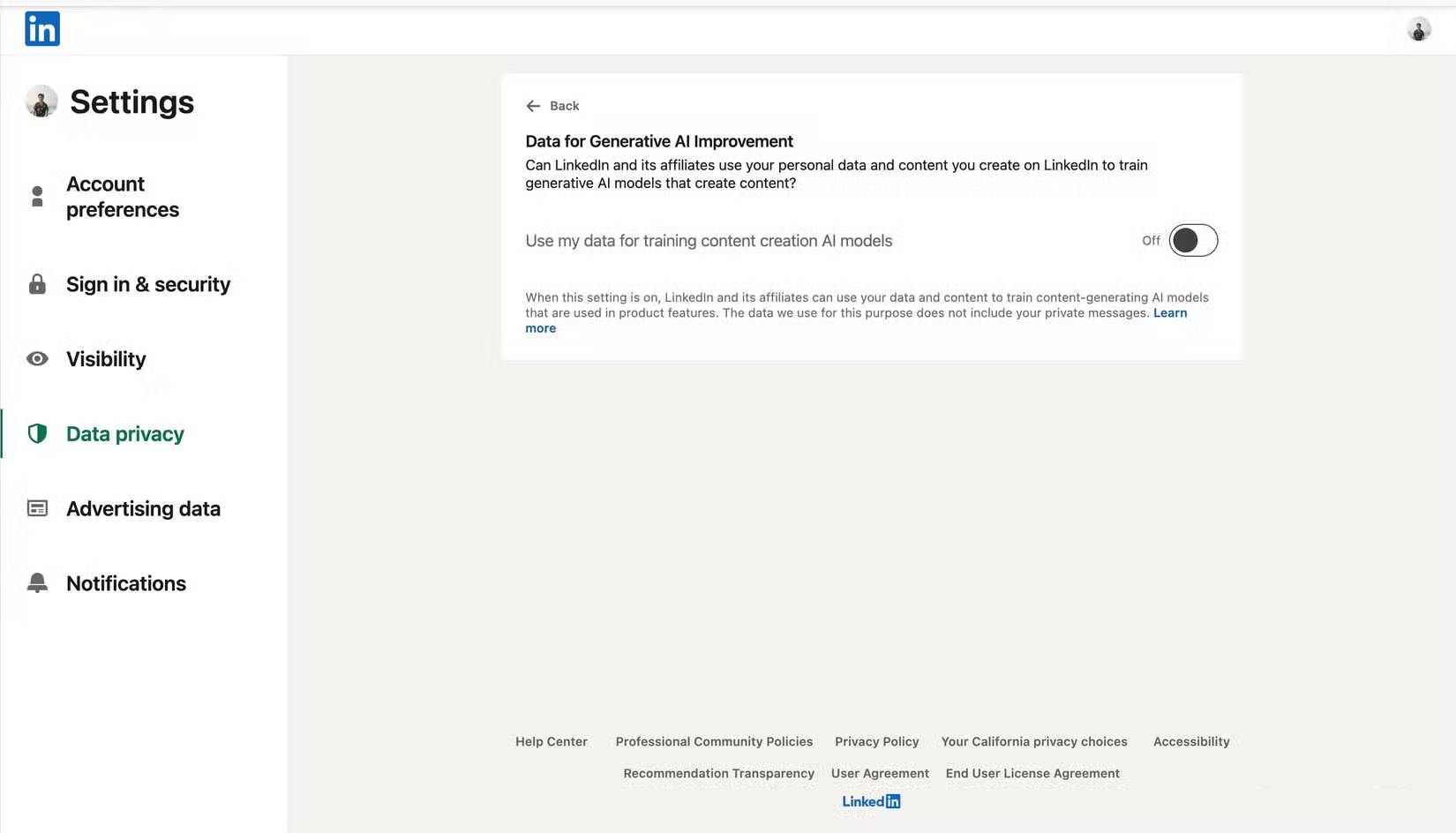

Dữ liệu LinkedIn - như bài đăng và hình ảnh - được sử dụng để huấn luyện mô hình AI tạo nội dung của họ, nhưng không phải các mô hình cá nhân hóa, an toàn và chống lạm dụng dựa trên AI. Bạn có thể từ chối bằng cách tắt tính năng Data for Generative AI improvement trong tab Data Privacy thuộc phần Settings. Điều này chỉ áp dụng cho các bài đăng và nội dung trong tương lai.

Meta là thủ phạm tồi tệ nhất khi nói đến việc kiểm soát dữ liệu của bạn để huấn luyện AI. Tất cả các bài đăng và tương tác công khai của bạn trên Facebook, Instagram và Threads đều được sử dụng để huấn luyện Meta AI, và bạn hầu như không thể làm gì để ngăn chặn điều đó. Bạn có thể gửi biểu mẫu phản đối - yêu cầu một lượng thông tin cá nhân đáng lo ngại - để yêu cầu dữ liệu của bạn không được sử dụng để huấn luyện Meta AI, nhưng việc chấp nhận phụ thuộc vào luật bảo vệ dữ liệu của quốc gia bạn.

Hầu hết các nền tảng AI tự động loại trừ dữ liệu của người dùng doanh nghiệp khỏi quá trình huấn luyện mô hình. Điều này cũng nên áp dụng cho người dùng thông thường.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học