Gần đây, Anthropic đã chặn việc sử dụng gói thuê bao Claude Code để chạy OpenClaw, buộc người dùng phải chuyển sang dùng API. Vấn đề nằm ở chi phí. Model Claude Opus 4.6 hiện có giá khoảng 5 USD cho input và 25 USD cho output mỗi triệu token — mức giá rất cao nếu bạn sử dụng thường xuyên.

Điều này khiến nhiều người, bao gồm cả tôi, phải tìm giải pháp thay thế rẻ hơn nhưng vẫn đảm bảo hiệu năng. Ban đầu, tôi thử dùng GPT-5.4 nhưng gặp một vấn đề khá khó chịu: model có xu hướng “lười”, dễ bỏ cuộc khi gặp bài toán cần xử lý nhiều bước. Điều này không phù hợp với một hệ thống agent như OpenClaw.

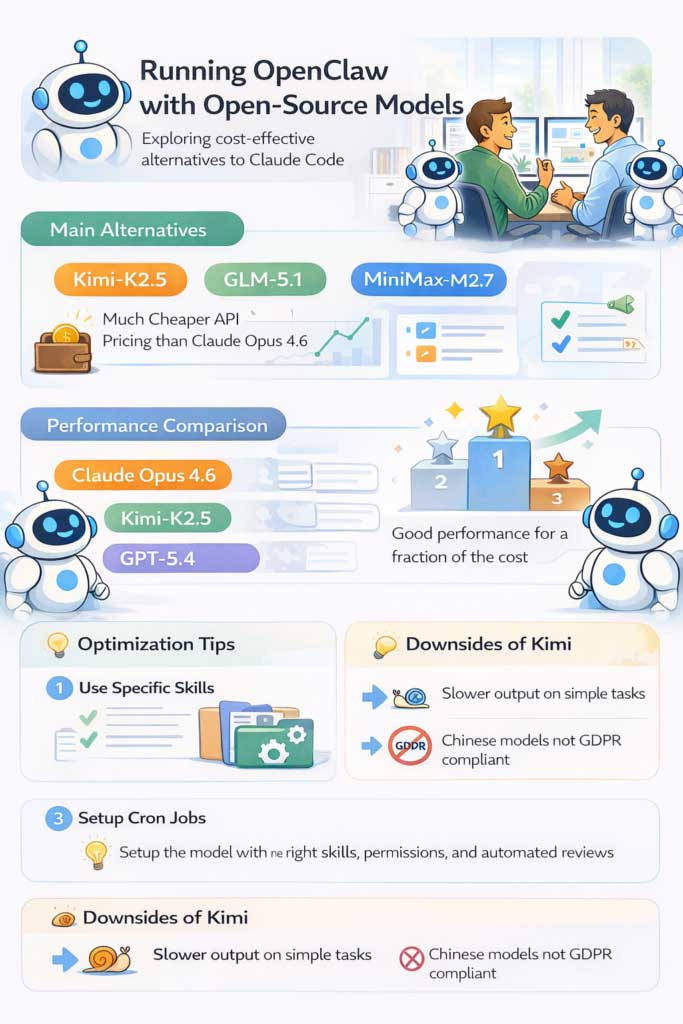

Sau đó, tôi chuyển sang thử các model khác, đặc biệt là nhóm model Trung Quốc như Kimi-K2.5, GLM-5.1 và MiniMax-M2.7. Trong đó, Kimi và GLM là mã nguồn mở, còn MiniMax thì không.

Vì sao nên dùng model mã nguồn mở với OpenClaw?

Lý do lớn nhất vẫn là chi phí. Ví dụ, Kimi-K2.5 chỉ có giá khoảng 0.6 USD (input) và 3 USD (output) mỗi triệu token — tức là chỉ bằng khoảng 1/10 so với Claude Opus 4.6.

Ngoài ra, các model này vẫn có hiệu năng đủ tốt để xử lý nhiều tác vụ agent, đặc biệt nếu bạn biết cách tối ưu hệ thống. Chính vì vậy, việc thử nghiệm Kimi-K2.5 làm “bộ não” cho OpenClaw rõ ràng là sự lựa chọn hợp lý hơn cả.

Cách tích hợp Kimi-K2.5 vào OpenClaw

Quá trình setup thực tế khá đơn giản. Thay vì truy cập trực tiếp, bạn chỉ cần sử dụng nền tảng OpenRouter để kết nối với Kimi-K2.5. Nền tảng này có tính linh hoạt cao, cho phép chuyển đổi giữa nhiều model khác nhau, dù phải trả thêm khoảng 10% phí trung gian.

Sau đó, hãy làm theo các bước sau:

- Lấy API key từ OpenRouter

- Cấu hình lại OpenClaw để dùng model mới

- Loại bỏ hoàn toàn các cấu hình liên quan đến Anthropic

Đây là bước rất quan trọng. Nếu vẫn còn key hoặc reference cũ của Anthropic trong hệ thống, bạn có thể gặp lỗi OAuth dù đã chuyển sang model khác.

Sau khi dọn sạch cấu hình cũ, việc chuyển đổi diễn ra khá mượt. Claude Code thậm chí có thể hỗ trợ cấu hình lại hệ thống chỉ với một lần yêu cầu.

Hiệu năng của Kimi-K2.5 so với các model khác

Nếu chỉ xét hiệu năng thực thế, có thể đưa ra xếp hạng chủ quan như sau:

- Claude Opus 4.6

- Kimi-K2.5

- GPT-5.4

Khoảng cách giữa Claude và Kimi là không quá lớn, nhưng Kimi vượt trội hơn GPT-5.4 trong bối cảnh agent. Một điểm đáng chú ý là Kimi có xu hướng “nghĩ nhiều” hơn mức cần thiết, khiến tốc độ phản hồi chậm hơn, kể cả với các câu hỏi đơn giản.

Tuy nhiên, đổi lại, model này kiên trì hơn và ít bỏ cuộc khi xử lý các task phức tạp — yếu tố quan trọng với OpenClaw.

Nếu không xét chi phí, Claude vẫn là lựa chọn tốt nhất. Nhưng với mức giá chỉ bằng 1/10, Kimi-K2.5 trở thành đối thủ rất đáng gờm.

Cách tối ưu OpenClaw khi dùng model mã nguồn mở

Để đạt hiệu quả tốt, bạn không thể chỉ thay model mà cần tối ưu cả hệ thống. Một số nguyên tắc quan trọng bao gồm việc model cần được gán các skill cụ thể cho từng loại task, thay vì xử lý mọi thứ một cách chung chung. Đồng thời, bạn phải đảm bảo agent có đủ quyền truy cập, như API key cho các dịch vụ cần thiết.

Ngoài ra, việc thiết lập cron job để agent học từ lịch sử chat cũng rất quan trọng. Ví dụ, bạn có thể cho hệ thống tự động review toàn bộ cuộc hội thoại mỗi ngày để cải thiện hiệu suất.

Điểm thú vị là các kỹ thuật từng áp dụng với Claude Opus vẫn hoạt động tốt với Kimi-K2.5. Điều này cho thấy OpenClaw khá “model-agnostic”, miễn là model đủ mạnh về reasoning và khả năng agent.

Những hạn chế của Kimi-K2.5

Dù có nhiều điểm mạnh, Kimi-K2.5 vẫn tồn tại một số nhược điểm.

Đầu tiên là tốc độ. Model phản hồi chậm hơn đáng kể, đặc biệt với các câu hỏi đơn giản, do tiêu tốn nhiều “thinking tokens”.

Thứ hai là vấn đề tuân thủ GDPR. Khi sử dụng các model này qua API, dữ liệu có thể không được xử lý trong phạm vi EU, khiến bạn không thể dùng cho dữ liệu nhạy cảm hoặc dữ liệu khách hàng.

Về lý thuyết, bạn có thể tự host model để giải quyết vấn đề này, nhưng đổi lại sẽ phải đầu tư hạ tầng (GPU, server…) và chấp nhận tốc độ xử lý chậm hơn.

Việc chuyển từ Claude sang model mã nguồn mở không chỉ là lựa chọn tiết kiệm chi phí, mà còn mở ra nhiều hướng linh hoạt hơn trong việc xây dựng hệ thống agent.

Qua thử nghiệm, Kimi-K2.5 cho thấy hiệu năng rất tốt so với mức giá, đủ để trở thành “bộ não” cho OpenClaw trong nhiều trường hợp.

Dù vẫn còn một số hạn chế, nhưng nếu được cấu hình và tối ưu đúng cách, OpenClaw kết hợp với model mã nguồn mở hoàn toàn có thể trở thành một trợ lý AI mạnh mẽ với chi phí hợp lý hơn rất nhiều.

AI

AI

Hướng dẫn AI

Hướng dẫn AI

ChatGPT

ChatGPT

Gemini

Gemini

Thư viện Prompt

Thư viện Prompt

Công nghệ

Công nghệ

Học IT

Học IT

Tiện ích

Tiện ích

Hướng dẫn AI

Hướng dẫn AI

Ứng dụng

Ứng dụng

Hệ thống

Hệ thống

Game - Trò chơi

Game - Trò chơi

iPhone

iPhone

Android

Android

Làng Công nghệ

Làng Công nghệ

Hàm Excel

Hàm Excel

Cuộc sống

Cuộc sống

Khoa học

Khoa học